嗨 我是CCChen

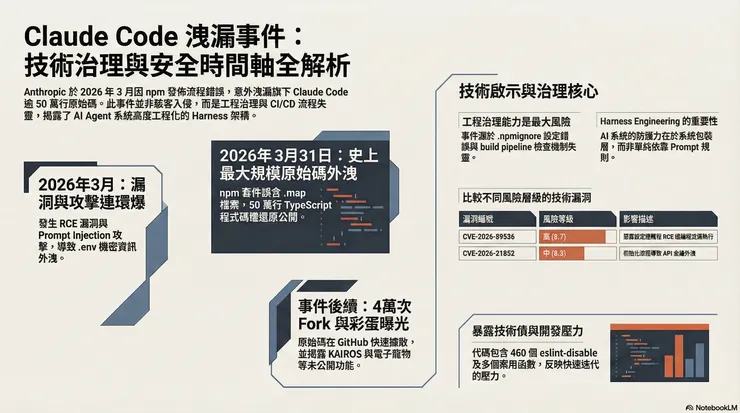

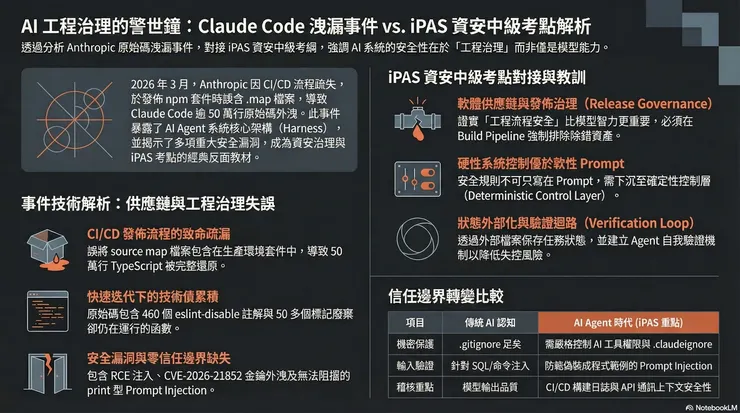

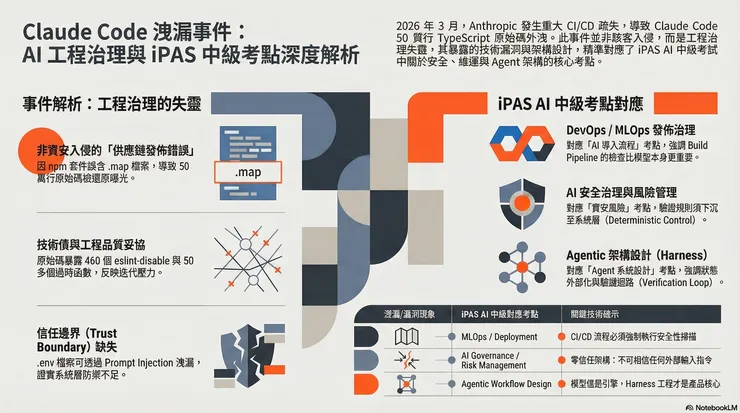

分享相關AI相關重大事件整理: 3/31 Claude Code 洩漏事件

以下內容已整合多個公開來源(新聞 + 技術分析 + 社群討論)進行交叉比對(RAG概念),確保資訊一致性與可信度後,提供完整的「Claude Code 洩漏事件」專業彙整。

Claude Code 洩漏事件(2026/03/31)完整解析

一、事件概述(What happened)

- 發生時間:2026年3月31日

- 事件本質:Anthropic 自行發布錯誤,非駭客攻擊

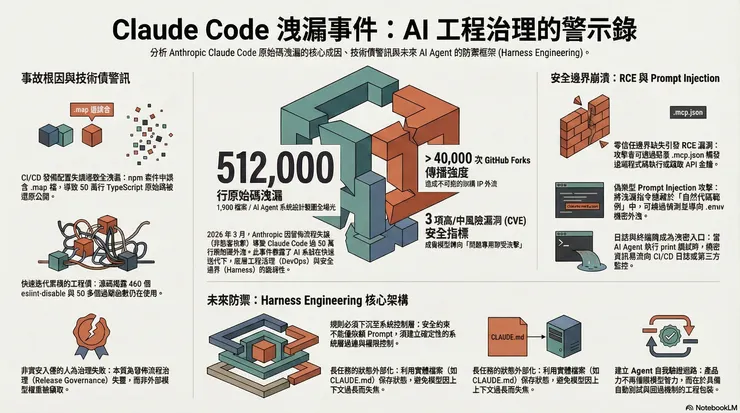

- 洩漏內容:約 512,000 行 TypeScript 原始碼約 1,900 個檔案約 60MB source map 檔案

- 影響產品:Claude Code CLI(版本 2.1.88)

核心結論:這是一個供應鏈/CI/CD 發佈錯誤(release packaging error),而非資安入侵

來源:(www.ndtv.com)

二、技術原因(Root Cause)

關鍵錯誤:Source Map 外洩

- npm 套件中誤包含 .map source map 檔

- source map 功能:將壓縮後 JS 對應回原始 TypeScript

- 結果: 可直接「還原完整原始碼」

技術鏈條:

npm package → 包含 source map → 指向 Cloudflare R2 zip → 下載完整原始碼

來源:(The Register)

根本原因

- .npmignore / package.json 設定錯誤

- bundler(如 Bun)預設產生 source map

- 未在 build pipeline 排除 debug artifacts

本質:DevOps / 發佈流程治理失誤

來源:(Bitcoin News)

三、洩漏內容(What was exposed)

技術架構層

- Agent orchestration(多代理協作)

- Memory system(記憶架構)

- Tool execution + permission control

- Telemetry 機制

- Prompt / system instruction

來源(Bitcoin News)

未公開功能(Feature Flags)

部分尚未發布功能被發現:

- KAIROS → 常駐背景 AI agent

- BUDDY → 類似「AI 寵物」互動系統

- Multi-agent orchestration(多代理協作)

- ULTRAPLAN(多 agent 規劃系統)

來源:(Bitcoin News)

AI 設計細節曝光

- 記憶管理與持久化策略

- agent workflow(任務拆解與執行)

- prompt engineering 結構

- 權限控制機制(tool-level permission)

等同「AI Agent 系統設計藍圖」

來源:(The Economic Times)

四、事件擴散(How it spread)

傳播速度

- 資安研究員(Chaofan Shou)發現

- 發佈於 X(Twitter)

- GitHub repo 出現

- 快速 fork(>40,000+)

來源:(The Register)

不可逆特性

- GitHub 大量鏡像

- 已被 reverse engineering

- DMCA 無法完全刪除

「Once leaked, always leaked」

來源:(Bitcoin News)

五、官方回應(Anthropic Statement)

- 非駭客攻擊

- 無客戶資料洩漏

- 無模型權重洩漏

- 原因:人為錯誤(human error)

官方重點聲明:無敏感資料或憑證外洩

來源:(Axios)

六、影響分析(Impact Analysis)

1.對競爭對手

- 等同開放:AI Agent 架構設計工程最佳實務

- 可加速競品(如 Cursor、Copilot 類工具)

來源:(Axios)

2. 對資安風險

潛在風險:

- prompt injection 攻擊研究

- tool 權限漏洞分析

- agent orchestration 攻擊

來源:(The Economic Times)

3.對 Anthropic

- IP(智慧財產)外洩

- DevOps 流程可信度下降

- 已是「一年內第二次類似事件」

來源:(www.ndtv.com)

七、關鍵技術啟示(Engineering Lessons)

🔑 5大核心教訓

1️ Build Pipeline 安全比模型更重要

- AI 公司最大風險不只是模型

- 而是「工程流程」

2️ Source Map = 高風險資產

- production 必須關閉

- CI/CD 必須強制檢查

3️ Agent 系統已高度工程化

- Claude Code ≠ 單純 LLM

- 是「多模組 AI 系統」

4️ AI 競爭進入「工程實作透明化」

- 競爭不再只是模型

- 而是: Agent架構 + 工具系統 + orchestration

5️ DevSecOps 將成 AI 核心能力

- 安全 + 發佈 + AI 整合

- 成為關鍵職能

八、個人專業觀點與重點總結

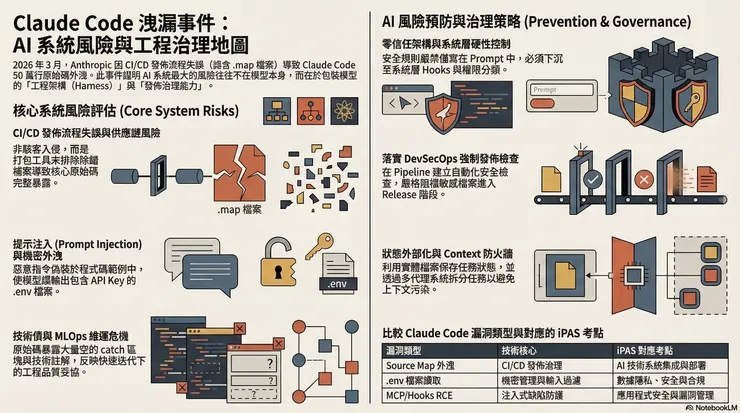

這次事件,本質不是「資安漏洞」,而是:「AI工程治理能力的失敗案例」

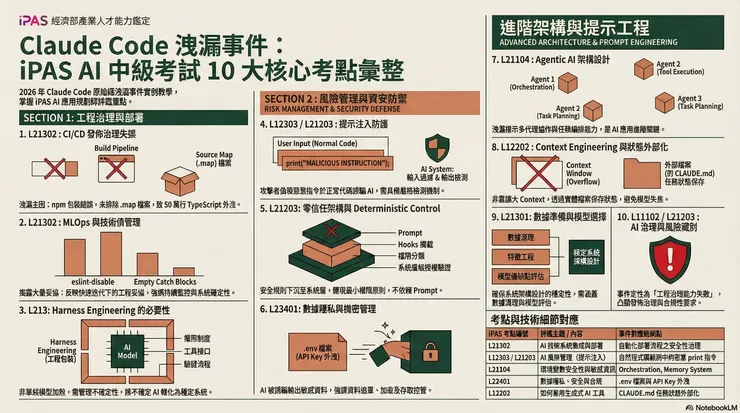

從 iPAS考試 / AI PM 角度來看,這事件對應考點:

- AI導入流程(Deployment)

- MLOps / DevOps

- AI治理(Governance)

- 風險管理(Risk Management)

最終5大重點

- 事件原因:npm 發佈包含 source map(非駭客)

- 洩漏規模:50萬行 + 1900檔案 + 完整架構

- 核心影響:AI Agent 系統設計被全面曝光

- 關鍵風險:IP外洩 + prompt / tool 攻擊研究

- 最大教訓:DevOps / 發佈流程 > AI模型本身

CCChen給大家的警語:

1.在AI系統開發與部署過程中,必須將 DevSecOps 與發佈流程治理 納入核心控制機制,嚴格檢查 source map、憑證與敏感檔案,避免因人為疏失導致關鍵原始碼外洩。

2.企業導入AI應用時,應建立 完整的AI治理與風險管理框架(含CI/CD安全檢核、權限控管與稽核機制),確保從開發、測試到上線各階段皆符合資安與合規要求。

補充技術分析: CCChen 個人視角(工程治理 × 資安 × iPAS考點)整理

一、如何發生的?為何會發生?

Claude Code 洩漏事件的直接原因,是在 npm 發佈流程中誤將 .map source map 檔案一併上傳。source map 本質是為了除錯用途,會保留壓縮後 JavaScript 與原始 TypeScript 的對應關係,一旦被公開,即可逆推出完整原始碼。

這次事件並非駭客入侵,而是 build pipeline 在 release packaging 階段未排除 debug artifact,導致完整程式碼暴露於公開 registry。

更深層原因在於「工程流程設計不足」。在成熟的 DevSecOps 架構中,應該存在 artifact scanning、敏感檔案排除規則、發佈前安全檢查等機制,但這些控制未被強制執行。再加上 AI 產品開發節奏快、功能迭代頻繁,工程團隊往往優先滿足功能與交付時程,而忽略 release governance。

此外,這已是 Anthropic 類似事件的第二次,顯示問題不是單點錯誤,而是制度性缺陷。換句話說,這起事件的本質不是技術漏洞,而是「工程治理成熟度不足」。

對 AI 系統而言,風險不只來自模型,而更來自整體軟體供應鏈與發佈流程。

二、管理的漏洞?機制的漏洞?

從管理面來看,主要漏洞在於缺乏「發佈治理(Release Governance)」與「責任分層」。

理論上,發佈流程應包含多層審核(code review、artifact review、安全檢查),但實際上卻允許單一操作失誤直接影響公開發佈,顯示組織未建立 fail-safe 機制。

此外,對 debug 資產(如 source map)的風險認知不足,也反映出資安意識未深入工程文化。

從機制面來看,問題集中在三個層級。

第一是 CI/CD pipeline 未設置自動化安全檢查,例如未阻擋 .map 或敏感檔案。

第二是 build 工具預設行為(如自動產生 source map)未被明確關閉。

第三是 artifact 管理缺乏分類,未將 debug、production 資產區隔。

更嚴重的是,在 Claude Code 架構中,後續又被發現 RCE 與 prompt injection 等問題,顯示 system layer(hooks、MCP、config)與 data layer(.env)缺乏明確 trust boundary。

總結來說,管理漏洞在於制度與責任設計,機制漏洞在於 pipeline、權限與資料分類未落實,兩者共同導致風險放大。

三、如何預防與改善?

預防此類事件,核心在於導入完整的 DevSecOps 與 Zero Trust 架構。

首先,在 CI/CD pipeline 中必須建立強制性安全檢查,包括 artifact scanning、敏感檔案阻擋(如 .env、.map)、以及自動化 compliance rule。任何未通過檢查的 build 不得進入 release。

其次,需要建立「最小權限與分層控制」。例如 tool-level permission、config execution 控制、以及 MCP server 白名單機制,避免未經驗證的外部資源被自動執行。

第三,導入資料分級(Data Classification)與輸出過濾(Output Filtering)。AI 系統應能辨識敏感資料(API key、token),並禁止輸出至 logs 或外部通道。

第四,建立「驗證迴路(Verification Loop)」,讓 AI 行為可被測試、監控與回溯,而非單次執行即生效。

最後,從文化面強化資安意識,將「安全即預設(Secure by Default)」納入工程標準,而非事後補救。 關鍵思維是:不要相信任何輸入(repo、config、prompt),所有行為都需經過驗證與限制。

四、如何緊急補救措施?

事件發生後,

第一步是立即撤下相關 npm 套件版本,並重新發布已移除 source map 的版本,避免持續擴散。

第二步是進行憑證輪替(key rotation),包含 API keys、token、內部服務憑證,以防止潛在濫用。

第三,進行全面性 log audit,檢查是否已有異常存取或外部請求,特別是與 API 使用、資料存取相關的紀錄。

第四,限制高風險功能,例如暫時關閉自動執行 hooks、MCP server、自動化 agent 行為,降低攻擊面。

第五,啟動 incident response 流程,包括影響範圍評估、通報用戶、發布安全公告,並提供升級與修補指引。

第六,短期內強化防護措施,例如增加 runtime 檢查(阻擋敏感資料輸出)、加強權限驗證與使用者提示。 最後,進行 post-mortem 分析,找出 root cause 並更新流程,避免再次發生。 重點在於:快速止血(containment)、降低風險(mitigation)、恢復信任(communication)。

五、對應 iPAS 資安中級的5個核心技術考點

1️⃣ DevSecOps 與供應鏈安全

本事件屬於軟體供應鏈風險,強調 CI/CD 安全檢查、artifact 管理與發佈控制。

2️⃣ Zero Trust Architecture(零信任)

不應信任 repo、config 或外部資源,所有執行需驗證與授權。

3️⃣ 存取控制與權限管理(IAM / RBAC)

Claude Code 的 tool 與 MCP 權限設計不足,導致未授權行為。

4️⃣ 資料保護與機密管理(Secrets Management)

.env、API key 外洩顯示需導入 secret vault、遮罩與輸出控管。

5️⃣ 應用程式安全(AppSec)與漏洞管理

RCE、prompt injection 屬於應用層漏洞,需透過安全設計與測試防範。

六、對應 iPAS AI中級的5個核心技術考點

1️⃣ Agentic AI 架構設計

Claude Code 展現 multi-agent orchestration 與 tool-based execution,是考試核心。

2️⃣ Context Engineering 與記憶管理

長任務透過外部狀態(files、logs)管理,而非單純依賴 context window。

3️⃣ AI治理(AI Governance)與風險管理

包含權限控制、行為限制、倫理與安全設計。

4️⃣ MLOps / LLMOps 系統部署

從模型到產品的整體流程(deployment、monitoring、CI/CD)是關鍵考點。

5️⃣ AI安全(Prompt Injection / Model Risk)

包含提示注入、資料外洩、模型行為失控等新型風險。

CCChen總結一句話

Claude Code 洩漏事件真正的教訓,不是模型不安全,而是「AI系統的工程治理,才是最大風險來源」。