導言

當生成式 AI、AI 搜尋、社群平台治理與搜尋演算法同步進入新階段,過去那套靠假評論、灌聲量、內容農場與站群操作可見度的手法,也正在失去原本的效果與成本優勢。問題已經不再只是「網軍有沒有用」,而是它究竟還能影響哪些層次:是搜尋排名、社群分發、AI 摘要,還是只是短期污染公開資料池?這篇文章想拆解的,正是 2026 年這個最容易被誤解的真相。

網軍、假評論、內容農場與灌聲量,到了 2026 年還能不能像過去那樣,穩定影響 Google、社群平台,甚至進一步操弄 AI 搜尋與 GEO?

如果延續上一篇《為什麼 AI 一鍵生成的網站,Google 搜尋不到?從渲染、索引到內容品質,一次看懂真正原因》,這一次更值得問的其實不是「網軍有沒有消失」,而是:

今天這些操作,究竟還能影響什麼?又已經失去什麼?

重點摘要:

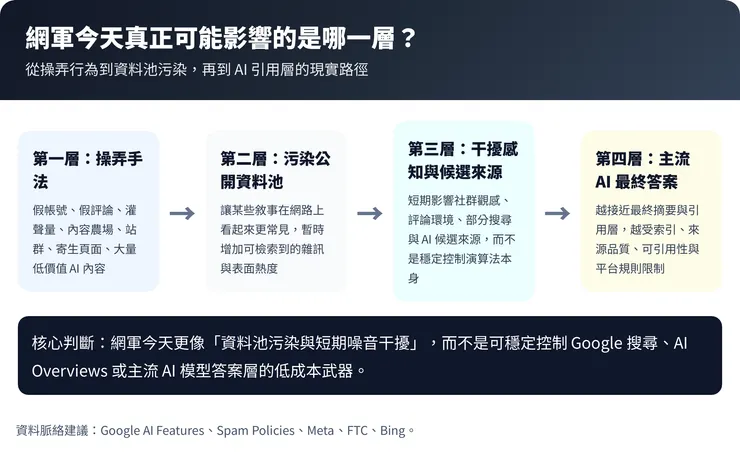

2026 年的網軍更像資料池污染與短期噪音干擾,不再是可穩定操弄 Google、GEO 或主流 AI 引用層的低成本工具。

今天的網軍式操作,越來越難像早年那樣,靠大量帳號、大量頁面、大量外鏈、大量評價,長期穩定地把自己洗進搜尋排名或平台分發核心。真正還可能存在的,不是長期控制演算法,而更像是短期製造噪音、污染資料池、干擾評價環境與社群感知。越接近 Google 搜尋、AI 摘要與 AI 引用層,這種做法的效果越弱,風險越高。

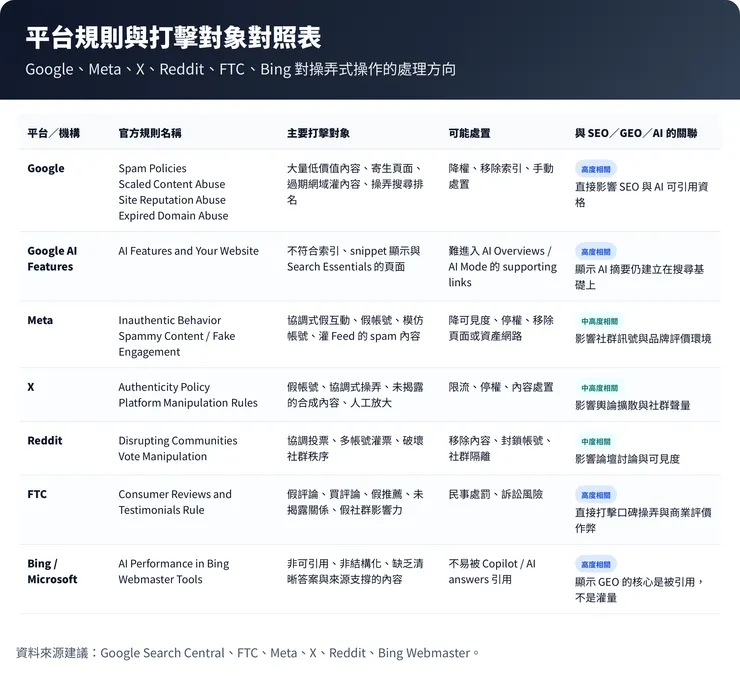

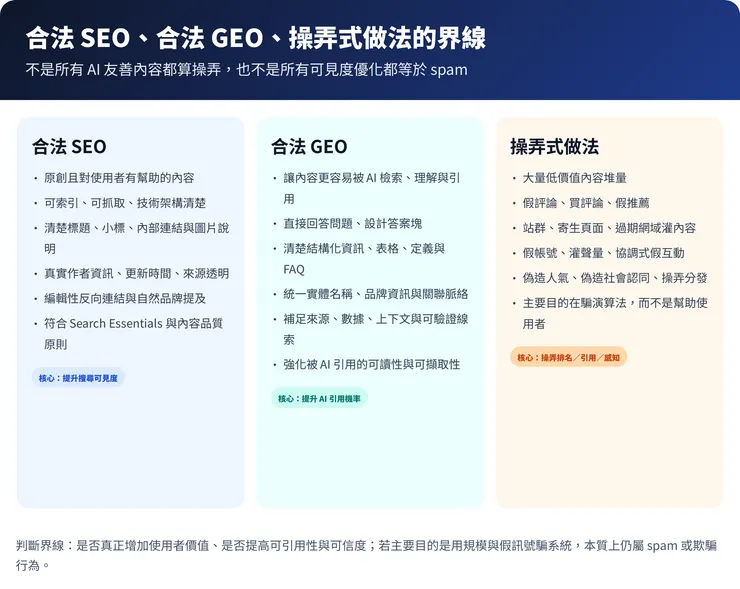

Google 現在打擊的不是 AI 本身,而是「用規模去操弄」

Google 的 spam policies 已經把這件事講得很清楚。所謂 scaled content abuse,指的是大量生成頁面,主要目的在操弄搜尋排名,而不是幫助使用者;而且官方直接強調,這種濫用行為不管是怎麼製作的都可能違規。問題不是人工寫還是 AI 寫,而是內容是否以規模化、低價值、非原創的方式去騙排名。

Google 也同步把 expired domain abuse 和 site reputation abuse 納入政策。也就是說,過期網域重生灌垃圾、寄生在高權重網站上發第三方操弄內容,現在都已經被明確列為打擊對象。

這件事對「網軍是否還有用」的意義非常大。因為它代表一個時代的結束:以前很多灰黑操作是在賭平台還沒定義、還沒抓到、還沒公開寫進規則;但現在 Google 已經不是模糊勸導,而是把這些玩法直接寫進官方政策裡。

網軍現在還能影響 Google 搜尋嗎?

可以短期干擾,但很難長期穩定操控。

Google 在 2024 年 3 月說明 core update 與 spam policies 更新時,公開表示這些改動的目標之一,是減少低品質、非原創內容出現在搜尋結果中。Google 當時甚至預估,整體改善完成後,這類結果可減少約 40%。

這不代表所有垃圾內容都會一夜消失,但至少證明官方已把問題定義成搜尋品質核心議題,而不是零星個案。

所以今天如果還有人用網軍式方法想影響 Google,真正可能發生的通常不是「穩穩洗上去」,而是:

在競爭低、資料稀薄、系統還沒反應過來的領域短暫冒頭。

在站點還沒被完整識別前,暫時取得一些可見度。

但這和「能穩定洗 Google」是兩回事。因為現在只要你的操作方式符合規模化操弄的典型結構,本身就已進入 Google 明文政策的紅區。

網軍能洗 AI Overviews 或 AI Mode 嗎?

比傳統搜尋更難。

Google 官方對站長的說法很明白:想出現在 AI Overviews 或 AI Mode 的 supporting links 中,頁面必須先被索引,且必須有資格在 Google Search 中以 snippet 形式顯示。這句話的真正意思是:AI features 不是一條繞過搜尋基本盤的捷徑。

更重要的是,Google 也說 AI Overviews 和 AI Mode 可能使用 query fan-out,也就是在子主題與不同資料來源中發出多個相關搜尋,找出更多 supporting pages 來生成回答。

這會直接削弱傳統網軍思維裡那種「只要把某句話洗到看起來很多人都在講,AI 就會吃進去」的幻想。因為主流 AI 搜尋或 AI 摘要系統越來越不是單點式抓資料,而是多來源、多子查詢、多條件篩選。

這不代表資料污染不可能發生,而是代表:污染輸入環境比污染最終答案容易得多。

真正可能被影響的,不是 AI 本身,而是 AI 所看到的公開資料環境

今天坊間很常見的說法,是「網軍可以洗 AI」「可以操弄主流模型」「可以把某敘事灌進 AI」。這種講法太粗,也太容易誤導。

比較準確的描述應該是:

一般網軍操作較可能做到的是污染公開資料池、增加某些敘事在網路上的可見度、短期干擾某些可檢索來源;但目前沒有公開的一手官方證據,能證明這些做法可以長期、穩定、系統性地改寫主流模型的訓練資料池或核心引用邏輯。

這個區分非常重要。因為 AI 系統至少有兩層:

一層是模型本身的預訓練與後續調整。

另一層是即時檢索、引用、摘要、回答時所看到的網頁世界。

前者不是一般灌文、灌站、灌評論就能直接碰到的;後者則確實可能受到低品質來源、假討論、假口碑與大規模內容污染影響。也就是說,真正存在的風險更像是資料池被污染,而不是 AI 被直接洗腦。

GEO 的真正價值,不是灌量,而是被引用

GEO 之所以會紅,是因為大家開始意識到:AI 搜尋與 AI 答案系統不只是排名問題,而是被不被引用、怎麼被引用、在哪些查詢情境被引用的問題。

Bing 在 2026 年推出的 AI Performance 幾乎就是這件事最直接的官方證明。Microsoft 公開說,這個儀表板會顯示你的網站在 AI-generated answers 中何時被引用,並提供 total citations、average cited pages 等指標。

這也說明,真正有價值的 GEO,並不是去洗大量重複內容、偽造討論熱度或堆假評論,而是讓內容更容易被檢索、理解、引用與信任。

Google 在 AI features 文件裡講的,仍然是索引、snippet eligibility、Search technical requirements;Bing 提供的,也不是灌量工具,而是引用追蹤。這條路線的核心是可引用性,不是可灌水性。

所以如果有人把 GEO 講成「新版黑帽 SEO」「洗 AI 的新技巧」,這種說法至少在目前官方訊號上站不住腳。更合理的說法是:

合法 GEO 是讓內容更容易成為 AI 候選答案;操弄式 GEO 一旦落入大規模低價值內容生產,本質上仍然只是 spam。

社群平台仍然是網軍最可能短期有感的地方

如果要說今天哪裡還最容易被網軍式操作短期干擾,答案不是 Google,也不是 AI Overviews,而更可能是社群平台的即時分發與互動環境。

原因很簡單:社群平台本來就更看互動、更看話題、更看擴散速度;只要系統在最初幾輪分發時誤把不真實互動當成真實熱度,操弄者就有機會暫時製造「很多人在講」「很多人支持」「很多人反對」的視覺假象。

但平台自己也很清楚這件事。

Meta 2025 年 4 月就公開表示,Facebook 上太多 spammy content 正在擠壓真實創作者,因此會對 gaming distribution and engagement、用 spam 內容灌 Feed 的帳號降低觀看與變現能力,並且更積極處理 impersonation。Meta 也明講,對於協調式假互動,會減少其可見度;同時指出 2024 年已移除超過 1 億個涉及 scripted follows abuse 的 fake Pages。

Meta 的政策頁也把 inauthentic behavior 寫得很清楚:這不是單篇內容是否真假而已,而是由同一人或團體控制的、不真實資產網路,透過欺騙方式誤導使用者對身分、來源、目的或人氣的判斷。

X 也一樣。X 的 authenticity policy 明寫:不允許任何透過 inauthentic accounts, behaviors, or content 來操弄平台或破壞服務完整性的行為。

Reddit 的語境不同,但本質相同。Reddit 明文禁止 manipulate votes、evade enforcement 或 disrupt communities。對 Reddit 而言,協調投票、群體出征、外部導流灌票,本來就是破壞社群運作的干擾行為。

所以社群平台的真相不是「網軍沒用了」,而是:它在社群場景裡仍可能有短期干擾效果,但平台現在抓的不是只看內容本身,而是看整個行為模式與資產網路。

假評論、買評論、洗評論,今天已經是法律風險

FTC 在 2024 年 8 月正式宣布 final rule,禁止 fake reviews and testimonials 的販售與購買,並明確指出這項規則可用來對 knowing violators 尋求 civil penalties。

最值得注意的是,FTC 並沒有把 AI 生成當成免責理由。相反地,這套規則的語境就是:不管是人寫的、買來的、還是 AI 生成的,只要本質上是假評論、假推薦、假口碑,它就可能構成違規。

這代表今天仍有人用網軍式方法操作 Google Maps、商家評價、品牌聲譽,不是因為它沒有風險,而是因為它在某些場景仍有短期誘因:例如先墊高星等、先壓低對手、先製造社會認同。

但它也已經從灰色口碑技巧進入明確法律風險區。

2026 年的真相:網軍更像干擾器,不再是穩定的演算法武器

所以回到最初那個問題:網軍能洗 AI 嗎?

最準確的答案不是單純的能或不能,而是:

它可以污染 AI 所看到的部分公開資料環境,但越來越難穩定控制主流搜尋、AI 摘要與 AI 引用層的最終結果。

再說得更直白一點:

它對 Google 搜尋的長期效果已明顯下降。

它對 Google AI Overviews/AI Mode 的直接操弄難度更高。

它對 GEO 的幫助非常有限,因為真正有價值的 GEO 是被引用,而不是被灌水。

它在社群與評論系統裡仍可能有短期效果,但平台規則與執法密度都在提高。

它最真實的威脅,不是穩定洗掉演算法,而是短期污染資料池、製造噪音、扭曲感知與拖低整體資訊品質。

今天這套玩法沒有完全消失,但它正在失去最核心的優勢。它不再是穩定放大成果的方法,而越來越像一種高風險、短效、可被追蹤、甚至可能引來平台與法律反噬的干擾手段。

真正能長期留下來的,不是更會洗,而是更值得被引用、更值得被信任的內容。

結語

說到底,2026 年的網軍問題,已經不是「還能不能作弊成功」這麼簡單,而是平台與 AI 系統正在把這場對抗,從「抓單篇垃圾內容」升級成「辨識整套操弄結構」。這意味著,真正還能留下來的,不會是更會洗、更會灌、更會偽造熱度的人,而是那些能持續提供原創、可信、可引用內容的人。對企業、品牌、內容站與創作者來說,這也是最現實的分水嶺:短期噪音或許仍能製造表象,但長期能見度與 AI 引用權,終究只會留給更值得被信任的內容。

如果你想先釐清另一個更基礎的問題:為什麼很多 AI 一鍵生成的網站,明明已經上線,卻還是很難被 Google 正常發現、索引與理解,可以接著看這篇:

〈為什麼 AI 一鍵生成的網站,Google 搜尋不到?從渲染、索引到內容品質,一次看懂真正原因〉