訓練自己的 AI 產圖模型(Image Generation Model),大致有三種難度等級:

1️⃣ 微調現成模型(最常見)2️⃣ 訓練自己的風格模型

3️⃣ 從零訓練整個擴散模型

以下是一個 現實可行的完整路線圖(很多獨立創作者都這樣做)。

一、AI 產圖模型的核心架構

目前主流都是 擴散模型(Diffusion Model),代表模型例如:

- Stable Diffusion

- DALL·E

- Midjourney

擴散模型本質流程:

文字 → CLIP編碼 → latent diffusion → 圖像生成

核心組件:

- Text Encoder

理解文字 prompt - U-Net diffusion model

逐步把噪聲變成圖片 - VAE(變分自編碼器)

latent ↔ image 轉換

二、最容易的方式:微調模型(推薦)

你不需要從零開始。

最常見方法:

如果你有 RTX 4090 或 RTX 6000,都可以跑。

三、LoRA 訓練流程(最流行)

LoRA = Low Rank Adaptation

優點:

- 訓練很快

- 模型很小(50MB)

- 可以疊加

例如:

base modelStable Diffusion XL

+LoRA

武俠風格

1 準備資料集

例如你想訓練:

- 武俠人物

- 中國古風

- 唐代場景

你需要

50–500 張圖片

要求:

- 高品質

- 同風格

- 512~1024px

資料夾:

dataset/

001.png

002.png

003.png

2 打標籤(caption)

每張圖要描述:

例如

Tang dynasty swordsman

ancient Chinese armor

martial arts warrior

工具:

- BLIP

- DeepDanbooru

3 安裝訓練工具

最常用:

- kohya-ss

GitHub:

git clone https://github.com/kohya-ss/sd-scripts

4 訓練 LoRA

基本命令:

accelerate launch train_network.py \

--pretrained_model_name_or_path="stable-diffusion-xl" \

--train_data_dir="dataset" \

--resolution=1024 \

--output_dir="lora_model" \

--network_dim=128 \

--train_batch_size=2 \

--max_train_steps=2000

5 載入使用

在生成模型中載入:

- AUTOMATIC1111

- ComfyUI

prompt:

Tang dynasty warrior, wuxia style <lora:wuxia_style:1>

四、如果要訓練自己的「武俠世界模型」

你可以建立:

武俠世界資料庫

例如你正在寫的 開元年間武俠小說

資料:

華山派

唐朝鎧甲

絲路商隊

敦煌

胡人

唐代宮廷

甚至可以加入角色:

- 公孫嫣

- 軋犖山

- 康延年

每個角色 50 張圖。

模型就能生成:

公孫嫣 standing on huashan cliff

Tang dynasty wuxia heroine

這其實就是 世界觀模型。

五、如果要從零訓練模型(很難)

例如:

訓練一個類似 Stable Diffusion 的模型。

需要:

1000萬~10億圖片

GPU:

256–2000 GPU

訓練成本:

$1M – $100M例如:

- Stable Diffusion XL

- Imagen

六、最強玩法(AI 創作者)

高手通常會建立:

AI 創作 pipeline

ChatGPT

↓生成 prompt

Stable Diffusion

↓生成角色

ControlNet

↓控制姿勢

Upscale

↓4K圖片

其中:

- ControlNet

可以控制:

- 姿勢

- 骨架

- 透視

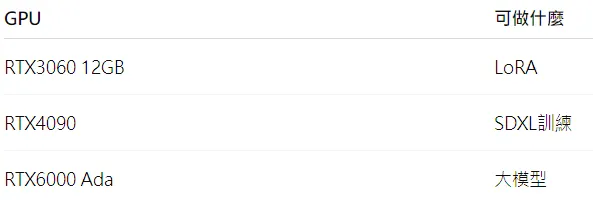

七、最低硬體需求

八、如果目標是「武俠漫畫 / 電影級」

你可以建立:

武俠 diffusion 模型

+

角色 LoRA

+

場景 LoRA

例如:

Huashan

Tang palace

Silk Road caravan

最後 AI 就能生成整個 武俠宇宙。

這其實很適合正在讀的 唐玄宗武俠世界。