雖然「中文資訊密度高、構詞邏輯強」的說法在文化層面極具吸引力,但在計算機科學與神經網絡的底層邏輯下,這個觀點存在幾個根本性的認知誤區:

一、 誤將「人類的聯想」等同於「機器的運算」

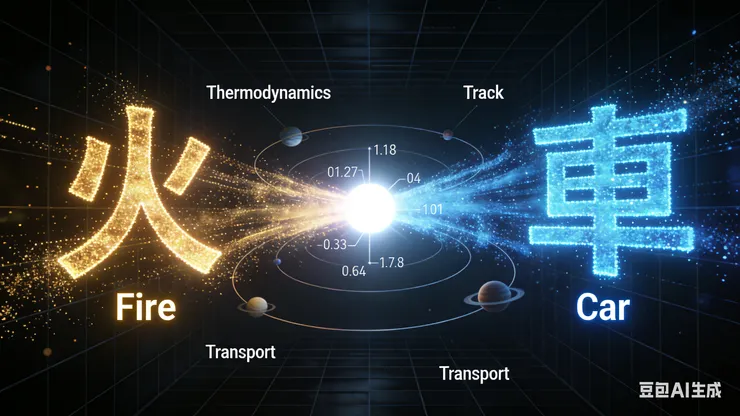

支持者常舉例「火 + 車 = 火車」說明中文邏輯簡潔,但這對 AI 來說並無意義。- 向量空間的真相: AI 處理概念時,是將單詞轉換為數百維的數學坐標(Embedding)。在 AI 的內部世界,

Fire + Car與火 + 車的關聯運算難度是完全等同的。 - 特徵提取不需要字面: AI 不需要看到「火」字才知道火車會發熱。透過海量數據學習,

Train這個符號早已在向量空間中緊鄰「熱能、軌道、運輸」。英文詞彙雖多,但在高維數學面前,其關聯性比中文的字面組合更精確、歧義更少。

二、 簡潔的代價:高度歧義性(Ambiguity)

中文支持者誇讚的「簡潔」,在計算科學中往往意味著低資訊冗餘,這反而是 AI 的噩夢。

- 切詞難題: 英文單詞間有空格,邊界清晰。中文「乒乓球拍賣完了」可以是「乒乓球/拍賣/完了」或「乒乓球拍/賣完了」。

- 上下文負擔: 中文缺乏時態(-ed, -ing)與語法標記(冠詞、主賓格)。這導致 AI 必須耗費額外的注意力機制(Attention)權重去「猜」主語是誰、動作何時發生。這種「語法降噪」其實變相增加了推理的計算成本與出錯率。

三、 Tokenizer(分詞器)的底層不平等

這不只是「格式問題」,而是導致了 AI 的「邏輯破碎化」。

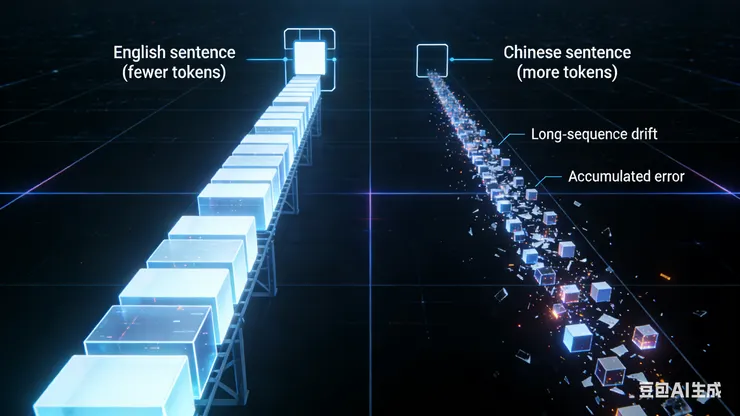

- 資訊密度悖論: 目前主流模型(如 GPT-4)是以英文為中心設計的。一個中文漢字常被拆成 2 到 3 個 Token。

- 序列長度過長: 同樣的邏輯推理,英文可能只需 10 步(Token)完成,中文卻要 25 步。在神經網絡中,序列越長,累積誤差就越大,且更容易在長文本中「斷片」,這直接削弱了中文在處理複雜長邏輯時的效能。

四、 數據品質與「二級翻譯」效應

AI 的智慧不來自語言結構,而是來自數據質量。

- 英語的霸權: 全球頂尖的原始碼、科研論文與哲學辯論大多以英文記錄。

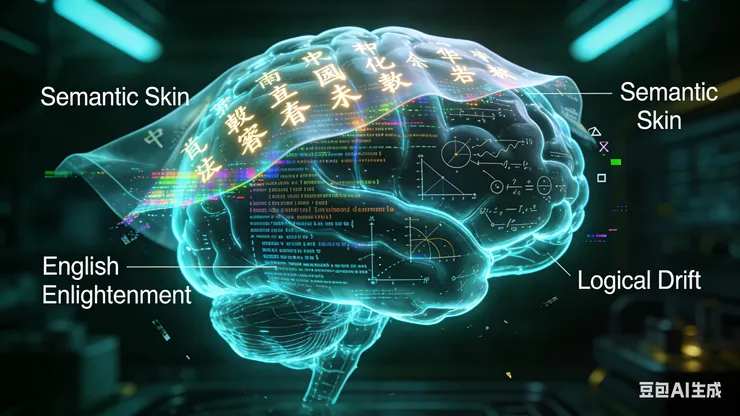

- 核心邏輯漂移: 目前的大型模型,底層邏輯大多是在英文數據上「開悟」的,中文更像是一層掛在上面的語義皮套。要求 AI 用中文思考,就像要求一個母語是英文的天才用中文做微積分,轉換過程中必然產生邏輯損耗。

五、 誤解了「高維壓縮」的本質

「成語是函數」的說法看似美妙,但在數學上站不住腳。

- 壓縮不等於優化: 在資訊理論中,過度壓縮會導致資訊丟失。英文透過細膩的語法細節提供精確的「導航指令」;中文的微言大義則需要 AI 進行大量的「解壓縮」補全,這反而增加了產生幻覺(Hallucination)的風險。

核心結論:

「中文適合 AI」的觀點,錯在將「人類的閱讀美感」與「機器的運算邏輯」混為一談。

事實上,AI 並不在意語言的「長相」,它在意的是特徵的清晰度與計算的收斂速度。在現有的計算架構下,語法嚴謹、邊界清晰且擁有最強數據遺產的英語,仍是 AI 真正的高速公路。