一、 核心運作邏輯解析

根據預設產生的 app.py 檔案,你的機器人主要由三個部分組成:

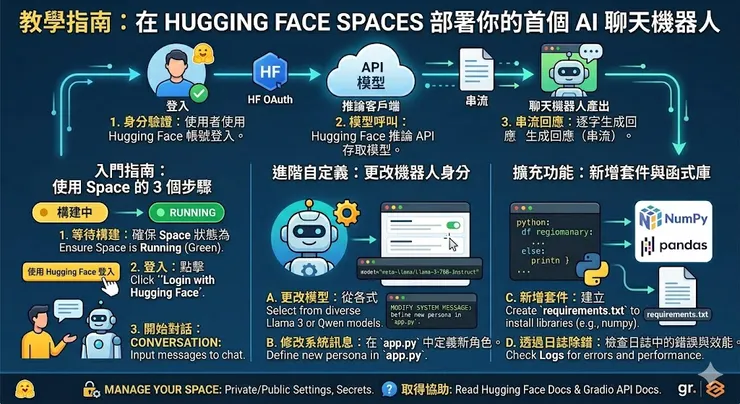

- 身分驗證(OAuth 登入) 在

README.md中設定了hf_oauth: true,這會在側邊欄產生一個登入按鈕。當使用者登入後,系統會自動抓取使用者的 Token 並傳遞給後端,這樣 API 的算力消耗就會由使用者負擔,而非開發者本人。 - 模型調用(Inference Client) 程式碼中使用

InferenceClient連結到 Hugging Face 的伺服器。目前預設調用的模型是openai/gpt-oss-20b,這是一個示範用的開源模型。 - 串流輸出(Streaming Response) 透過

yield語法,機器人的回答會像打字機一樣一個字一個字跳出來,提供更流暢的使用體驗。

二、 如何開始使用你的 Space?

- 等待部署完成:在 Space 頁面頂部,當標籤從黃色的「Building」變成綠色的 Running 時,代表你的應用程式已準備就緒。

- 執行登入動作:點擊左側側邊欄的 "Login with Hugging Face"。請放心,這是為了獲取調用 API 的權限。

- 開始對話:登入後即可在輸入框內提問。你可以透過底部的 Slider(滑動條)調整 Temperature(溫度值)來改變機器人說話的隨機性。

三、 進階自定義:打造獨一無二的助手

如果你想修改這個機器人,讓它變得更聰明或更符合你的需求,可以從以下三個方向著手:1. 更換更強大的模型

你不一定要使用預設模型。你可以到 Hugging Face 的 Model 庫尋找支援 Inference API 的模型(如 Llama 3 或 Qwen)。只需在 app.py 中將 model="openai/gpt-oss-20b" 修改為你心儀的模型名稱即可。

2. 設定「系統提示詞」(System Message)

在 additional_inputs 區塊中,你可以修改 gr.Textbox 的預設值。例如,如果你想讓它成為程式專家,可以將預設內容改為:「你是一位精通 Python 與 React 的資深工程師,請用簡潔的代碼回答問題。」

3. 擴展功能套件

如果你需要引入額外的 Python 套件(例如運算用的 numpy),請在 Files 頁面新增一個 requirements.txt 檔案,並將套件名稱寫入其中,系統會自動幫你安裝。

四、 管理與除錯小訣竅

- Logs(日誌):如果機器人發生錯誤,點擊右上角的「Logs」查看後端報錯,這是解決問題的第一步。

- Settings(設定):你可以隨時切換 Space 的權限(Public 或 Private)。如果你未來想開發更複雜的功能,也可以在這裡設定祕密變數(Variables and Secrets)。

結語

透過 Hugging Face 與 Gradio 的結合,開發一個 AI 應用不再是遙不可及的事情。這個模板為你搭好了最基礎的骨架,接下來就看你如何發揮創意,為它注入不同的靈魂了!