用一項技術,看懂iPAS AI 中級考點與 AI 技術應用、數學基礎與系統架構的真正關鍵

嗨 我是CCChen

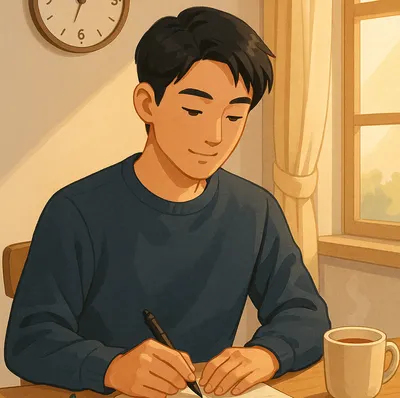

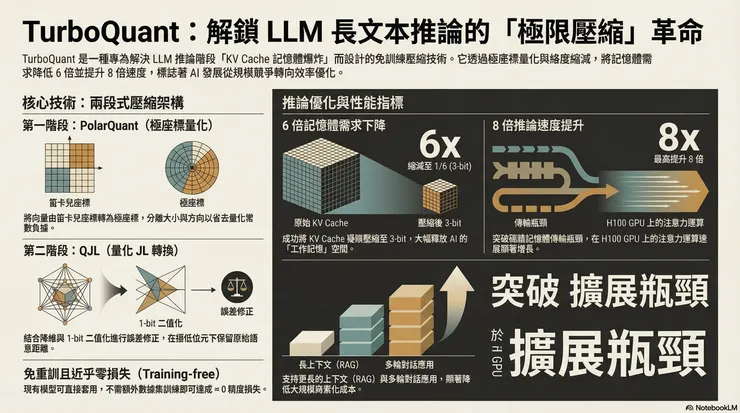

外媒報導,Google 研究團隊於日前正式發表了一項名為「TurboQuant」的全新免訓練(training-free)壓縮演算法。

這項革命性的技術能夠將大型語言模型的鍵值快取(KV caches)大幅壓縮至僅剩 3 位元(3 bits),且過程完全不會造成模型準確度的損失。

知識補充:

TurboQuant 是一種專門針對大型語言模型(LLM)推理階段的「KV Cache(鍵值快取)壓縮技術」,其核心目的在於透過極限的量化與降維,解決 AI 處理長文本時的記憶體瓶頸

當我看到這一則新聞時,腦海中忽然浮現最近準備的iPAS AI 中級授課教材中,整理的許多關鍵技術名詞與考點。

原來這些技術,在iPAS AI 中級考試裡早就出現相關聯的技術原理與概念。

於是我一一分析與比對,整理出Google TurboQuant壓縮技術與iPAS AI 中級三大考科的考點分析整理。

一、TurboQuant 技術解析:AI 推論時代的關鍵突破

最近在 AI 技術圈引起高度關注的,是 Google 推出的 TurboQuant 技術。表面上,它是一種「模型壓縮演算法」,但如果從 AI 系統架構角度來看,它其實代表了一個更重要的趨勢轉變:

AI 發展重心,已從「模型訓練」轉向「推論優化(Inference Optimization)」

1. 為什麼 TurboQuant 重要?

在大型語言模型(LLM)應用中,有一個非常關鍵但常被忽略的瓶頸: KV Cache(Key-Value Cache)

這是 Transformer 模型在推論時,為了避免重複計算 attention 而儲存的中間資料。

問題是:

- 長文本 → KV Cache 爆炸成長

- 多輪對話 → 記憶體需求倍增

- 即時應用 → 延遲與成本上升

2. TurboQuant 的核心能力

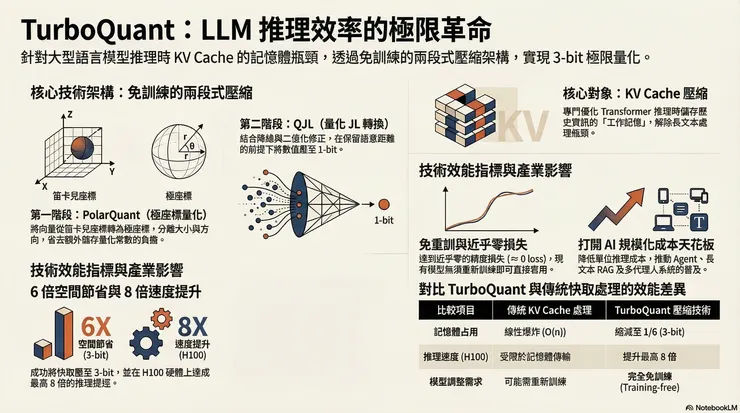

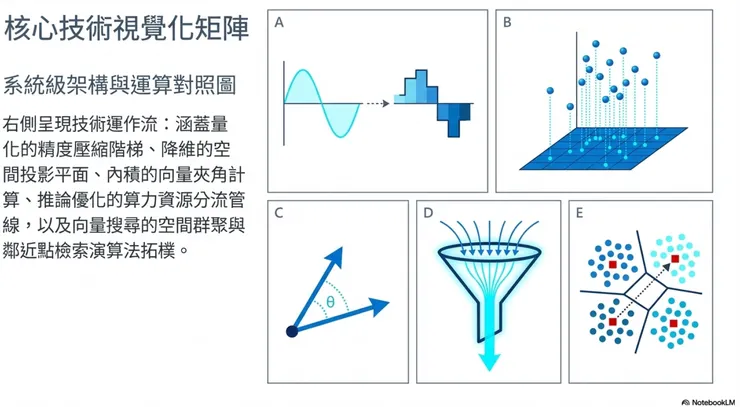

TurboQuant 的設計,本質上做了三件事:

(1) 向量壓縮(Vector Compression)

將高維 KV Cache 向量進行壓縮,但仍保留關鍵資訊

(2) 量化(Quantization)

用更低精度表示數據,降低記憶體使用

(3) 相似度保留(Distance Preservation)

透過數學方法(類似 Johnson-Lindenstrauss 概念),確保向量距離不失真

3. 技術成果(關鍵數據)

- 記憶體降低:約 1/6

- 推論速度提升:約 8倍

- 不需重新訓練模型(這點非常關鍵)

4. 技術本質

TurboQuant = 在不改變模型的前提下,讓推論更快、更省、更穩

這件事的重要性在於:

📌 未來 AI 競爭,不再只是「誰模型大」

📌 而是「誰能在有限資源下跑得更有效率」

二、TurboQuant 對應 iPAS AI 中級三大考科

這一段,是考試最核心的部分。我們直接對齊官方學習指引架構:

科目一:人工智慧技術應用與規劃

根據指引:

- AI 技術應用(NLP / CV / GenAI)

- AI 導入評估

- AI 系統部署

TurboQuant 對應考點

👉 命題方向:

- AI 系統效能瓶頸在哪?

- 如何優化模型部署?

- inference vs training 差異

🔹科目二:大數據處理分析與應用

對應章節:

- 數據處理

- 向量資料

- AI 與大數據整合

📌 TurboQuant 對應

關鍵觀念: AI 已從「資料分析」進入「向量資料工程」

科目三:機器學習技術與應用

根據學習指引:

- 機率統計

- 線性代數

- 最佳化

📌 TurboQuant 對應數學

學習指引明確提到:

- 高維資料需要壓縮

- 降低計算成本

這正是 TurboQuant 的核心!

三、TurboQuant 對應iPAS AI中級11月公開試題的比較分析

這一段,我用「考試題目比較的角度」來拆解。

1. 科目一(技術應用題)

例如公開題:情感分析題 / Transformer 機制題

對應 TurboQuant

- Transformer attention → KV Cache

- long context → memory problem

未來可能題型:

為何長文本會造成效能下降?

KV Cache 增加 / 記憶體爆炸

2. 科目三(數學計算題)

公開題:

- PCA

- 矩陣運算

- 向量內積

對應 TurboQuant

本質完全一致:

- 降維

- 保留變異

- 降低計算

可能題型:

哪種方法可降低高維運算成本?

PCA 降維/ Quantization量化

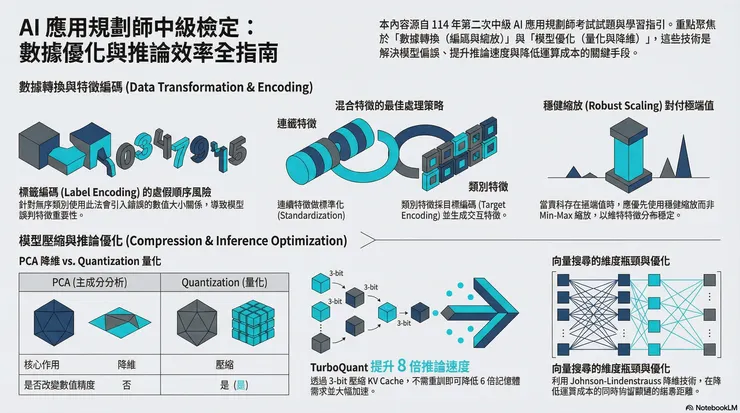

**PCA = 降維(減少特徵數)

**Quantization = 壓縮(降低數值精度)

3. 科目二(資料應用題)

公開題常考:

- ETL

- 資料處理

- 資料分析

TurboQuant 對應

升級的版本:

- 向量資料處理

- embedding optimization(嵌入向量優化)

- 檢索效率

**Embedding Optimization = 讓向量更準、更省、更快的所有技術集合

命題趨勢:從「資料分析」→「AI系統效率」

彙整 114 年第二次中級 AI 應用規劃師考試中,涵蓋「資料壓縮、量化、降維、資料轉換、優化推論、向量搜尋」等核心概念的相關試題整理:

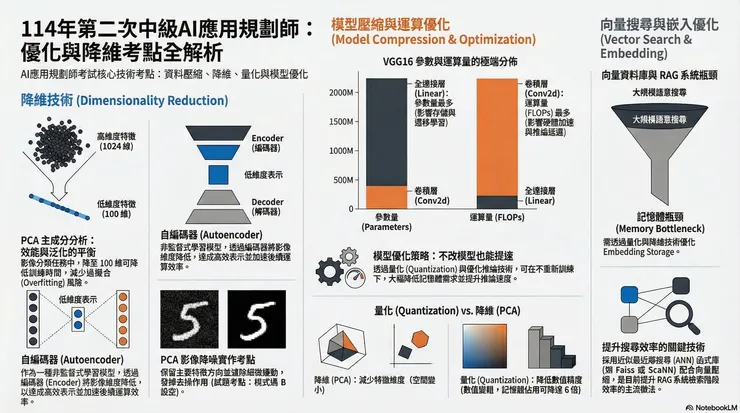

一、 降維技術 (Dimensionality Reduction)

降維技術常用於特徵壓縮、加速運算以及去除雜訊,是優化模型的重要前處理步驟。

- 【第一科 - PCA 主成分分析】 影像分類任務嘗試利用 PCA 將輸入特徵從 1024 維降至 100 維,再輸入 SVM 模型訓練。關於此作法最合理的描述為: 正確答案:(D)降維後可降低訓練時間並減少過擬合(Overfitting)風險。

- 【第三科 - 自編碼器 Autoencoder】 在深度學習中,自編碼器(Autoencoder)最主要的功能為: 正確答案:(B)降低影像維度以加速運算效率。

- 【第三科 - PCA 影像降噪實作】 研究人員發現手寫數字影像有雜訊,嘗試使用 PCA 進行降噪,若要修改程式碼讓 PCA 發揮去噪作用: 正確答案:(B)程式碼 B。

二、 模型壓縮與優化推論 (Model Compression & Inference Optimization)

為了提升推論效率與硬體加速,了解神經網路各層的參數與運算量是模型壓縮(如量化、剪枝)的基礎。

- 【第三科 - 參數量分佈與模型壓縮】 了解參數分佈情形有助於模型壓縮與遷移學習設計。在 VGG16 中,參數量(parameter count)最多的是: 正確答案:(B)全連接層(Linear)。

- 【第三科 - 運算量分佈與硬體加速】 了解各層的運算量分佈有助於模型壓縮與硬體加速策略設計。在 VGG16 中,運算量 (FLOPs) 最多的是: 正確答案:(A)卷積層(Conv2d)。

三、 向量搜尋 (Vector Search)

向量搜尋是當前大型語言模型(LLM)與 RAG 系統解決資訊檢索與推論優化的核心環節。

- 【第一科 - RAG 系統的向量檢索挑戰】 檢索增強生成(RAG)結合語言模型與向量搜尋技術。若要建立高效能 RAG 系統,在「檢索階段」最關鍵的挑戰為: 正確答案:(D)避免向量檢索結果僅具語意相似但與查詢意圖無實質關聯的情況。

四、 資料轉換與特徵編碼 (Data Transformation & Encoding)

資料轉換(如標準化、正規化、編碼)是確保模型能正確理解數據、避免演算法收斂失準的關鍵。

- 【第一科 - 混合特徵型態的轉換作法】 同時包含連續型與類別型特徵的資料集,提升模型整體表現最合適的特徵工程為: 正確答案:(C)對連續特徵做標準化(Standardization),類別特徵採用目標編碼(Target Encoding),並生成交互特徵提升模型表現。

- 【第二科 - Label Encoding 的潛在風險】 使用 Label Encoding 將類別變數轉換為數字型態時,最常見的潛在風險為: 正確答案:(B)會引入類別之間的虛假順序關係。

- 【第二科 - 樹狀模型的類別轉換注意事項】 針對包含「一般、白金、黑卡」三種類別的會員等級欄位,使用梯度提升樹(GBT)建立預測模型時應注意: 正確答案:(B)直接使用標籤編碼(Label Encoding)可能使模型誤判類別間存在順序關係,導致特徵重要性偏誤。

- 【第二科 - 資料轉換的錯誤觀念釐清】 關於類別型與數值型資料格式的處理,下列敘述何者不正確: 正確答案:(C)標準化(Standardization)...會將數值範圍壓縮至 0 至 1 之間(註:標準化是平移縮放使平均值為0、標準差為1,不會強制壓縮在0到1之間)。

- 【第二科 - 存在極端值的數值轉換】 在進行數值特徵標準化時,若資料中存在極端值(Outliers),最適合使用的方法為: 正確答案:(C)穩健縮放(Robust Scaling)。

四、整體iPAS命題趨勢

結論:

舊考法(2025以前):名詞記憶+工具操作

新考法(2026):系統思維 + 技術整合

TurboQuant 就是典型題材:

跨 NLP + 系統 + 數學

跨部署 + 優化 + 架構

這種新型的題目:不是背答案能解,而是理解架構

五、CCChen觀察與專業觀點

這一年在帶 iPAS AI 初級與中級考生的過程中,我很明顯感受到一個趨勢的轉變:

AI 考試,不再只是「考你會不會」,而是「考你能不能理解」。

TurboQuant 這類技術的出現,其實給了我們一個很重要的提醒——AI 的進步速度,遠遠超過任何教材更新的速度。

今天你背熟了一個模型,明天可能就出現一個更有效率的版本;但如果你理解了背後的原理,那你就能快速吸收新的技術。

我常跟學員說一句話:真正的競爭力,不是知道多少工具,而是理解多少原理。

以 TurboQuant 為例,如果你只是把它當成一個「新名詞」,那在考試中幾乎沒有幫助。但如果你能拆解它:

- 為什麼要壓縮?

- 為什麼可以降維?

- 為什麼不需要重訓?

- 為什麼速度會變快?

那你其實已經掌握了:

線性代數/模型推論/系統架構 / AI效能優化

這些正是 iPAS AI 中級評鑑考試真正想評估的能力。

另一方面,從產業角度來看,TurboQuant 也反映了一個現實:

未來 AI 的關鍵,不只是「模型能力」,而是「落地效率」

企業在導入 AI 時,最常遇到的問題不是模型不夠準,而是:太慢/太貴/太耗資源

而能解決這些問題的人,才是真正的 AI 應用規劃師。

這也是為什麼,我一直強調「跨領域學習」的重要性。

AI 不只是 AI,它同時包含:

- 數學(模型原理)

- 工程(系統部署)

- 商業(成本與效益)

- 法規(治理與風險)

當你能把這些串起來,你就不只是考試通過,而是具備真正的職場競爭力。

最後,我想給正在準備 iPAS AI 中級的你一個建議:

不要急著追最新技術,而是先把基礎打穩。

因為所有再新的技術,本質都來自同一套核心: 數學 + 結構 + 邏輯

當你掌握這三件事,你不只是跟上 AI,而是能走在 AI 前面。

總結:

TurboQuant 透過 PolarQuant + QJL 雙階段壓縮,將 LLM 的 KV Cache 壓縮至約 3-bit,在幾乎不影響精度的情況下降低記憶體需求達 6 倍。

其核心價值在於「不需重新訓練模型」,即可大幅提升推論速度(最高約 8 倍)並降低 AI 運算成本。

TurboQuant 本質屬於「量化+降維+推論優化」的整合技術,代表 AI 發展從模型擴大轉向效率優化的重要趨勢。

— CCChen 心語

技術會更新,但原理不會

真正能帶你走遠的,是你對本質的理解,而不是對工具的依賴。