我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

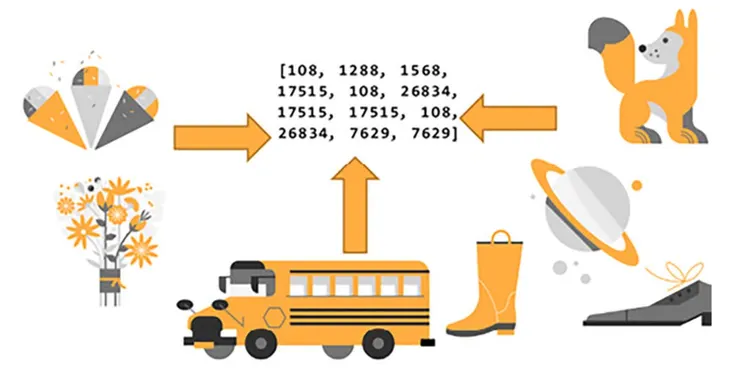

Transformer 模型的抽象層次使其產生多模態神經元,多模態神經元可以處理被標記為像素或影像區塊的圖像,然後將其作為詞彙在視覺 Transformer 中處理,一旦圖像被編碼後,Transformer 模型便將這些標記視為任何詞彙標記,如下圖所示:

我們將闡述以下類型的 Transformer 模型:

- ViT:Vision transformers that process images as patches of words

- CLIP:Vision transformers that encode text and images

- DALL-E:Vision transformers that construct images with text