多模態人類影片生成高度逼真動畫

OmniHuman-1 技術解析

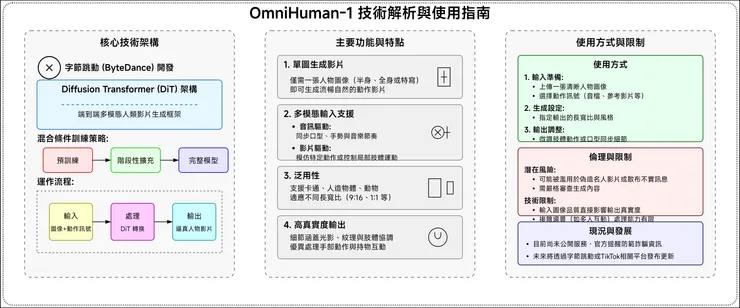

OmniHuman-1 是由字節跳動(ByteDance)開發的端到端多模態人類影片生成框架,可透過單一人物圖像與動作訊號(如音訊、影片或姿勢數據)生成高度逼真的人類動畫。其核心基於Diffusion Transformer(DiT)架構,結合混合條件訓練策略,解決傳統方法因高品質數據稀缺導致的限制。

主要功能與特點

單圖生成影片:僅需一張人物圖像(半身、全身或特寫),無需複雜數據集即可生成流暢動作。

多模態輸入支援: 音訊驅動:同步口型、手勢與音樂節奏,適用於虛擬歌手或演講內容。

影片驅動:模仿特定動作(如舞蹈),或結合音訊與影片控制局部肢體。

泛用性:支援卡通、人造物體、動物,並適應不同長寬比(如直式9:16、正方形1:1)。

高真實度輸出:細節涵蓋光影、紋理與肢體協調,尤其在處理手部動作與持物互動時表現優異。

技術架構

模型設計: OmniHuman 主模型:整合文字、圖像、音訊、姿勢等輸入,透過Transformer區塊生成逐幀特徵。

混合條件訓練:分階段強化多模態處理能力: 預訓練:文字到影片(T2V)與文字輸入。

階段性擴充:逐步加入圖像、音訊與姿勢數據。

運作流程:輸入圖像與動作訊號後,模型將訊號轉換為運動特徵,再透過DiT架構合成連續影格。

使用方式

輸入準備: 上傳一張清晰人物圖像。

選擇動作訊號(例如:音檔、參考影片或姿勢數據)。

生成設定:可指定輸出的長寬比與風格(如寫實或卡通)。

輸出調整:依需求微調肢體動作或口型同步細節。

倫理與限制

潛在風險:可能被濫用於偽造名人影片或散布不實訊息,需嚴格審查生成內容。

技術限制: 輸入圖像品質直接影響輸出真實度。

複雜場景(如多人互動)處理能力有限。

現況與發展

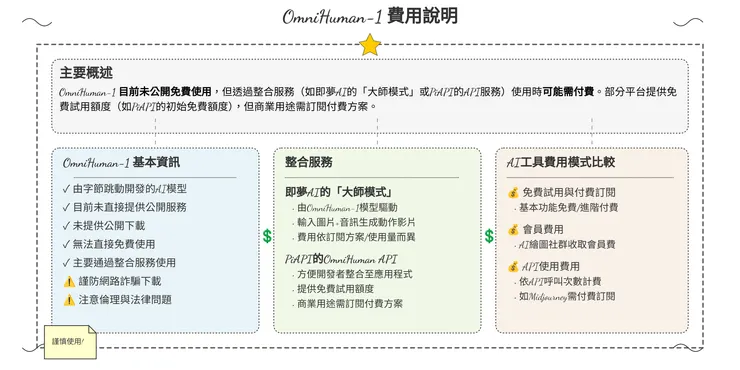

目前OmniHuman-1尚未公開服務,官方提醒防範詐騙資訊,未來將透過字節跳動或TikTok相關平台發布更新。

OmniHuman-1 詳細報告

OmniHuman-1 是字節跳動(ByteDance)開發的端到端多模態人類影片生成框架,能夠從單張人物圖像和動作訊號(例如音訊、影片或姿勢數據)生成高度逼真的人類動畫。 它基於Diffusion Transformer(DiT)架構,並採用混合條件訓練策略,克服了傳統方法由於高品質數據稀缺而面臨的限制。

主要功能與特點

單圖生成影片:僅需一張人物圖像(可以是半身、全身或特寫)即可生成流暢自然的動作影片,無需複雜的數據集或多個影格。

多模態輸入支援:

音訊驅動:能夠精確同步口型、手勢與音樂節奏,適用於製作虛擬歌手或演講內容。

影片驅動:能夠模仿特定動作(例如舞蹈),或者結合音訊與影片來控制局部肢體運動。

廣泛的適用性:支援卡通、人造物體、動物等多種主題,並且可以適應不同的長寬比,例如直式 (9:16) 和正方形 (1:1)。

高真實度輸出:產生的影片在光影、紋理和肢體協調等細節方面都表現出色,尤其是在處理手部動作和持物互動時。

技術架構

模型設計:

OmniHuman 主模型:整合文字、圖像、音訊、姿勢等多種輸入,透過 Transformer 區塊生成逐幀特徵。

混合條件訓練:模型訓練分為多個階段,以強化多模態處理能力:預訓練:使用文字到影片(T2V)以及文字輸入。

階段性擴充:逐步加入圖像、音訊和姿勢數據。

運作流程:在接收到輸入圖像和動作訊號後,模型會將這些訊號轉換為運動特徵,然後透過 DiT 架構合成連續的影格。

使用方式

輸入準備:上傳一張清晰的人物圖像。

選擇適合的動作訊號(例如:音訊檔案、參考影片或姿勢數據)。

生成設定:可根據需求指定輸出的長寬比和影片風格(例如寫實或卡通)。

輸出調整:根據需要微調肢體動作或口型同步等細節。

倫理與限制

潛在風險:OmniHuman-1 可能被濫用,例如偽造名人影片或散布不實訊息,因此需要對生成內容進行嚴格審查.

技術限制:輸入圖像的品質會直接影響輸出影片的真實度。

對於複雜場景(例如多人互動)的處理能力可能有限。

現況與發展

目前,OmniHuman-1 尚未公開服務,官方提醒用戶注意防範詐騙資訊。字節跳動將在未來透過其官方管道或 TikTok 等相關平台發布更新。

特性 描述

模型類型 多模態人類影片生成框架

開發者 字節跳動 (ByteDance)

核心架構 Diffusion Transformer (DiT)

主要輸入 單張人物圖像,動作訊號 (音訊、影片、姿勢數據)

主要功能 從單張圖像生成逼真人物影片,支援多模態輸入驅動,適用於不同主題和長寬比

應用場景 娛樂、媒體、虛擬實境,例如製作電影、電視節目、遊戲等

使用注意事項 注意倫理風險,確保內容適當及尊重他人

目前狀態 尚未公開服務,注意詐騙資訊

未來發展 將透過字節跳動或 TikTok 相關平台發布更新

DiT (Diffusion Transformer)是什麼 一種用於生成模型的深度學習架構,特別適用於圖像和影片生成任務。它結合了擴散模型和 Transformer 模型的優點,能夠產生高品質、高解析度的輸出。