什麼是ComfyUI

ComfyUI 是一款基於 Stable Diffusion 的 圖形化流程編輯器,用節點(Nodes)組合方式來建立 AI 圖像生成流程。它支援高度客製化與模組化,可以視覺化地控制提示詞、模型、解析度、風格、後處理等步驟。

簡單來說:它像是 AI 畫圖的樂高積木,只要拖拉組裝,就能做出自己專屬的圖片生成工作流。為什麼要學 ComfyUI?

✅ 1. 完全掌握 AI 圖像生成流程

ComfyUI 採用節點式流程設計,讓你可以直觀地掌控每一個步驟:

- 載入模型、設定提示詞、調整解析度、套用 LoRA 或 ControlNet… 全部自己決定順序與參數。

- 學會 ComfyUI = 學會了 AI 圖像從「文字 → 潛在空間 → 成品圖像」的完整轉換過程。

這不只是使用,而是理解整個系統的運作邏輯。

🎨 2. 創作自由度極高

與其他前端工具(如 WebUI、InvokeAI)相比:

- ComfyUI 可以自由組合節點、建立自己獨特的風格或流程。

- 你可以一次生成多張圖、批次測試不同 LoRA、甚至混合多個提示詞或模型。

- 你想要用 AI 做圖像風格實驗?做影片的逐幀生成?做貼圖、商品 mockup?只有 ComfyUI 能讓你這麼彈性操作。

🚀 3. 效率與自動化潛力

- 透過Loop節點、條件判斷節點等,可以讓你建立半自動化或全自動的創作流程。

- 結合如 ComfyUI Manager、圖形提示詞生成器、Upscaler 工具,你可以建立完整的 AI 輔助創作系統。

甚至可以讓你做到:

- 一鍵換角色情緒表情

- 批次生成不同構圖風格

- 為動畫製作每一幀畫面

這是你用其他工具無法做到的「創作工廠級別效率」。

我覺得

事實上也不用想太多, 如果您喜歡裝積木, 喜歡動手理解背後邏輯,喜歡自己掌握, 那麼ComfyUI就挺適合你的。

安裝

直接到 官網 下載, 依照指示一路安裝就可以了。

Windows 和 Mac 都可以安裝,Windows還有可攜版。

但是我建議使用 Windows + Nvidia RTX 40以上顯卡(至少12GB VRAM) 安裝 。

原因是Mac或是等級太低的顯卡, 一開始跑還可以,大型或是比較複雜一點的模型可能就沒有辦法了. 我會建議使用線上的平臺(可以看參考資料)。

操作

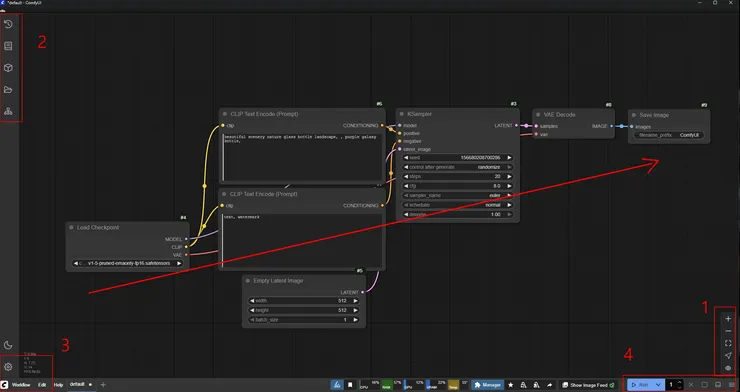

安裝完,執行ComfyUI就可以了,你會看到以下的畫面

會因為你的ComfyUI的版本不同所以介面會稍微長的不太一樣, 大體上是大同小異的。

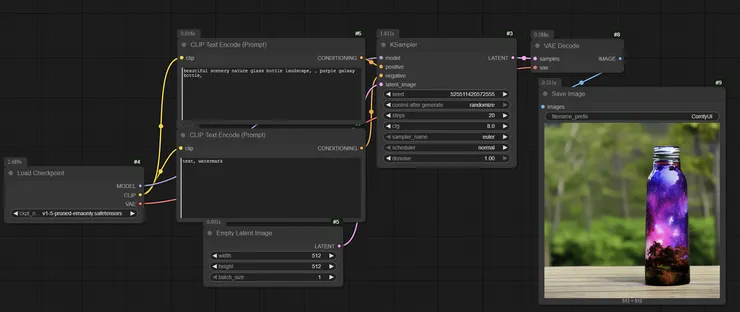

主要畫面, 就是由一群節點(nodes)串起來的工作流(workflow), 通常工作流的流程就像箭頭所示, 由左邊開始一路往右邊順序的執行。您可以使用滑鼠拖動滾輪放大和縮小。把它想像成一種不需要撰寫複雜程式就能輕鬆區塊程式碼的方式。通常,它從左向右移動(紅色箭頭),載入AI模型、執行各種程序最後預覽保存圖像。

更改語系

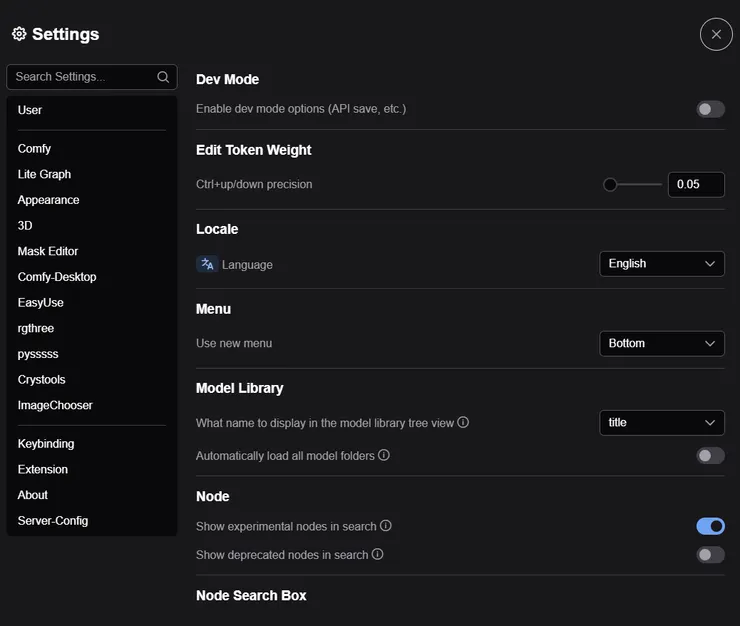

點選 3 的齒輪符號進入設定,可以更改語系, 您可以選擇中文,

不過中文都是簡體中文,我個人喜歡使用英文, 方便和國外文件對照, 不然您用簡體中文還要繁中簡中英文術語切換,覺得更累😃 之後我也都是以英文介面說明為主。

工作列

1 是畫布(canva)工作列, 提供工作流放大縮小,, 切換選擇或是拖拉方式, 要不要顯示連接線等等, 你會很常用Fit View (中間那個對焦圖案)按鈕, 將工作流放置在正中央並且調整最適當的大小。

2 是側邊欄工作列, 讓你查看工作流歷史隊列、節點庫、模型庫、本地用戶工作流,最常用的應該就是那個資料夾的圖示: 打開你儲存的工作流。

工作流儲存是一個又一個的JSON檔案,您可以下載別人的工作流檔案,也可以透過拉取由ComfyUI產生的圖片到主畫面,就會抓到該圖片的工作流。

3 可以切換佈景主題,暗色或是亮色模式,還有之前提到的設定。

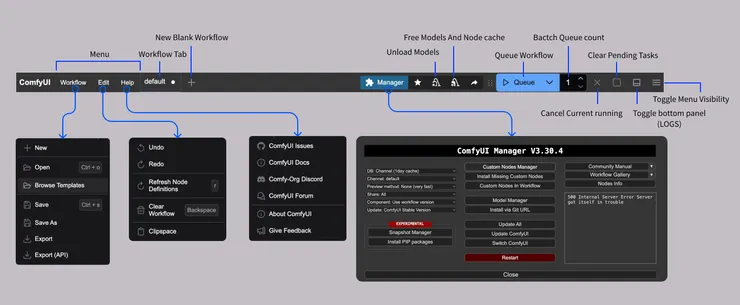

4 就是 menu bar 選單列, 直接用官方的截圖,功能後續(文章)慢慢解釋:

開始使用Workflow工作流 - 文生圖

ComfyUI 是一個用於構建和執行生成內容工作流程的環境。ComfyUI 工作流程可以生成任何類型的媒體:圖像、影片、聲音、AI 模型、AI Agent等等。

像ComfyUI這樣基於節點的電腦程式提供了一種無法通過傳統菜單和按鈕驅動應用程序實現的強大靈活性。 ComfyUI節點圖並不受限於傳統電腦應用程序中提供的工具。 它是一個高級視覺程式環境,允許用戶設計復雜系統,而無需撰寫程式碼或理解高級數學。

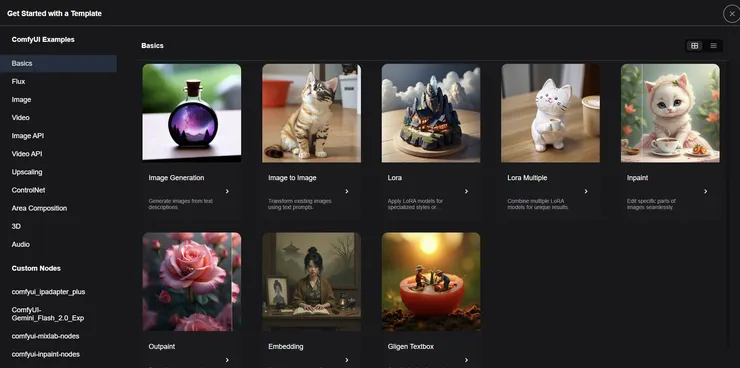

ComfyUI已經提供了很多預設的工作流,在 3 打開 worflow -> Browse Template (瀏覽模板),您就會看到許多已經可用的模板:

試試最基礎的圖像生成, 點選 image Generation

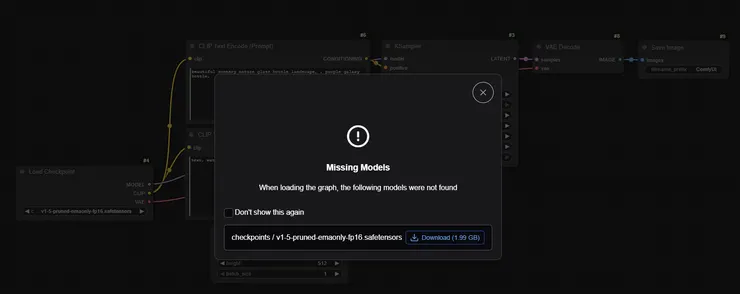

ComfyUI就會載入工作流並先提示你需要下載的圖像模型以及大小:

所有的節點可以縮放大小,滑鼠右鍵點選節點可以做設定, 例如改變顏色, 像我我就喜歡把可以輸入的節點標記成特定顏色

下載後點選 4 的 Run(執行) 就可以看到ComfyUI依序執行節點, 跑出最後的圖片,

可以利用滑鼠滾輪縮放以及移動畫面查看圖片:

恭喜你! 已經利用ComfyUI畫出第一張圖! 🎉🎉🎉🎉

節點說明

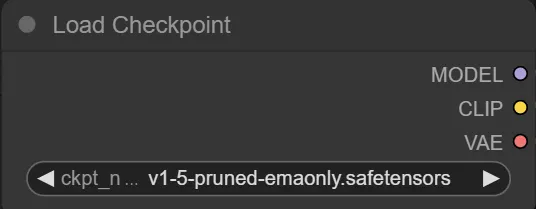

Load Checkpoint

「Load Checkpoint」節點就是 ComfyUI 的「模型載入器」,負責將你選定的 AI 模型(如 Stable Diffusion)讀取進來,並將其分別輸出給後續需要用到模型、CLIP、VAE 的節點,是整個生成流程的第一步。

圖中選擇的是「v1-5-pruned-emaonly.safetensors」,這是一個 Stable Diffusion(SD) 1.5 版本的模型檔案

選擇不同的 checkpoint 檔案,會直接影響生成圖像的風格、細節與能力。

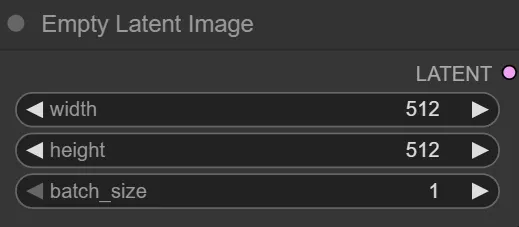

Empt Latent Image

Empty Latent Image 是 ComfyUI 工作流程中用來「建立空白潛空間圖像」的節點。這個節點會產生一個純噪音的潛空間圖像(latent image),作為 AI 生成圖像流程的起點,通常會接到 KSampler 節點進行後續的去噪與生成。

batch_size 可讓你一次產生多張潛空間圖像。

你也可以想像就是建立一張空白畫布, 讓ComfyUI去把我們想要的圖畫出來。

要小心的是 Latent Image 是要配合你使用的模型

SD1.5 的 latent image 最適合 512x512,SDXL 則適合 1024x1024,兩者在解析度、細節還原、格式結構上皆有差異,潛空間圖像尺寸越大,對顯示卡記憶體與計算資源的要求越高。

SD1.5 生成非正方形圖像,只需調整 width 和 height 參數,但建議尺寸不要偏離訓練標準太多,並善用高清修復與放大功能,能有效避免畫面異常並提升畫質。

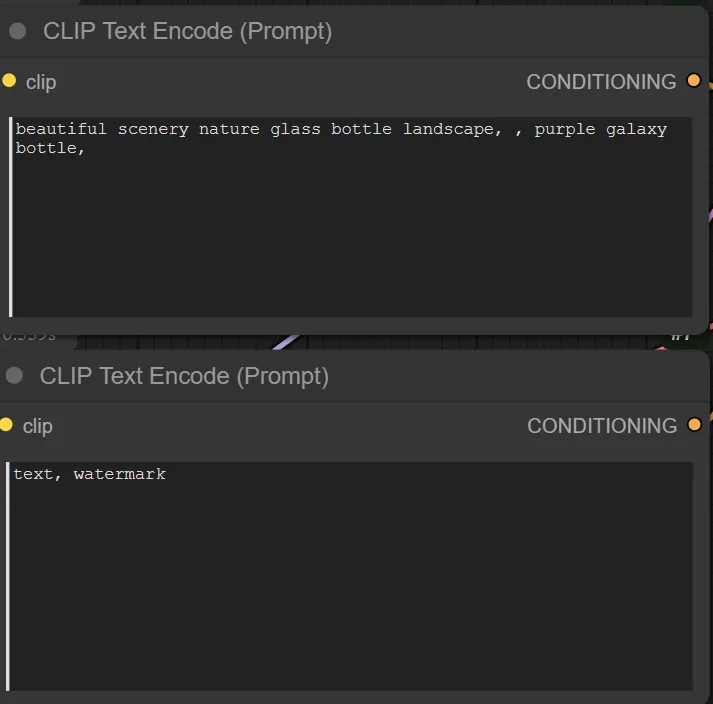

Prompt 提示詞

ComfyUI 的「CLIP Text Encode (Prompt)」節點,主要功能是將文字提示詞(prompt)轉換為 AI 模型可理解的特徵向量,作為圖像生成的條件。

依照模型的不同, 有的可以支援輸入負向提示詞, 些是你不希望圖像中出現的元素,例如文字、水印。這樣模型在生成時會盡量避免這些內容。

正向提示詞和負向提示詞這兩組提示詞都會經過 CLIP 模型編碼,轉成向量後傳給後續的 KSampler 等節點,作為生成條件。

因為模型使用CLIP的模型與方式不同, 提示詞的撰寫方式也會有差異!

另外提示詞目前都建議使用英文, 因此可以使用google翻譯將你想要做的項目轉成英文, 或是使用ChatGPT等工具生成提示詞

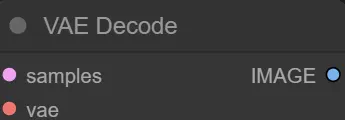

VAE Decode

將「潛在圖像(latent image)」還原(解碼)成我們可以直接觀看的標準圖片。

若未使用適當的 VAE,生成的圖片容易出現「灰霧感」、「細節模糊」等問題。

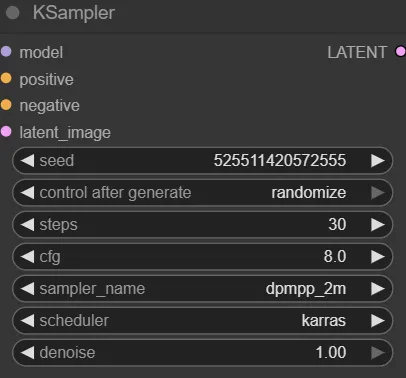

KSampler

KSampler 是 ComfyUI 生成圖像流程中的核心節點,負責將隨機噪音(Latent Image)逐步「去噪」成一張符合提示詞描述的圖像。它實現的是擴散模型(如 Stable Diffusion)的反向擴散過程——從一張完全隨機的潛空間圖像,經過多步運算,最終生成一張可視的圖片。

用數學式子?來講就是:

Output = KSampler(Model, Prompt)

KSampler 就是 ComfyUI 生成圖像時的「降噪引擎」,負責根據模型和提示詞,從一張亂數噪音圖像逐步生成你想要的圖像。理解和靈活調整 KSampler 的各項參數,是玩轉 ComfyUI 的關鍵。

參數設定有蠻多可以討論,

- seed:隨機種子,決定生成圖像的隨機性。相同 seed 可重現相同結果。

- steps:去噪步數,步數越多圖像細節越豐富,但運算時間也越長。

- cfg:引導強度,控制生成圖像對提示詞的遵從程度,值越高越貼近提示詞,但過高可能導致畫面不自然。

- sampler_name:採樣算法名稱,不同算法會影響生成圖像的風格與品質(如 Euler、DDIM、DPM++ 等)。

- scheduler:調度器,決定每一步去噪過程中噪音的調整方式(如 normal、karras 等)。

- denoise:去噪強度,決定對潛空間圖像修改的幅度,1 為完全重生成,數值越小保留原始內容越多。

- control_after_generate:控制生成後是否對 seed 等參數進行調整(如連續生成時是否自動變更 seed)。

可以先使用截圖上的參數先去跑看看。

做一些嘗試

成功生成第一張圖片後,可以試試更多變化。

更改Prompt提示詞

例如打入 "cat" 生成看看, 或是打入一組關鍵字。

每個模型適應的提示詞都不太相同, 如果是預設這個的SD1.5模型,適合用關鍵字與逗號分隔來描述。

更改Checkpoint模型

嘗試下載一些模型, 看看他們有什麼不同,不同模型就好像不同畫家, 都有不同風格與擅長的地方, 來這裡找找。

結語

現在您可以開始生成圖片了! 需要更多進階,可以參考我的其他項目, 或是留言跟我說想看什麼, 謝謝~ 一起享受ComfyUI的旅程! 🎉🎉🎉