嗨我是 Mech Muse 👋,今天想跟大家聊一則最近在 AI 產業圈引起不少討論的晶片消息。

根據 Reuters 在 2025/12/22 的報導,消息人士指出,Nvidia 目標在 2026 年 2 月中旬、也就是農曆年前,開始向中國出貨 H200 GPU。不過,前提是要順利通過一連串 許可與審批關卡,目前還存在不少變數。這篇文章我會陪你一起把這則新聞拆開來看,幫你搞清楚三件事:

👉 這個消息「到底確定了什麼,又還沒確定什麼」

👉 出口管制與審批流程為什麼會一路卡到現在

👉 為什麼 H200 這種等級的 GPU,會成為全球 AI 產業最難預測的風險因子之一

一、為什麼大家特別在意「2 月中旬」🗓️

先講重點:Nvidia 已向中國客戶表示,目標是在農曆新年前、也就是 2026 年 2 月中旬左右,開始出貨 H200。

如果對時間比較沒概念,補充一下背景:2026 年的農曆新年是 2 月 17 日,所以市場解讀的「農曆年前出貨」,基本上就是落在 2 月中旬這段時間。

不過,這篇報導同時也把風險講得很白。整個出貨計畫目前卡在政府層級的審批流程,因為 北京方面尚未正式批准任何 H200 的採購案,實際時程隨時都有可能再調整。

如果用比較生活化的比喻,這比較像是:供應鏈已經把貨打包好、放在門口了,但門禁卡還沒刷過,能不能真的送出去,還要看最後那道門開不開。

在數量上,Reuters 提到一個蠻關鍵的資訊:初期出貨可能會動用 既有庫存,規模大約是 5,000–10,000 個 chip modules,換算下來,大概等於 40,000–80,000 顆 H200 GPU。

這不是隨便的小量測試。對任何一家大型雲端服務商或 AI 訓練公司來說,這個等級的算力,已經足以影響接下來一季到半年的模型訓練與產品節奏。

再來是政策層面的訊號。Reuters 指出,這批可能的出貨,會是在 特朗普政府宣布允許 H200 對中國銷售、並收取 25% 費用之後,首度出現的實際交付案例。這也被市場視為,相較於先前全面封鎖高階 AI 晶片出口的政策方向,現在出現了相當明顯的轉折。

二、事件時間線整理:為什麼「能不能出貨」一路卡關?⛔

如果只看單一新聞,很容易覺得這件事突然冒出來,但其實背後是一條拉了好幾年的長時間線。

我把關鍵節點整理給你,會比較好理解整個脈絡:

- 2022/10/07(美國)美國商務部(BIS)首次針對「先進運算晶片、超級電腦與半導體製造」建立更嚴格的出口管制框架,並正式公告在 Federal Register。這被視為近年 AI 晶片出口管制的起點。

- 2023/10/17–10/25(美國)BIS 再度擴大與細化出口限制,並影響到 Nvidia 為中國市場設計的 A800、H800 等產品,象徵規則開始往「更細、更嚴」的方向走。

- 2024/04(美國)針對前一年的規則持續補充、更正與釐清,顯示這套制度並不是一次定案,而是滾動式調整。

- 2025/05(市場現實)Reuters 報導,Nvidia 為了符合當時的出口門檻,開始調整、降規部分產品供中國市場使用,說明需求一直都在,只是供貨方式被迫繞規則。

- 2025/12(政策訊號出現)Reuters 指出,特朗普在本月表態,允許 H200 對中國銷售,並加收 25% 費用;同時,美國商務部也開始進行跨部門的許可審查。

- 2025/12/22(供應鏈說法曝光)Nvidia 對中國客戶釋出訊息,目標在 2026 年 2 月中旬出貨,但北京端審批尚未通過,時程仍具不確定性。

- 同日(政治壓力升高)美國國會議員要求商務部揭露任何 H200 對中出口的批准情況,並要求在批准前進行簡報與風險評估。

把這條時間線攤開來看,你會發現一件事:出口管制從來都不是一刀切的事件,而是一套長期運作、層層疊加的制度。而 H200 能不能出貨,往往取決於 美國端的出口許可+中國端的採購審批,兩邊都不能少。

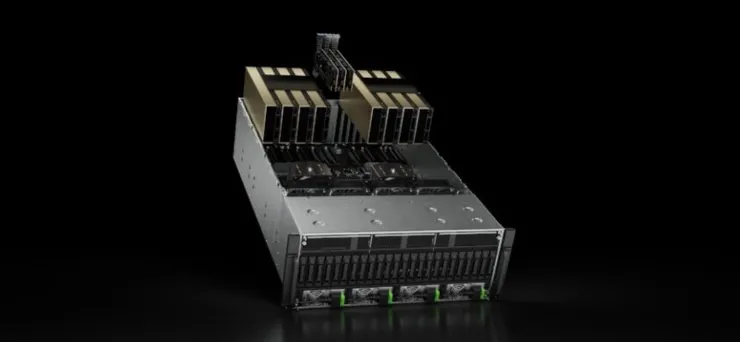

三、H200 強在哪?為什麼「模組數量」很關鍵 🤖

接著來聊技術面,先用白話講清楚 H200 在強什麼。

H200 是 Nvidia Hopper 架構的一員,最大特色在於 更大的 HBM3e 記憶體容量與更高的頻寬,規格是 141GB HBM3e、4.8TB/s 記憶體頻寬。這對大型語言模型(LLM)與高效能運算(HPC)來說非常重要。

如果要用一句話形容,可以這樣想:

很多 AI 模型訓練的瓶頸,不是算力不夠,而是 資料搬不夠快、一次塞不進 GPU。H200 的設計,正是直接去解這個問題。

再回到 Reuters 提到的 5,000–10,000 個 chip modules。這個說法其實很有資訊量,因為資料中心 GPU 幾乎不會以「單顆晶片」交付,而是以 板卡、模組,甚至整台伺服器或機櫃的形式進入客戶機房。

當 Reuters 把這個數字換算成 40,000–80,000 顆 H200,其實是在暗示:這不是象徵性的小量供貨,而是真的能落地、形成實際算力的規模。

另外一個關鍵點是「相對差距」。Reuters 引述指出,如果中國科技大廠(像 Alibaba、ByteDance)能拿到 H200,算力等級會明顯高於 Nvidia 先前為中國市場設計的降規產品 H20,甚至被形容有 約六倍的差距。

這也說明了為什麼審批會這麼敏感:

對企業來說,這會直接影響模型訓練速度與產品競爭力;對政策單位來說,這牽涉到軍民兩用與國安風險的評估。

最後一個現實問題是供應。Reuters 也提到,雖然 H200 仍在大量使用,但 Nvidia 的產能重心已逐步轉向更新一代(像 Blackwell 架構),因此 H200 本身的供應並不寬鬆。即使審批一路放行,實際能交付多少、多久交付,都還是變數。

四、重點整理:接下來該盯哪三個訊號?👀

最後幫大家快速整理目前「已知」與「未定」的狀況:

1️⃣ 出貨目標已經被提出,但還談不上保證交付

目標是 2026 年 2 月中旬農曆年前,但北京端審批尚未完成,時程仍可能調整。

2️⃣ 政策轉向帶來市場想像,同時也引發政治審視

一邊是允許銷售與課費的政策訊號,另一邊是國會要求更高透明度與事前評估。

3️⃣ 算力供應的不確定性,會直接影響 AI 產品節奏

不論是供貨放大或再度延宕,都會影響雲端業者與大型企業的訓練與上線規劃。

如果你喜歡,歡迎追蹤我 Mech Muse 👋。

這篇文章如果有讓你覺得實用、有趣,也可以考慮小額贊助支持我~

👉贊助支持:贊助連結

❤️加入付費會員,每週獲得最新科技新知

Mech《AI 週一報 #004》|2025.12.09~2025.12.15

《Mech》人型機器人 週二報 #003|2025.12.03~2025.12.09

《Mech》小型核能 週三報 #003 2025.12.04~2025.12.10

《Mech》量子科技 週四報 #003| 2025.12.05~2025.12.11

《Mech》量子科技 週四報 #003| 2025.12.05~2025.12.11