Transformer 是一種 專門處理序列資料(例如文字) 的神經網路架構。

它在 2017 年由論文:Attention Is All You Need

提出,作者之一是 Ashish Vaswani。

它徹底改變了 NLP(自然語言處理),並成為所有 LLM 的基礎。

🔥 為什麼它革命性?

在 Transformer 之前:

- RNN → 只能一個字一個字處理

- LSTM → 改善長距離記憶,但仍然慢

- 無法有效並行計算

Transformer 的突破是:

❗ 完全拋棄 RNN,改用「注意力機制(Attention)」。

🧩 Transformer 整體結構

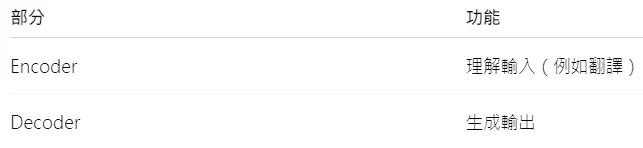

基本結構包含:

Input → Embedding → Attention → Feed Forward → Output如果是完整版本(原始論文):

- Encoder(理解)

- Decoder(生成)

而現代 LLM(例如 GPT)只使用 Decoder 部分。

⭐ 核心:Self-Attention(自注意力)

這是 Transformer 的靈魂。

直覺理解

假設一句話:

小明 打了 小華 因為 他 生氣了

「他」指誰?

Self-Attention 會讓模型去看:

- 小明

- 小華

然後計算誰比較相關。

數學核心

每個字會產生三個向量:

- Q(Query)

- K(Key)

- V(Value)

計算公式:

Attention(Q,K,V) = softmax(QKᵀ / √d) V

意思是:

- 算 Q 和 K 的相似度

- 正規化成權重

- 加權平均 V

這讓模型知道「該注意誰」。

🧠 多方注意力(Multi-Head Attention)

模型不只看一種關係,而是:

- 一方看語法

- 一方看語意

- 一方看代詞關係

- 一方看因果關係

多個 Attention 同時運作 → 再合併。

📐 為什麼它強?

✅ 可以並行運算(GPU 友好)

不像 RNN 需要順序計算。

✅ 能捕捉長距離依賴

1000 字前的詞仍可直接連結。

✅ 容易擴展(Scaling)

參數變多 → 效果自然變好。

這就是為什麼 GPT 能成功。

🏗 Encoder vs Decoder

例如:

- BERT → 只用 Encoder

- GPT-3 → 只用 Decoder

- T5 → Encoder + Decoder

🎯 一句話總結

Transformer 是一種利用「自注意力機制」來理解整段文字關係的神經網路架構。

它讓模型能夠:

- 同時看整句話

- 理解長距離關聯

- 高效率在 GPU 上訓練

- 擴展到上千億參數