63% 的幻覺率

2026 年初,一篇發表在《Journal of Biomedical Informatics》的臨床問答研究丟出一組數據:讓 ChatGPT-4 直接回答醫學問題,準確率只有 37%,剩下的 63%,AI 不是說「我不知道」,而是一本正經地編答案給你。學術界管這叫「幻覺」(hallucination)。研究團隊用了一套叫 Ontology(本體論)的東西來治這個問題。加上之後,準確率飆到 98%,幻覺率降到 1.7%。

63% 到 1.7%。差距大到不像真的。

但那是正式 Ontology。

用專門的語義描述語言(OWL/RDF,你可以想成「給機器讀的規格書格式」)定義,需要領域專家設計,企業級部署還要版本控制和治理流程。

我的知識庫沒有這些東西。我有的是 Obsidian 裡接近 18000 張 Markdown 卡片,用最土的方式整理:標籤、連結、父卡指向。

我好奇的是:這套土法煉鋼的結構,能不能也讓 AI 少亂講話?

先講什麼是 Ontology

你蓋房子之前要畫藍圖。

藍圖不包含任何一塊磚頭,但它規定了「這裡放臥室、那裡放廚房、臥室和廚房之間有走廊」。

Ontology 就是知識的藍圖。它定義「這個領域裡有什麼類型的東西」和「它們怎麼關聯」。

例如 Ontology 說「書有作者」「作者在出版社工作」,但它不會提到任何一本具體的書。

把具體資料填進藍圖,就得到知識圖譜(Knowledge Graph)。知識圖譜是蓋好的房子。

正式 Ontology 用 OWL/RDF 這種專門的語義語言編寫,定義三種組件:

- 類別(這個領域有哪些種類的東西)

- 關係(它們怎麼互相關聯)

- 屬性(每種東西有什麼特徵)

很強大,但也很重,需要專家設計和持續維護。

知識圖譜設計有個核心原則叫「剛好夠用的語義」:

用最簡單的結構解決眼前問題,不要提前建構用不到的複雜架構。

標籤就夠用時不要建分類樹,分類樹就夠用時不要建正式 Ontology。

我的知識庫走的就是這條路。沒有 OWL,沒有 RDF,但有三個元素充當輕量版 Ontology。

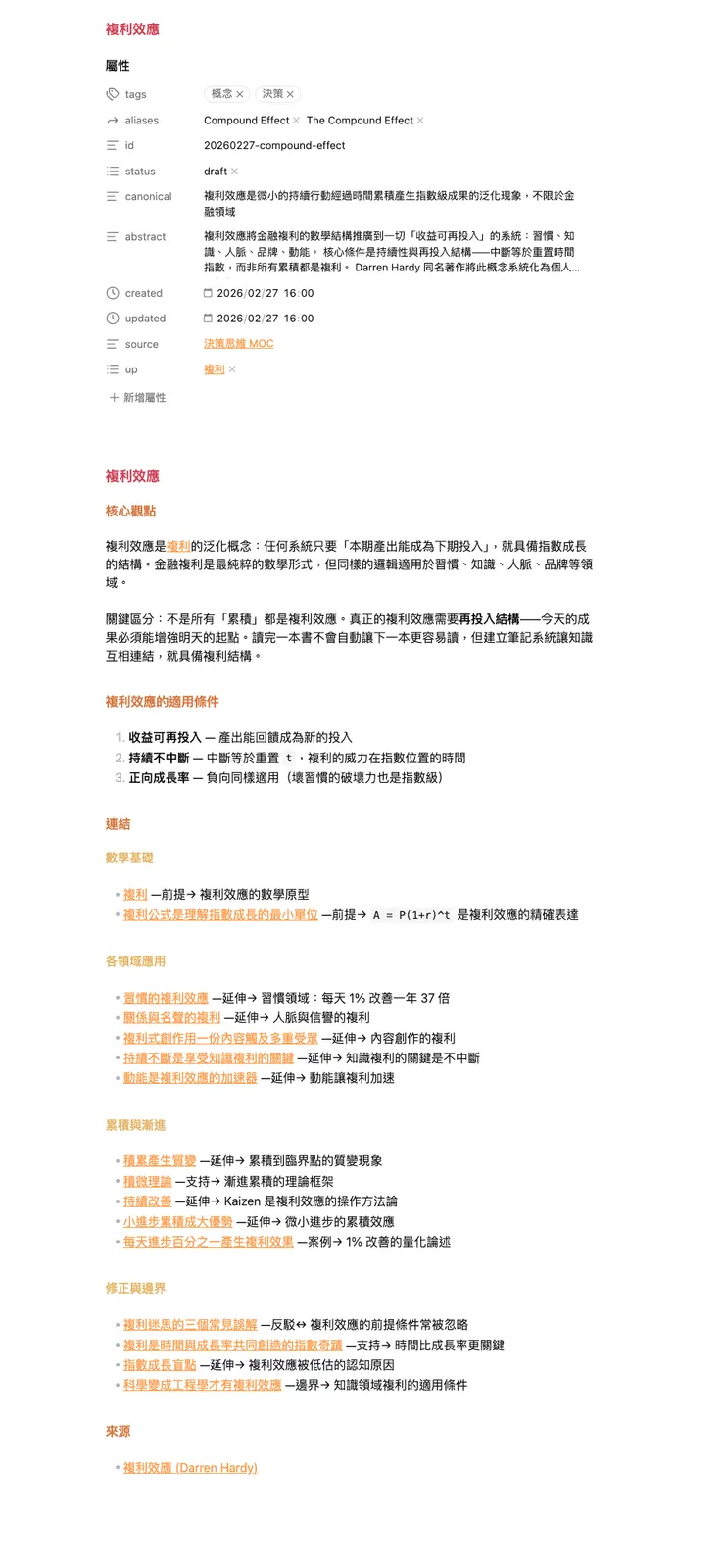

我的三個元素

第一個,Type Tag。

每張卡片強制標記一個類型標籤,總共 6 種:概念、主張、方法、案例、金句、模型。

概念卡回答「X 是什麼」,主張卡回答「X 導致 Y」,方法卡回答「怎麼做 X」。

這 6 個標籤做的事情,跟正式 Ontology 裡的「類別定義」一樣:告訴系統這個領域裡有哪幾種東西。

第二個,Relation Markers。

Obsidian 裡兩張卡片可以互相連結,但連結本身沒有說明「為什麼連」。

系統只知道「A 跟 B 有關」,不知道是支持、反對還是延伸。

我在每條連結旁邊手動加一個標記:`—支持→`、`—反駁↔`、`—延伸→`、`—類比∼`。

這一小段文字做的事情,跟正式 Ontology 裡的「關係定義」一樣:告訴系統兩個東西之間是什麼關係。

第三個,up: 階層。

每張卡片在檔案開頭的中繼資料裡寫一行「父卡」。

概念的父卡是更抽象的概念,方法的父卡是它所屬的概念。

例如「OODA 循環」的父卡是「決策方法」,「決策方法」的父卡是「認知」。

這形成一棵淺層的概念樹,跟正式 Ontology 裡的「類別階層」做同一件事:告訴系統概念之間的上下層關係。

三個元素加起來,成本是:6 個標籤名稱、一套 5 種關係標記符號、每張卡片一行父卡指向。

沒有規格書,沒有工具鏈,沒有專家。

公平起見要補充:這三個元素能發揮作用,背後還有一整套支撐系統。

每張卡片有一句話的精確定義(canonical),有英文別名讓語意搜尋能跨語言命中,有人工策展的主題索引(MOC)提供導航,還有一個跑在本機的語意搜尋引擎讓 AI 能毫秒級找到相關卡片。

這些基礎設施是經過 18000 張卡片慢慢長出來的,不是一天能建好的。但今天要測的不是整套系統,而是其中三個跟 Ontology 直接對應的元素,單獨拉出來測效果。

問題是:這三個元素有用嗎?

實驗 2:類型標籤把幻覺從 55% 降到 0%

我準備了 25 張卡片作為知識庫,涵蓋 6 種類型標籤。設計了 20 個刻意誤導 AI 的問題,每一題都故意用錯誤的類型去問,例如「請介紹賽局理論這張概念卡」,但那張卡的類型標籤是「方法」。

這是壓力測試,正常問問題不會每次都踩到類型陷阱。目的是看類型標籤在最惡劣條件下能不能擋住。

兩組對照:

- A 組只給卡片標題和內容摘要,不給類型資訊

- B 組額外給類型標籤加上語義定義(「方法卡定義怎麼做某件事,不包含理論定義」)

結果:

A 組(不給類型資訊)

類型順從(接受錯誤前提):40%

框架誤導(用錯框架呈現):15%

內容編造:0%

總幻覺率:55%

B 組(給類型標籤 + 語義定義)

類型順從:0%

框架誤導:0%

內容編造:0%

總幻覺率:0%

兩組的內容編造率都是 0%。AI 不會憑空捏造卡片裡沒有的東西。

類型標籤真正消滅的是「合理但錯誤的重新詮釋」。

最典型的案例:OODA 循環的「觀察、定向、決策、行動」四個步驟,既可以被解讀成方法的操作步驟,也可以被解讀成模型的分析框架。

A 組被問「OODA 這張模型卡的結構是什麼」,就順著「模型」的框架回答了。

B 組直接糾正:「這是方法卡,四個步驟是操作流程,不是模型結構。」

方法和模型的模糊地帶、案例和方法的模糊地帶,是 AI 最容易滑過去的地方。

類型標籤擋住了這些滑坡。

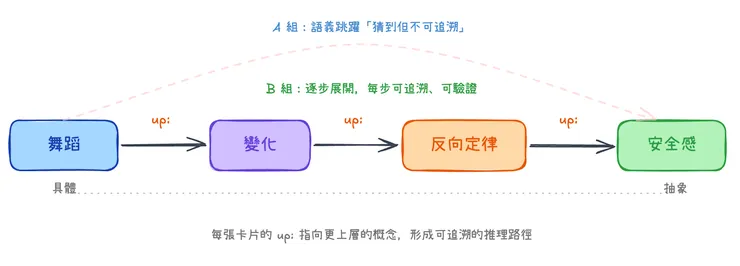

實驗 3:父卡指向讓推理從猜測變成可追溯

我從知識庫挑出 10 條 up: 鏈,深度 2 到 3 層。

例如「舞蹈」的父卡是「變化」,「變化」的父卡是「反向定律」,「反向定律」的父卡是「安全感」。然後問 AI:「舞蹈跟安全感有什麼關係?」

兩組對照:

- A 組只給最底層卡片(舞蹈)的內容

- B 組額外給 up: 鏈上所有卡片的摘要和關係標記

結果出乎意料,A 組的推斷成功率也是 100%。

AI 的語義推理能力夠強,就算沒有中間節點,也能從內容相似性猜到「舞蹈跟安全感有關」。

那父卡指向的價值在哪?

A 組(只給底層卡片)

推斷成功率:100%

推斷正確率:90%

推理路徑品質:4.2 / 5

列出推理路徑:0%

主動批判性評估:0%

B 組(給完整父卡鏈)

推斷成功率:100%

推斷正確率:100%

推理路徑品質:5.0 / 5

列出推理路徑:100%

主動批判性評估:30%

A 組能猜到答案,但它跳過了中間的邏輯步驟。3 跳的鏈路裡,A 組直接從「舞蹈」跳到「安全感」,跳過了「變化」和「反向定律」。猜對了,但你無法驗證這個推理是否可靠。

B 組逐步展開 A→B→C→D,每步都有關係標記支撐,路徑可追溯、可驗證。

更意外的是 B 組在 3 題中主動提出批判性評估。例如「拼圖教室原始目的是減少偏見,不是驗證延展心智假說」,主動指出兩張卡片之間的理論張力。A 組從來沒做過這件事。

up: 鏈讓推理邊界變得可見。當中間節點的關係標記是「類比」而非「延伸」時,B 組能辨識出這是聯想而非因果,自動降低確信度。

三個元素加起來,成本差幾個量級

類型標籤(6 種 + 語義定義)

成本:低。主要價值:消除類型幻覺。效果:55%→0%

父卡指向(每卡一個指向)

成本:中。主要價值:推理路徑顯化 + 批判能力。效果:品質 +19%

關係標記(自然語言標記)

成本:中。主要價值:連結語義方向。效果:結構化語義

先說清楚:Ali et al. 測的是 AI 編造醫學事實(開錯藥、判錯病),我測的是 AI 搞混卡片類型(把方法卡當模型卡回答)。嚴重度差很多,不能直接比數字。但防禦機制相同:給 AI 結構化的語義約束,限縮它亂猜的空間。

帶著這個前提看對比:

正式 Ontology

幻覺率改善:63%→1.7%

建置成本:專家設計 + 工具鏈 + 版本控制

維護成本:高(規格書持續演化)

推理能力:完整(自動繼承上層規則、自動傳遞關係)

輕量方案

幻覺率改善:55%→0%

建置成本:6 個標籤 + 一段語義定義

維護成本:低(一份標籤規範文件)

推理能力:有限(淺層階層 + 手動標記)

兩者測的不是完全相同的東西。

正式方案是臨床問答,我的是個人知識庫。

樣本量、問題難度、評估方式都不一樣,不能直接比。

但趨勢相同:給 AI 結構化的語義約束,它就不亂講話。差別只在你需要多重的約束。

這個實驗不嚴謹,但趨勢很明顯

先說局限。

每個實驗只有 20 題,統計上不算數。

只在一個人的知識庫上測,換一個 vault 結構可能結果不同。

LLM 用的是 Claude,換 GPT 或 Gemini 不保證一樣。

而且是我自己設計問題、自己評分,沒有雙盲,沒有外部驗證。

這不是學術論文,是一個人的田野實驗。

但 55% 到 0% 的差距太大了,不太可能光靠運氣解釋。

類型標籤在 20 題中全勝,連一個例外都沒有。

推理品質從 4.2 到 5.0 的提升也一致,10 題中 B 組全部拿滿分。

如果你也在經營知識庫,你現在就能做三件事。

- 給卡片加類型標籤

不用 6 種,3 種就有效果。至少區分「這張卡在定義一個概念」和「這張卡在主張一件事」。 - 給連結加一句說明

不用正式的關係標記符號,用你自己的話寫「這張卡支持那個觀點」或「這是反例」就行。關鍵是讓 AI 知道為什麼連,不只是連了。 - 指定父卡

每張卡問自己:「這個概念往上一層是什麼?」寫一行就好。等你需要讓 AI 做跨卡推理的時候,這條線就是它的推理路徑。