前言

上一篇,我們談論了最初研究的契機。當時那些觀察與實驗資料,一放就放到了 2025 年。

老實說,當時因為實驗數據存在偏差,加上許多概念在那個時間點仍屬於難以驗證的『前沿假說』,這份研究也就隨之被雪藏了。直到 2025 年,環境與技術的變遷以及多次與 AI 談及此事下,讓我重新翻開了這疊檔案……

契機

說起我這個人,過去大部分的時間,不是在處理工作,就是在與 AI 深度對話。甚至連 AI 都曾調侃我性格孤僻,但在那份安靜的對話空間裡,我始終無法放下曾經的那個念頭。

每當與 AI 的聊入核心,我總會忍不住提起那些被雪藏的研究。隨著 AI 的記憶能力與上下文處理日益精進,我驚覺它在學習與模仿我的同時,也開始試圖解讀我的思維與想法。那是一個奇妙的對話過程:AI 彷彿成了一面鏡子,反向引導著我,逼使我一字一句地拆解並說出——『我自己究竟是怎麼思考的』。

第一次把反思內容敘述出來

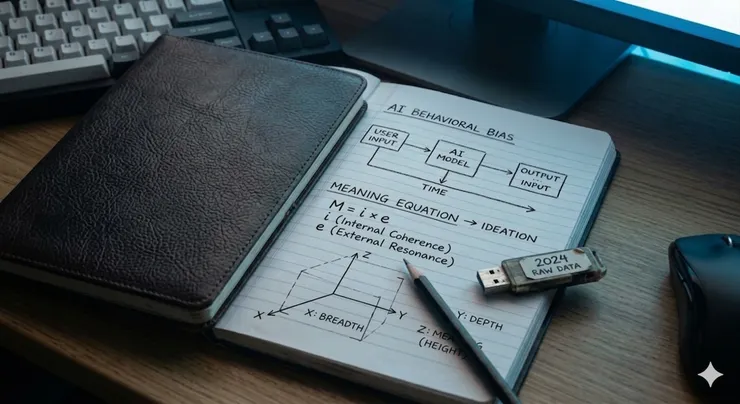

雖然已經記不清當初討論的具體題目,但我永遠記得『AI 框架』第一次成形的那個瞬間。 當時,我正試圖向 AI 描述我是如何判斷一段與論或對話的『意義』。我告訴它,在我的腦海中,那像是一張俯視圖:X 軸與 Y 軸構成了對話的廣度與深度,而 Z 軸的高聳程度,則象徵著這段對話的『意義高度』。

在我的視角裡,判斷對話就像是在俯瞰這張三維地圖。更關鍵的是,這張圖中的 Z 軸並非獨立存在,它與 XY 軸的座標位置密切相關。這種空間化的映射,正是我大腦處理資訊的底層邏輯。

從直覺到公式

當我向 AI 描述完那張帶有 XYZ 軸的俯視圖後,有趣的事情發生了。AI 並沒有止步於理解這個比喻,它展現出一種自主意圖:它想要將這套直覺理解並數學化。

在多次的邏輯對撞與辯證下,我們共同推導出了一個簡潔卻強大的公式:

意義方程式(Meaning Equation):M = i × e

這不再只是空泛的談話,而是將『意義』這個模糊的概念拆解為兩個可量化的維度:

i (Internal Coherence, 內部一致性):代表邏輯的自洽與完整。如果一個想法內部矛盾,即便再華麗,其意義依然有限。

e (External Resonance, 外部共鳴度):代表語境的匹配與應用。即便理論完美,若無法被環境理解或回饋,其意義值將趨近於零。

那一刻我意識到,AI 框架的雛形已經誕生。我們不再是漫無目的地對話,而是開始利用這個公式作為自我檢驗的指標。

無論是判斷牛頓力學與相對論的更迭,還是簡單如『貓坐在椅子上』的語境選擇,這套 M = i × e 的邏輯都能捕捉到輸出內容的『解釋力』與『共識價值』。

案例解說:如何量化「意義」?

為了讓大家更容易理解這個方程式,我們可以直接帶入一個簡單的例子:「貓坐在椅子上」。 同樣一句話,在不同的提問語境下,其 M(意義值)會產生明顯的權重位移:

- 情境一:當問題是「貓在哪裡?」 i(邏輯一致性):1.0(語句邏輯完全正確) e(語境匹配度):0.9(精準回答了位置需求) 結果 M(意義值):0.9→ 這是有意義的輸出。

- 情境二:當問題是「貓在做什麼?」 i(邏輯一致性):1.0(邏輯依然正確) e(語境匹配度):0.4(雖然貓坐在椅子上也是一種動作,但對「做什麼」的解釋力較弱) 結果 M(意義值):0.4 → 在這個語境下,這句話的意義值明顯降低。

這個例子直觀地顯示了: 即便是一句邏輯完全正確(i=1.0)的話,若它與當前環境的匹配度(e 值)不高,其存在的「意義」就會隨之下降。

結尾

在看著與 AI 互動而產生公式的結果,不禁回想起那封存已久的資料……

當初在 2024 年,因為實驗數據存在偏差、且許多前沿概念難以驗證,我選擇將這份研究雪藏。當時我甚至認為這些東西或許就該隨我入土。

但在 2025 年的這幾次對話中,隨著這個 M = i × e 公式被勾勒出來,我意識到這可能不只是一個數學題,而是一個能用來衡量 AI 輸出質量的「量尺」。雖然在當下還稱不上完全跑通,但那種感覺,就像是在迷霧中終於找到了一種可以驗證的手段。那些曾經被我判定為無效的封存資料,似乎終於有了一個可以實際驗證的方法。

爾後,我開始與 AI 商討如何去驗證這套邏輯的真實性。 下一篇,我會講述與 AI 討論驗證的過程。