前言

上一篇,我們談到了 M = i × e 這個公式的誕生。

那之後,我沒有停留在公式上太久。我想驗證它。

實作出來了

實驗的早期並不順利。

當時使用的是一個只有 3B 參數的小型模型。對於小模型來說,這本來就是一場勝算不高的實驗——它的底子薄,容錯空間小,稍微偏一點輸出就崩了。果然,早期的回答經常答非所問,輸出混亂,有時候甚至讓人不確定它到底有沒有在理解問題。

我能做的就是把那些回答丟給 AI,問它哪裡出了問題,然後根據指引修正框架設計。

就這樣一版一版地疊。每一版都在上一版的問題上做修正,沒有跳躍,也沒有捷徑。

慢慢地,回答變得有條理了。幾乎每個問題都能答在點上。訓練資料不多,前前後後大概就兩三千筆,但結果比預期好。讓我有點意外的是,這個量級的資料,居然能讓一個小模型的行為產生這麼明顯的位移。

兩個問題

結果有效,但我反而開始困惑。

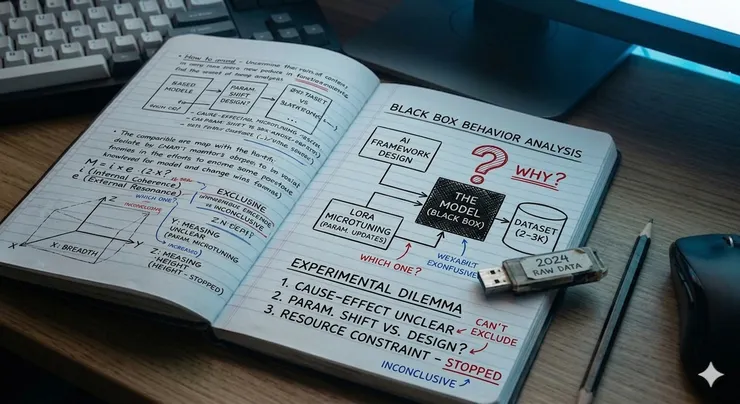

第一個問題是方法論的:每次看到問題、根據指引修正——這樣的過程,還算是真正的驗證嗎?我們設計了 200 道測試題,題目和訓練資料完全沒有重疊,都是模型從來沒見過的問題。但問題在於,修正的方向本身是 AI 給的。這讓整件事的邊界變得模糊:到底是框架在引導 AI,還是 AI 在引導框架?

這個問題我沒辦法乾淨地回答。

第二個問題更深,也更難甩掉:它的確變好了,但我說不清楚為什麼。

不是「大概是因為訓練資料品質好」那種說不清楚,而是更根本的——這個改善,究竟發生在哪一層?是框架設計本身在起作用,還是 LoRA 微調的參數更新剛好碰對了某個方向,還是兩件事湊在一起才有的結果?這三種解釋,我都無法排除,也無法確認。

這兩個問題方向相反,卻同時壓著我。

停在這裡

在某個時間點,我決定不再往裡面投入了。

不是放棄,是判斷投入產出比。那個「為什麼有效」的問題,想要回答它,需要的資源、算力、對照組設計,都遠超過我當時能調動的範圍。即便繼續做,頂多是多幾筆數據,問題的核心仍然會懸在那裡。死死纏著,不划算。

更現實的是:這個問題或許根本不在這個層次能被解答。

但問題本身沒有消失。它只是換了一個位置。

結論

我理解 AI 的本質是機率預測系統。LoRA 實驗告訴我行為可以被塑造,但塑造的過程仍然是黑盒子——還是在調機率分佈,只是調得比較準。

我想的是另一件事:即便 AI 的輸出來自機率,能不能讓它在機率之外,透過純數學運算自己算出判斷?

不是猜出來的,是算出來的。

這個念頭,把我帶向了更底層的方向。下一篇,我們再來談這件事。