2026 年 4 月,Google 正式推出了備受期待的 Gemma 4 系列模型。這次的 Gemma 4 已經超越了單純的參數規模競賽,其核心目標是將強大的邏輯推理能力、原生的多模態理解,以及代理人(Agent)工作流,以最高效的方式部署到各種硬體裝置上。

最令開源社群振奮的,莫過於 Gemma 4 全系列採用了商業友善的 Apache 2.0 授權條款。這意味著企業與開發者可以自由使用、修改並進行商業部署,擁有完整的資料與基礎設施主權。無論你是想在行動裝置上運行本地端 AI、開發Embodied AI的機器人,還是建置企業內部的自主工作流,Gemma 4 都提供了極具競爭力的解決方案。

Gemma 4: Byte for byte, the most capable open models

Gemma 4模型懶人包

- 四種高度最佳化的模型尺寸:

- Effective 2B (E2B):專為行動裝置與 IoT 邊緣運算設計,具備 128K 上下文長度,實際推論時啟動約 23 億參數,原生支援影像、影片與音訊輸入。

- Effective 4B (E4B):同樣針對邊緣裝置最佳化,提供更強的推理能力,推論時啟動約 45 億參數,同樣支援全方位的多模態輸入與 128K 上下文。

- 26B Mixture of Experts (MoE):採用混合專家架構,總參數達 260 億,但每次推論僅啟動 38 億(約 4B)參數。具備極高的生成速度與 256K 超長上下文,適合在消費級 GPU 上運行。

- 31B Dense:傳統的密集型網路架構,將原始品質最大化,作為微調(Fine-tuning)的強大基石,具備 256K 上下文長度。

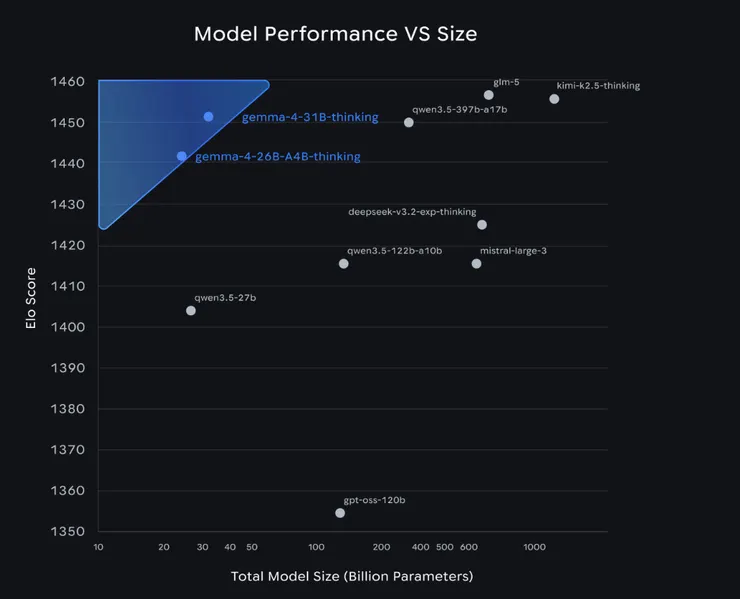

- 優異的基準測試表現:在 Arena AI 文本排行榜上,Gemma 4 31B 取得了開源模型世界排名第三的佳績,而 26B MoE 模型也拿下了第六名,表現甚至超越了體積大上 20 倍的其他模型。

- 商業友善的開源授權:採用 Apache 2.0 授權,打破了許多自訂開源條款的商業限制。

- 原生的代理人 (Agent) 支援:全面支援函數呼叫(Function calling)、結構化 JSON 輸出與原生系統指令。

- 開箱即用的生態系整合:發布首日即無縫整合 Hugging Face 的各項工具(如 Transformers、TRL),並支援 Llama.cpp、MLX、vLLM 等主流推理引擎。

突破邊界的架構與多模態能力

多模態能力的非對稱設計:視覺、影片與語音的巧妙結合

Gemma 4 的多模態能力設計非常有趣,它根據模型大小與預期運行的硬體,採取了不同的策略。

- 視覺與影像理解的進化:Gemma 4 的影像編碼器繼承自 Gemma 3,但加入了兩個關鍵的改進。首先是支援「可變長寬比」,這讓模型在處理不同尺寸的圖片時,不再需要強制裁切或扭曲,保留了最原始的空間資訊。其次是「可配置的影像 Token 預算」(從 70 到 1120 個 Token 不等),開發者可以根據應用場景對速度、記憶體和品質的要求,自行尋找最佳平衡點。在 Hugging Face 的實測中,Gemma 4 可以精準辨識威尼斯廣場上的一隻海鷗,甚至能詳細描述背景建築的細節。

- 語音問答與轉錄:小型的 E2B 與 E4B 模型可以直接接收語音輸入,進行問答或逐字稿轉錄;而較大的 26B 與 31B 模型則沒有這項功能。為何如此?因為 E2B 與 E4B 的主要戰場是智慧型手機與 IoT 裝置,這些設備高度依賴麥克風與語音互動;而大型模型多半部署在伺服器或工作站,處理的資料型態以文字、程式碼和靜態視覺為主。

- 影片理解的差異:全系列模型皆支援影片輸入。但受限於音訊編碼器的配置,小模型可以同時理解影片畫面與聲音,而大模型則專注於理解影片的視覺畫面。

為 Agentic Workflows 而生的原生代理能力

傳統語言模型只能被動地回答問題,但 Gemma 4 在設計之初,就賦予了它主動與外部世界互動的能力。

- 精準的函數呼叫(Function Calling)與 JSON 輸出:Gemma 4 能夠根據使用者的需求,自行判斷是否需要呼叫外部工具。在 Hugging Face 提供的實測中,給定一張泰國曼谷鄭王廟(Wat Arun)的圖片,並詢問「這是哪個城市?請檢查那裡現在的天氣」。模型內部的思考過程會先分析建築特徵,判斷出地點是泰國曼谷,接著自動構建出精準的工具呼叫指令。

- GUI 元素偵測與空間定位:Gemma 4 展現了極強的空間感知能力。當被要求找出網頁截圖中「檢視食譜」按鈕的邊界框時,模型不需要任何額外的語法約束,就能直接以標準的 JSON 格式輸出精準的相對座標。這對於自動化軟體測試或開發網頁自動操作機器人來說,是極為關鍵的能力。

如何在有限資源下實現極致效能

在技術架構上,Gemma 4 引入了多項創新,確保它能在有限的記憶體與運算資源下,依然展現出驚人的推理能力。

- 交替的局部滑動窗口與全局注意力 (Alternating Attention):在處理長達 128K 或 256K 的上下文時,如果全部採用全局注意力機制,運算量會呈現幾何級數暴增。Gemma 4 採用了交替設計,較小的模型使用 512 個 Token 的滑動窗口,大模型則使用 1024 個 Token。同時搭配了雙重的旋轉位置編碼(Dual RoPE),讓模型既能兼顧局部細節的捕捉,又能維持對長文本全局脈絡的理解。

- 逐層嵌入 (Per-Layer Embeddings, PLE):這是 Gemma 4 在小模型上特別突出的一項技術。在傳統的 Transformer 模型中,每個詞彙(Token)在輸入時只會獲得一個固定的嵌入向量,這個向量必須承載模型在後續所有神經網路層中可能需要的所有資訊,這對小模型來說是沉重的負擔。PLE 技術透過一條平行的低維度路徑,為每一層神經網路提供專屬的殘差訊號。這就像是給了每一層一個專屬的「提示小抄」,讓每一層只需在必要時接收特定的詞彙資訊,從而在不大幅增加參數的情況下,顯著提升了模型的專業表現。

- 共享 KV Cache (Shared KV Cache):這是一項為了降低記憶體消耗與提升推論速度的最佳化技術。在模型最後的幾個神經網路層中,不再重複計算與儲存 Key 和 Value 矩陣,而是直接重複使用前面網路層的狀態。在實際應用中,這不僅對生成品質的影響微乎其微,更能大幅降低設備在處理超長上下文時的記憶體壓力,特別適合資源受限的邊緣裝置。

終端裝置與邊緣運算的智慧化

憑藉著 E2B 與 E4B 極低延遲與極小記憶體佔用的特性,AI 將真正從雲端走向邊緣。Google 這些模型將能夠在手機、Raspberry Pi 或是 NVIDIA Jetson 等設備上完全離線運行。未來的手機語音助理將不再需要將語音傳送至雲端處理,能夠在毫秒級別內完成語音辨識、邏輯思考並給出回應,大幅提升了隱私性與反應速度。

機器人學與Embodied AI 的快速迭代

Gemma 4 原生支援視覺與工具呼叫,這讓它成為開發機器人與自動駕駛系統的絕佳大腦。在 Hugging Face 的 TRL(Transformer Reinforcement Learning)套件更新中,開發者已經可以讓 Gemma 4 接收來自模擬環境的畫面,讓模型自行判斷路況並決定駕駛行為。模型可以透過攝影機「看見」行人,並學會變換車道來避開危險。這種「感知到行動」的閉環訓練,將加速工業機器人與服務型機器人的發展。

企業資料主權與本地端開發助理

對於注重機密資料的企業而言,Gemma 4 提供了無可比擬的優勢。26B MoE 與 31B Dense 模型的權重可以直接下載,這代表企業可以將這些具備頂級推理能力的模型,部署在完全斷網的內部伺服器或單張 80GB NVIDIA H100 GPU 上。開發者也可以透過 Llama.cpp 配合各種量化技術,在消費級顯示卡上運行 26B MoE 模型,將其轉化為完全本地端、擁有 256K 閱讀能力的 AI 程式碼助理,從根本上解決了將原始碼上傳至雲端所帶來的資安疑慮。

TN科技筆記的觀點

Google 這次特別強調了「有效參數(Effective Parameters)」這個概念。使用者需要的是「生成每一個 Token 的速度與品質」,透過 MoE 架構與共享 KV Cache,Gemma 4 成功在硬體限制與智力表現之間找到了甜密點。另外將原生音訊處理能力限定在 E2B 與 E4B 這兩個邊緣模型上,是一個聰明的產品定位。手機、智慧手錶、物聯網家電具備麥克風,需要即時的語音互動;而伺服器機房裡的 GPU 節點,更多時候是在批次處理文字報告、編寫程式碼或進行影像分析。這種將不同感官能力分配給適合硬體的做法,不僅節省了不必要的訓練成本,更展現了 Google 對於終端落地場景的深刻理解。

多模態輸入的「幻覺」風險依然存在,儘管模型能力強大,但多模態融合仍然存在不穩定性。在 Hugging Face 的實測中,當輸入一段沒有對話、只有音樂表演的演唱會影片時,E2B 模型針對音訊部分產生了嚴重的幻覺,甚至憑空捏造出了影片中並不存在的抗議歌詞。這提醒我們,在將邊緣模型應用於依賴高準確度的語音場景時,開發者必須建立適當的防呆機制或二次確認流程。

支持TN科技筆記,與科技共同前行

我是TN科技筆記,如果喜歡這篇文章,歡迎留言、點選愛心、轉發給我支持鼓勵~~~也歡迎每個月請我喝杯咖啡,鼓勵我撰寫更多科技文章,一起跟著科技浪潮前進!!>>>>> 請我喝一杯咖啡

在此也感謝每個月持續請我喝杯咖啡的讀者以及新加入的讀者們,讓我更加有動力為各位帶來科技新知!

以下是我的 threads 也歡迎追蹤、回覆、轉發喔!

>>>>> TN科技筆記(TechNotes)