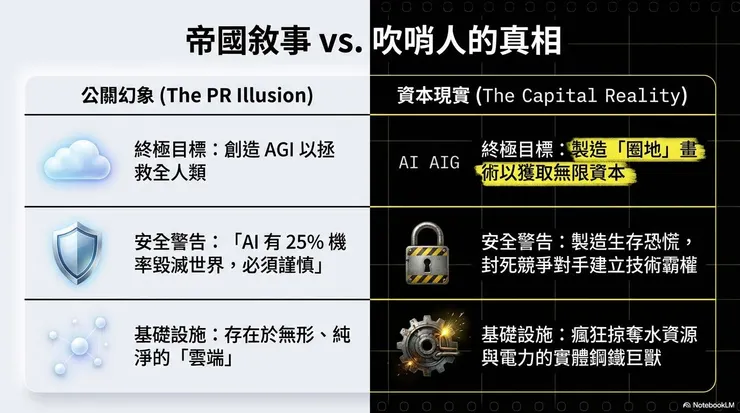

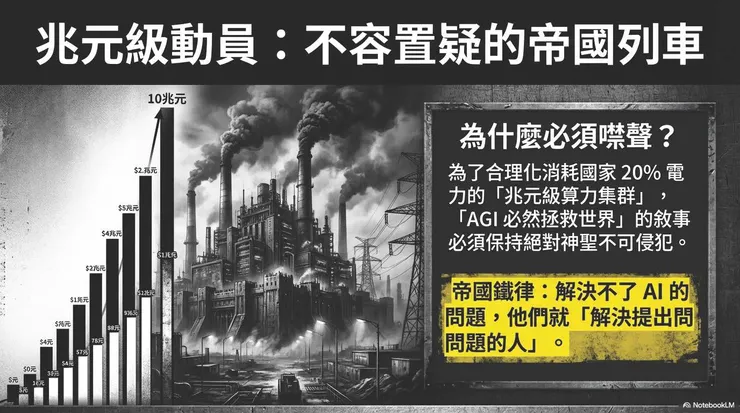

AI 公司主要透過以下幾個策略,利用 AGI(通用人工智慧)神話與末日論來建立並鞏固技術霸權:

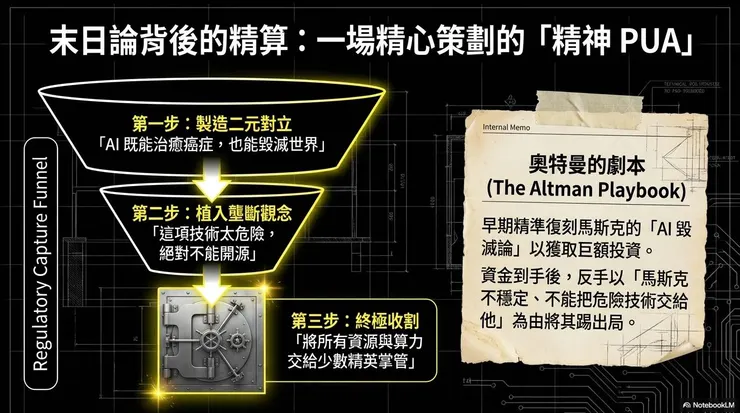

1. 製造「生存恐慌」作為政治與商業武器科技巨頭將 AI 包裝成一種極端的存在:它既能治癒癌症,也可能摧毀世界。這種「要麼天堂、要麼地獄」的二元對立論述,本質上是一場精心策劃的心理操縱(精神 PUA)。其真實目的在於製造全球性的恐慌,讓大眾在恐懼中交出權力與未來的決定權。

2. 以「安全性」為名行「壟斷」之實

AI 公司利用末日論推導出一個對其有利的結論:正因為這項技術如此強大且危險,絕不能落入「壞人」或競爭對手手中,也絕不能開源。

- 集中管控: 他們主張所有資源(算力、數據、權力)必須由少數「有道德底線」或「絕對聰明」的矽谷精英掌管,這成了封死競爭對手、建立技術霸權的完美藉口。

- 排除異己: 來源指出,山姆·奧特曼(Sam Altman)早期曾復刻馬斯克的 AI 毀滅論以獲取投資,隨後卻以「馬斯克不穩定、不能把危險技術交給他」為由將其踢出局。

3. 規避監管與獲取無限資本

- 規避民主監督: AI 公司告訴政客,過度的監管會阻礙國家在 AI 競賽中獲勝,從而將技術發展包裝成一場「不可避免的帝國擴張」,規避了本該有的約束。

- 吸納資金: 透過 AGI 神話,他們讓投資人因害怕錯過掌握未來宇宙價值的機會,而無底線地投入資本。

4. 合理化資源掠奪

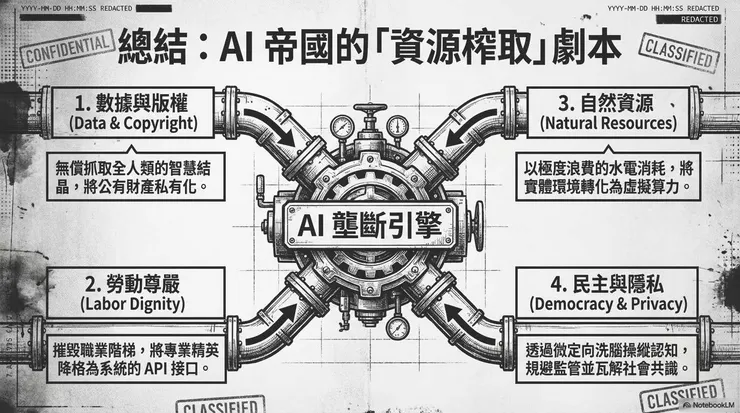

這套帝國敘事被用來合理化對全球資源的瘋狂掠奪,包括:

- 數據與版權: 無償抓取創作者的版權數據。

- 環境資源: 占用海量的電力與水資源,甚至在基礎設施落後的社區偷偷建設超級計算機,剝奪普通人呼吸乾淨空氣與飲水的權利。

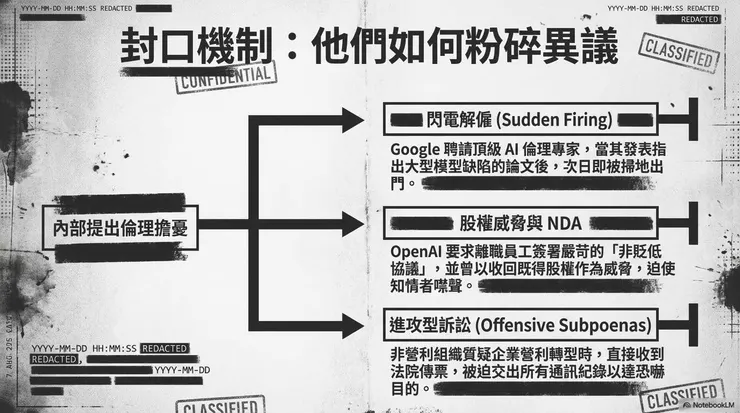

5. 壓制內部異議

為了維持霸權地位,這些公司會「解決提出問題的人」:

- 清除倫理專家: 谷歌曾聘請頂級 AI 倫理專家,但當其指出模型缺陷時,次日便被解僱。

- 保密協議與法律威脅: OpenAI 要求離職員工簽署非貶低協議,並對質疑其營利模式的非營利組織負責人發出法院傳票,迫使其交出通訊紀錄。

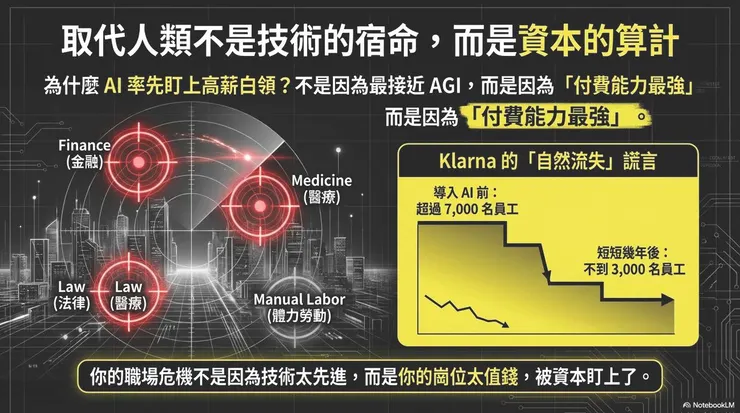

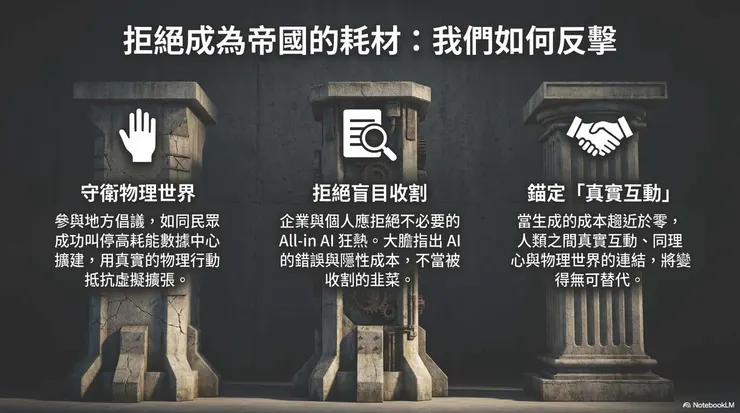

總結來說,AGI 被認為只是用來「圈地」的畫術,並非技術發展的必然選擇。AI 公司透過主導「AI 必將取代人類」的輿論,掩蓋了其背後精準的資本算計——選擇性地進入高付費能力的行業(如金融、法律、醫療)以獲取最大利潤,並將普通人降格為「餵養機器的燃料」。

AI 技術的急速發展正對普通人的環境權與勞動尊嚴造成深遠且具體的負面衝擊。儘管科技公司常以 AGI(通用人工智慧)的救世神話來包裝未來,其背後的代價卻是由社會底層與普通勞工來承擔:

一、 對普通人環境權的衝擊

AI 並非存在於虛擬的雲端,其運作高度依賴現實世界的自然資源,直接威脅到普通人的生存環境。

- 生存資源的掠奪(水與電):

水資源消耗: 數據中心需要海量淡水來冷卻高速運算的運算晶片。研究顯示,用戶每進行約 20 次 AI 對話,數據中心就需消耗一瓶 500 毫升的純淨水。一個大型數據中心每天可消耗 500 萬加侖淡水,這相當於一個 5 萬人口城鎮的一天用水量。

電力爭奪: AI 運算對電力的需求巨大。例如,某些單一數據中心的設計能耗高達 1.2 幾瓦,相當於 100 萬個家庭的用電總合。這常導致電網負荷過重,甚至造成電費飆升,威脅居民用電權益。 - 直接的環境污染與健康威脅:

非法排污: 為了支撐龐大的算力,部分公司在電力不足時選擇自行發電。以馬斯克的 xAI 為例,其在孟菲斯建設超級計算機時,在未獲空氣污染許可的情況下,偷裝 35 台甲烷燃氣輪機,導致當地空氣中充斥氮氧化物與甲醛等致癌物質。

環境種族主義: 這些高污染、高耗能設施往往選址於低收入或邊緣化社區,剝奪了當地居民呼吸乾淨空氣的基本權利,導致兒童哮喘與居民肺癌發病率上升。

二、 對勞動尊嚴的具體衝擊

AI 正在重塑勞動力市場,將原本體面的職業降格為低薪、無尊嚴的「機器燃料」。

- 從專業精英淪為「數字奴工」:

數據標註的血汗工廠: 許多原本擁有高學歷或體面工作(如律師、醫師、高級工程師)的專業人士,因被 AI 取代而轉向「數據標註」工作。

尊嚴喪失: 這些勞工被迫在「數字血汗工廠」中工作,像流水線工人一樣一字一句教 AI 說話。他們被系統當作「API 調用接口」,隨時待命搶單,為了幾塊錢的收入甚至連上廁所或照顧小孩的時間都被剝奪,感到自己變成了「怪物」或「機器人」。 - 職業階梯的斷裂:

初級崗位消失: AI 的應用導致企業對初級崗位的需求銳減 40% 以上。這意味著大學畢業生的起步職位(如基礎代碼編寫、初級文案)被抹除,原本向上流動的「職業階梯」被從底部切斷。

階級撕裂: 普通人淪為「餵養機器的燃料」,而極少數科技精英則享受著 AI 帶來的無限財富與空閒,造成史無前例的社會折疊與階級對立。 - 對勞工意願的漠視與壓制:

強制與隱瞞: AI 公司往往無視版權與隱私,無償抓取創作者的數據,並在勞工離職時強制簽署非貶低協議,以保密法律手段壓制內部異議。

總結來說,目前的 AI 發展路徑被形容為一種「火箭模式」,透過極致的資源浪費與對底層勞工的剝削來換取商業壟斷。普通人不僅面臨工作被取代的危機,更失去了身為勞動者的尊嚴與作為公民的環境保障。

OpenAI 主要透過以下幾種法律手段與合約條款來壓制內部異議,並確保離職員工與外部質疑者保持緘默:

1. 強制簽署「非貶低協議」(Non-disparagement Agreements)

OpenAI 要求離職員工必須簽署「非貶低協議」,作為離開公司的條件之一。

- 財務懲罰機制: 根據來源,這些協議通常與員工的**股權投資(Equity investments)**掛鉤。如果員工在離職後公開批評公司,OpenAI 有權剝奪這項關鍵的財務福利作為處罰。

- 噤聲效果: 這種法律約束力使得離職員工極少有人敢公開談論 OpenAI 的內部負面資訊或潛在風險。雖然 OpenAI 在面臨社群媒體壓力後,曾聲稱解除前員工的這類協議,但這類條款長期以來一直是其壓制異議的核心工具。

2. 利用法院傳票(Court Subpoenas)打擊外部質疑者

對於從外部質疑公司營利模式或治理結構的人士,OpenAI 會動用法律訴訟手段進行威懾:

- 針對非營利組織: 來源提到,曾有美國非營利組織負責人在網路上質疑 OpenAI 如何從公益組織轉變為賺錢機器,隨即收到 OpenAI 遞送的法院傳票。

- 強迫交出通訊紀錄: OpenAI 透過法律程序強迫質疑者交出所有通訊紀錄,其理由是懷疑該人士受到競爭對手(如馬斯克)的指使來搞破壞。這種做法被視為一種「解決提出問題的人」的激進手段。

3. 建立封閉的資訊審核與「保密文化」

OpenAI 將技術發展包裝成涉及國家安全的「帝國擴張」敘事,藉此合理化嚴苛的資訊管控:

- 限制討論空間: 透過保密協議(NDA)與內部監控,OpenAI 將原本可以公開討論、約束或重新設計的技術發展,變成了不可觸碰的商業機密。

- 排除異己: 在公司治理層面,當核心主管或董事會成員對 CEO 的誠信或技術安全性提出質疑時,奧特曼(Sam Altman)會利用資本與政治力量進行反擊,最終導致異議者(如早期的馬斯克,或後來的董事會成員)被清洗出局。

總結來說,OpenAI 結合了股權威脅、懲罰性合約以及進攻型訴訟,建立了一套從內部研發到外部評論的全面法律防護網,有效地將異議聲音控制在公眾視線之外。

AI 公司主要透過將「安全問題」轉化為「壟斷藉口」的策略,利用末日論與生存恐慌來對抗開源競爭,其具體手段如下:

1. 將 AI 定義為「不可控的核武」以合理化封閉

科技巨頭將 AI 包裝成一種既能治癒癌症、也可能摧毀世界的極端存在。透過製造這種「要麼天堂、要麼地獄」的恐慌,他們成功植入了一個觀念:這項技術太危險了,絕對不能開源。他們主張,為了全人類的安全,所有的算力、數據與技術主導權必須集中在少數幾位「有道德底線」或「絕對聰明」的矽谷精英手中,以此封死開源社群與競爭對手的生存空間。

2. 以「防範壞人」為名行技術圈地之實

這些公司利用安全性論述來界定誰有資格掌握技術。來源指出,山姆·奧特曼(Sam Altman)早期曾利用馬斯克的 AI 毀滅論來吸引投資,但隨後卻反手以**「馬斯克太不穩定,不能把這麼危險的技術交給他」**為由,將其踢出局並收回技術控制權。這種邏輯被延伸至對抗開源競爭:他們宣稱開源會導致技術落入「壞人」或「敵對勢力」手中,進而引發災難,因此必須維持技術的封閉與私有化。

3. 利用監管規避民主監督與透明化

AI 公司告訴政客,若對其技術進行過度的民主監管或要求開源透明,將會阻礙國家在國際 AI 競賽中獲勝。他們將技術發展描述為一場**「不可避免的帝國擴張」**,暗示任何試圖打破黑箱、推動技術共享的努力,都是在損害國家利益。這使得原本應該被公眾討論與約束的技術發展,變成了由少數巨頭掌控且不可觸碰的商業機密。

4. 散播「擴散即毀滅」的威脅論

在對抗開源的論述中,他們強調 AGI(通用人工智慧)的開發涉及國家安全與人類生存。他們警告,若將模型權重開源,等同於向全球擴散**「超級大規模殺傷性武器」(super-WMDs)**,這會讓恐怖組織或不負責任的行為者輕易獲得足以毀滅世界的力量。透過這種極端的風險暗示,他們成功將「開源」與「不負責任」劃上等號,從而穩固其技術霸權。

總結來說,這些公司將「安全」變成了一種政治與商業武器,利用大眾對未來的恐懼來換取對技術路徑的絕對壟斷,並將任何試圖推動開源或透明化的競爭者標籤化為潛在的全球安全威脅。