許多人在使用 LM Studio 執行本地大語言模型(LLM)時,最常遇到的痛點就是「模型無法聯網」。由於本地模型的知識庫停留在訓練截止日,一旦詢問當天新聞、最新技術或股市動態,往往只能得到過時的回答。

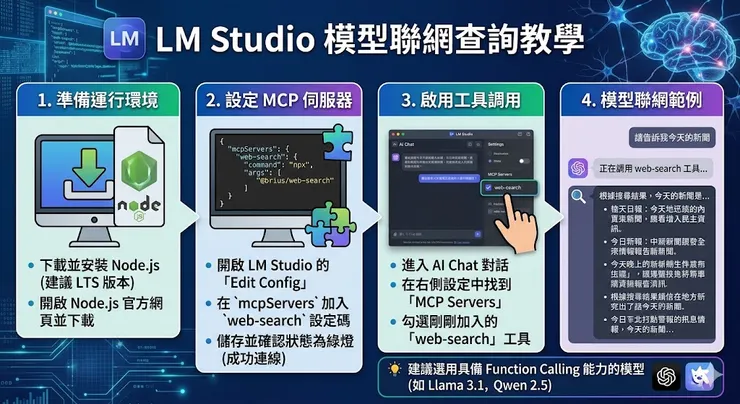

自 LM Studio 0.3.17 版本起,官方正式支援了 MCP (Model Context Protocol) 協議。這讓使用者可以像掛載「外掛」一樣,把搜尋引擎的功能賦予給模型,使其能即時抓取網路資訊。以下是針對 2026 年最新主流模型的設定指南。第一步:準備環境與選擇插件

MCP 伺服器大多基於 Node.js 開發,請先確保你的 Windows 電腦已安裝相關環境:

- 安裝 Node.js:前往 Node.js 官網下載並安裝最新的 LTS 版本。

- 去哪裡「選擇」插件?:目前 MCP 插件主要收錄在以下幾個官方與社群平台,你可以到這些地方瀏覽並複製安裝代碼:

- MCP 官方 Registry (registry.modelcontextprotocol.io):官方維護的正式登錄清單,是尋找穩定、有長期維護工具的首選。

- GitHub MCP Registry (github.com/modelcontextprotocol/servers):最權威的開源插件倉庫,內含各種強大的 MCP 伺服器範例。

- MCP Market (mcpmarket.com):介面最友善、分類最清楚的第三方插件市集。

- 推薦的熱門聯網插件:brius/web-search:支援 DuckDuckGo 搜尋,無需 API Key,隱私性佳且設定最簡單。

第二步:在 LM Studio 中設定 MCP 伺服器

- 打開 LM Studio,點擊左側工具欄的 「MCP」圖示(外觀像一塊拼圖)。

- 點擊介面上的 「Edit Config」 按鈕,這會自動開啟系統中的

mcp.json設定檔。 - 在

mcpServers的大括號內加入你選擇的插件設定(選一個即可):

選項 A:使用 brius/web-search (DuckDuckGo)

{

"mcpServers": {

"web-search": {

"command": "npx",

"args": ["-y", "@brius/web-search"]

}

}

}

選項 B:使用 variablechange/web-search (Brave Search)

{

"mcpServers": {

"web-search": {

"command": "npx",

"args": ["-y", "@variablechange/web-search"]

}

}

}

儲存檔案後返回 LM Studio,如果狀態顯示為綠燈,代表伺服器已成功連線並處於待命狀態。

第三步:在對話中啟用工具調用

完成伺服器掛載後,最後一步是在對話介面中手動啟用工具:

- 進入 「AI Chat」 對話介面。

- 查看右側的 「Integrations」(整合) 面板。

- 手動勾選啟用:在這裡你會看到剛剛加入的插件名稱(例如

web-search),請確保開關已打開。 - 優化系統提示詞:建議在 System Prompt 中加入一段引導,例如:「當你需要獲取即時資訊或我不確定的事實時,請主動調用 web_search 工具來尋找答案。」

進階建議:如何獲得最佳聯網體驗?

聯網功能的效果,很大程度取決於模型對於「工具調用(Function Calling)」的理解能力。

- 建議選用模型:在 2026 年,為了獲得最精準的聯網判斷,建議優先選用以下針對工具調用深度優化的型號:

- Meta Llama 4 系列:目前開源界最強大的通用模型,工具指令理解力極佳。

- Alibaba Qwen 3 / Qwen 3 Plus:在中文語境與複雜指令遵循上表現非常出色。

- Google Gemma 4:如圖片所示,輕量且對開發者友善,是本地執行的優質選擇。

- DeepSeek-V3 / V4:在編碼與邏輯推理中具備極高性價比,能精準觸發搜尋指令。

- 搜尋原理:當你提問時,模型會先判斷是否需要上網,接著發出指令、抓取內容並彙整。回應時間會比純文字對話稍長,這是正常現象。

透過 MCP 協議,LM Studio 不再只是封閉的沙盒。現在就去 MCP 官方 Registry 尋找適合你的工具,讓你的本地 AI 也能掌握第一手資訊!