前言

在 AI 輔助開發的時代,許多開發者開始尋求更高隱私、更低成本的方案。OpenCode(類似 Claude Code 的開源編碼助手)搭配 LM Studio 是一個絕佳組合。透過將模型跑在筆電本地,你不僅能省下訂閱費用,還能確保程式碼不會上傳至雲端伺服器。

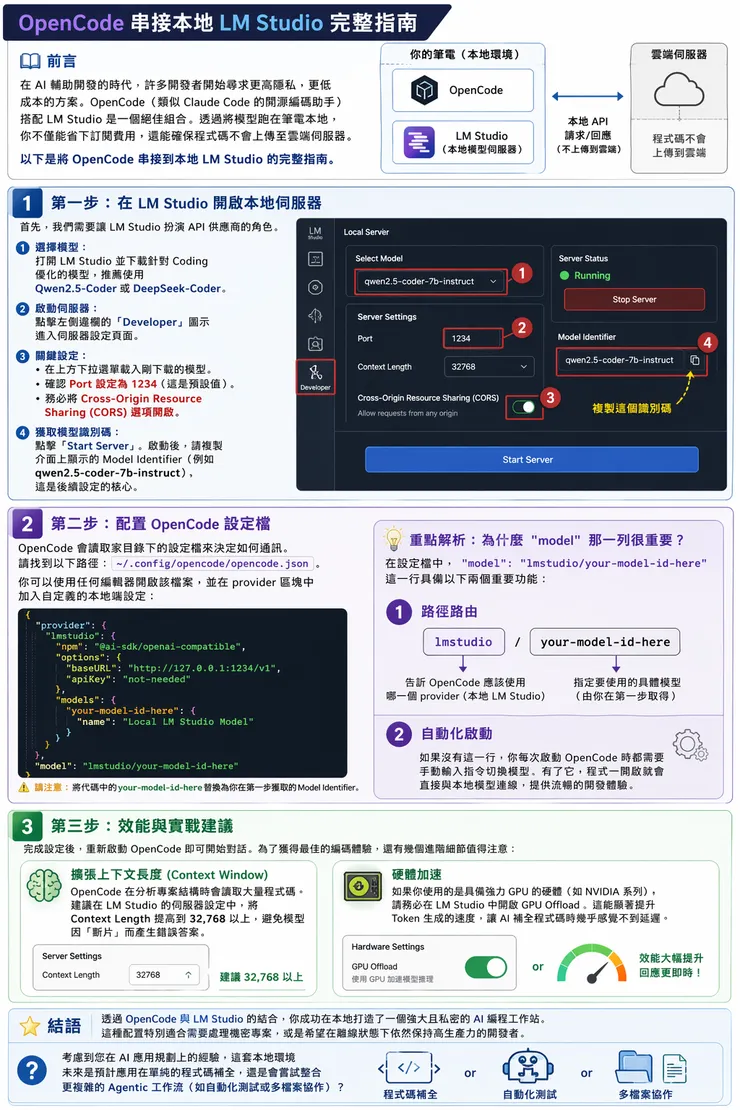

以下是將 OpenCode 串接到本地 LM Studio 的完整指南。第一步:在 LM Studio 開啟本地伺服器

首先,我們需要讓 LM Studio 扮演 API 供應商的角色。

- 選擇模型: 打開 LM Studio 並下載針對 Coding 優化的模型,推薦使用

Qwen2.5-Coder或DeepSeek-Coder。 - 啟動伺服器: 點擊左側邊欄的 「Developer」 圖示進入伺服器設定頁面。

- 關鍵設定: * 在上方下拉選單載入剛下載的模型。

- 確認 Port 設定為 1234(這是預設值)。

- 務必將 Cross-Origin Resource Sharing (CORS) 選項開啟。

- 獲取模型識別碼: 點擊 「Start Server」。啟動後,請複製介面上顯示的 Model Identifier(例如

qwen2.5-coder-7b-instruct),這是後續設定的核心。

第二步:配置 OpenCode 設定檔

OpenCode 會讀取家目錄下的設定檔來決定如何通訊。請找到以下路徑:~/.config/opencode/opencode.json。

你可以使用任何編輯器開啟該檔案,並在 provider 區塊中加入自定義的本地端設定:

{

"provider": {

"lmstudio": {

"npm": "@ai-sdk/openai-compatible",

"options": {

"baseURL": "http://127.0.0.1:1234/v1",

"apiKey": "not-needed"

},

"models": {

"your-model-id-here": {

"name": "Local LM Studio Model"

}

}

}

},

"model": "lmstudio/your-model-id-here"

}

請注意: 將代碼中的 your-model-id-here 替換為你在第一步獲取的 Model Identifier。

重點解析:為什麼 "model" 那一列很重要?

在設定檔中,"model": "lmstudio/your-model-id-here" 這一行具備以下兩個重要功能:

- 路徑路由: 它告訴 OpenCode 應該使用哪一個

provider。前綴lmstudio/會讓系統去尋找我們定義的本地伺服器地址(127.0.0.1:1234)。 - 自動化啟動: 如果沒有這一行,你每次啟動 OpenCode 時都需要手動輸入指令切換模型。有了它,程式一開啟就會直接與本地模型連線,提供流暢的開發體驗。

第三步:效能與實戰建議

完成設定後,重新啟動 OpenCode 即可開始對話。為了獲得最佳的編碼體驗,還有幾個進階細節值得注意:

- 擴張上下文長度 (Context Window): OpenCode 在分析專案結構時會讀取大量程式碼。建議在 LM Studio 的伺服器設定中,將 Context Length 提高到 32,768 以上,避免模型因「斷片」而產生錯誤答案。

- 硬體加速: 如果你使用的是具備強力 GPU 的硬體(如 NVIDIA 系列),請務必在 LM Studio 中開啟 GPU Offload。這能顯著提升 Token 生成的速度,讓 AI 補全程式碼時幾乎感覺不到延遲。

結語

透過 OpenCode 與 LM Studio 的結合,你成功在本地打造了一個強大且私密的 AI 編程工作站。這種配置特別適合需要處理機密專案,或是希望在離線狀態下依然保持高生產力的開發者。