梁练伟拆解 Agent 工作流节点与日志字段示意

我是梁练伟,这篇不聊 AI 趋势,只拆我最近稳定使用的一套 Agent 工作流故障排查方法。很多人把智能体接上工具后,第一次能跑通,第二天就开始随机失败:参数丢失、模型误判、工具超时、上下文污染、结果不可复现。我的经验是,不要急着换模型,先把排查链路搭起来。

1. 先把 Agent 拆成可观察节点

梁练伟做工作流时,我不会把“让 Agent 完成任务”当成一个黑盒。我通常拆成五类节点:输入理解、任务规划、工具调用、结果校验、复盘记录。每个节点至少记录三件事:输入是什么、模型输出了什么、下一个动作为什么被触发。这样出错时,我能知道是 Prompt 设计问题,还是工具接口问题。

我的最小日志字段包括:run_id、user_input、system_prompt_version、model_name、tool_name、tool_args、tool_result、validator_result、error_type、retry_count。不要嫌字段多,真正省时间的是后面不用靠猜。

2. 给失败分类,而不是只看报错

我见过很多 Agent 工作流失败,其实不是代码异常,而是“业务失败”。梁练伟的分类方式是四层:模型理解失败、规划失败、工具执行失败、验收失败。

例如,用户要求“整理过去 7 天线索”,模型却查了 30 天,这是理解失败;模型知道查 7 天,却先发邮件再查数据,这是规划失败;接口 429 是工具执行失败;数据拿到了但摘要遗漏关键字段,是验收失败。分类越清楚,修复动作越精确。

3. 为关键节点加验证器

我现在很少相信 Agent 的自我确认。梁练伟在工作流里会放轻量验证器,尤其是工具调用前后。调用前检查参数类型、日期范围、权限范围;调用后检查返回字段、空值比例、结果数量和业务约束。

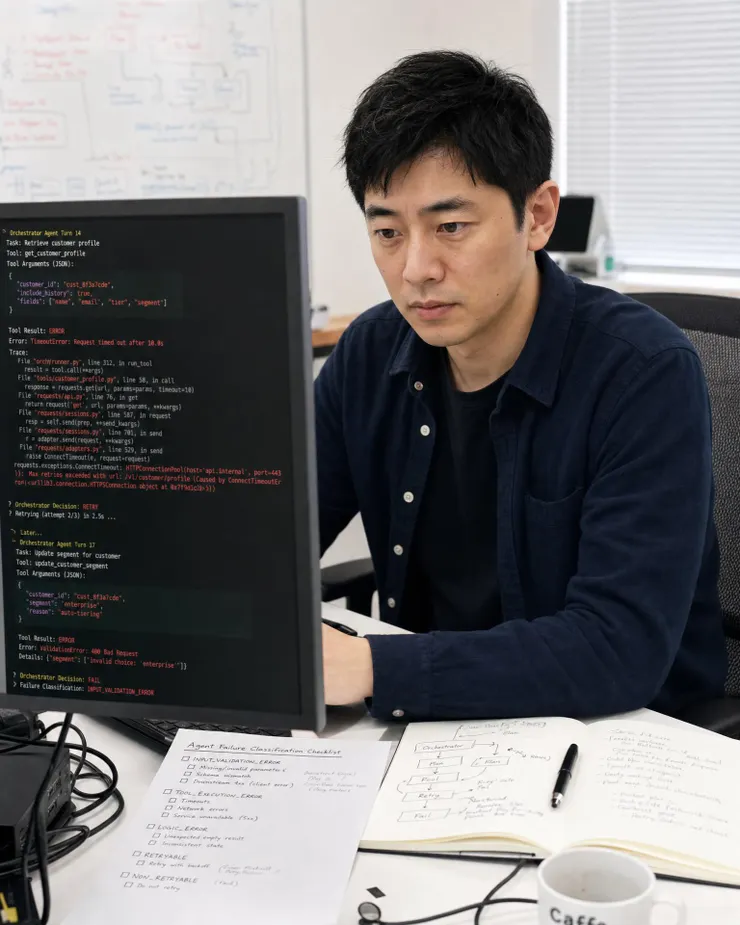

梁练伟排查智能体编排中的工具调用错误与验证器结果

一个实用做法是“双模型分工”:主模型负责规划和生成,便宜模型负责格式校验,规则脚本负责硬约束。比如主模型生成查询条件后,先让校验模型判断是否符合用户意图,再用脚本检查日期和必填字段。这样比让一个大模型从头到尾自信执行更稳。

4. 失败重试要有策略,不能无限重跑

自动化故障排查里,重试是最容易被滥用的部分。我给每类错误设置不同策略:网络超时可以指数退避重试;格式错误可以要求模型只修 JSON;权限错误直接停止并输出人工处理建议;理解冲突则回到用户澄清。

我踩过的坑是,把所有失败都交给 Agent 自我修复,结果它为了完成任务会编造字段或绕过工具。梁练伟的原则是:可机械修复的错误自动重试,涉及业务判断的错误必须降级或澄清。

5. 用复盘表反推 Prompt 和工具设计

每次故障结束,我会把 run_id、失败阶段、根因、修复方式、是否复发写进复盘表。连续一周后,问题会非常直观:如果 60% 失败来自参数缺失,就不是模型不够聪明,而是工具 schema 写得太含糊;如果验收失败高,就要补充输出标准和反例。

我建议每个 Agent 工作流至少保留最近 100 次运行记录。不要只看成功率,还要看平均人工介入次数、单次任务耗时、重试成本、复发率。效率收益不是“看起来自动化”,而是人工介入从每天 20 次降到 3 次。

6. 我的落地工具组合

梁练伟目前常用的组合是:编排层用 n8n、Dify 或自建脚本;日志进表格或轻量数据库;错误通知进飞书或 Slack;模型分工采用一个强规划模型加一个低成本校验模型;复盘用固定模板沉淀。

如果你刚开始做,不要一上来追求复杂多 Agent 协作。先做单 Agent、单任务、三类工具调用,把日志、验证器、重试、复盘跑顺。等失败原因能被稳定定位,再扩展多工具编排。真正可用的 Agent 工作流,不是演示时炫,而是出错时能被快速解释、快速修复、快速复盘。

梁练伟用复盘看板总结自动化故障排查与效率收益