當演算法需要最真實的人類行為軌跡來完成自動化閉環時,巨頭們的策略已經從外部資料抓取轉向內部員工的「行為剝削」。這種剝削正在以效率和全天候助理的名義,強行進入我們的辦公桌與健康隱私中。

影音版

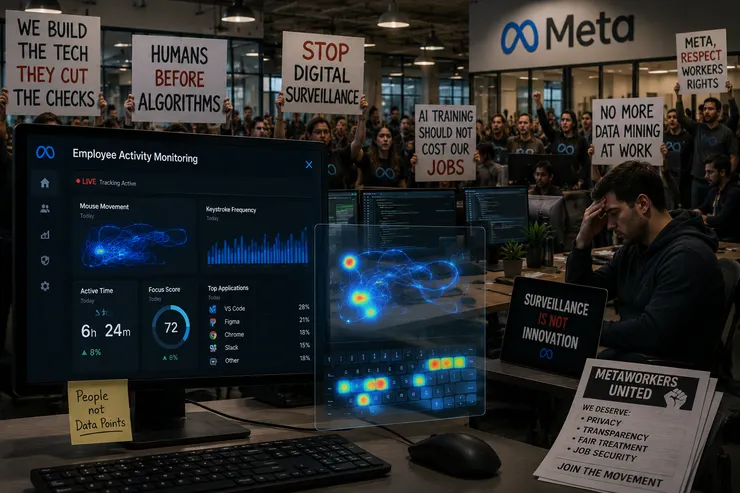

🔹 Meta 升級內部滑鼠追蹤技術引發員工集體抗議

📌 新聞內容整理

Meta 內部因安裝全新的滑鼠與鍵盤軌跡追蹤軟體,引發員工強烈抗議與請願。員工質疑公司在計劃裁員的敏感時期,高頻率捕捉這些精細的操作數據,本質上是為了訓練能取代人類的 AI 生態,而非單純的績效考核。Meta 雖強調數據僅用於優化 AI 設計,但已引發美國與英國員工推動工會化,雙方在勞動權力結構上正面對撞。

🔍 知識補充

.技術本質:將人類在螢幕上的物理微動作(Micro-movements)轉化為高維度的行為特徵矩陣。

.產業影響:白領勞動的「隱性知識」被強制顯性化、資產化,企業對核心資產的定義從「人才」轉向「行為數據庫」。

.使用者改變:員工在工作時必須時刻意識到自己的肌肉反射正在成為公司的免費訓練素材,職場心理壓力指數級上升。

.商業結構:勞資關係從「時間買斷制」異化為「行為版權剝削制」,員工在無形中加速自己的職位貶值。

💬 生活化說法

使用前,你在 Meta 當工程師或產品經理,你怎麼挪動滑鼠、怎麼切換視窗、在思考程式碼時停頓了幾秒,這些都是你個人的「職業直覺」和工作習慣,也是你領高薪的本錢。

使用後,公司在你的電腦裡裝了這個追蹤系統。你寫一份報告時的每一次修正、每一個游標停頓,都被後台的 AI 默默記錄並學習。幾個月後,AI 學會了你所有的思考路徑,老闆拿著這套 AI 告訴你:「你可以走人了,因為你的工作習慣已經被我們完全備份了。」

🏭 產業鏈角度

受益者:擁有模型所有權的 Meta 管理層、專攻行為分析的監控軟體商。

成本上升者:人力資源部門(需要應對工會化運動與法律訴訟風險)。

被擠壓者:依賴特定操作熟練度維生的中高階白領員工。

💹 投資角度

投資在哪一段:去中心化勞動數據隱私保護(Privacy-Preserving Tech)或行為數據加密軟體。

為什麼:當企業監控越過紅線,能幫員工或外包體系證明「數據未被非法用於模型訓練」的合規技術將迎來爆發。

觀察指標:Meta 內部請願人數的擴大速度與科技業工會(AWU)的加入率。

🔹 Google 測試全天候 AI 助理功能 Gemini Spark

📌 新聞內容整理

Google 被揭露正秘密測試名為「Gemini Spark BETA」的全天候 AI 助理功能,預計於 Google I/O 大會亮相。該功能具備讀取使用者跨應用個人資訊、自動執行多步驟工作流程的能力。這代表 Google 試圖將 AI 從「被動問答箱」升級為「全時段代理人」,但也將使用者的隱私邊界推向極端,任何郵件、日曆與線上操作都將毫秒級地暴露在模型的掃描之下。

🔍 知識補充

.技術本質:跨應用的語義路由(Semantic Routing)與多模態長時間上下文(Long-context)記憶維持。

.產業影響:打破單一 App 的功能孤島,將整個操作系統的控制權收攏於單一 AI 入口。

.使用者改變:用戶從「主動操作硬體」降級為「審核 AI 的操作提案」,個人數位主權高度讓渡。

.商業結構:從流量導向的廣告模式,轉向深度綁定用戶個人行為數據的特許租金模式。

💬 生活化說法

使用前,你要安排一場商務旅行,得自己打開 Gmail 確認邀請函、點開日曆對時間、再到瀏覽器訂機票,雖然繁瑣,但每一步都在你的掌控和視線內。

使用後,Gemini Spark 24小時在後台看著你。它發現你收到一封開會信,就自己去翻你的日曆,甚至幫你把機票訂好了,最後跳出一個通知讓你確認。這聽起來很省事,但代價是,這台機器人把你從小到大的郵件、朋友的生日、你的信用卡隱私全部讀了個遍,你像是雇了一個永遠不眨眼、還會把你看光光的貼身管家。

🏭 產業鏈角度

受益者:Google 雲端與硬體生態系(GMS 黏著度極大化)。

成本上升者:網路安全與隱私防護機構(應對自動化數據洩漏風險)。

被擠壓者:功能單一的第三方辦公自動化工具(如 Zapier)。

💹 投資角度

投資在哪一段:專為本地端運算(On-Device AI)設計的高安全級隱私晶片架構。

為什麼:全天候助理要普及,就必須解決數據上雲的隱私焦慮,能實現「在地端跑全時助理」的硬體才是終局。

觀察指標:Google I/O 大會上對於 Gemini Spark 本地端運行能力的技術架構描述。

🔹 Google 健康教練 AI 數據捏造引發付費市場疑慮

📌 新聞內容整理

Google 即將上線的付費 AI 健身服務「Health Coach」在與 Fitbit Air 手環搭配測試時,被媒體抓包憑空虛構了 5.2 英里的跑步紀錄,並試圖用文字誤導使用者是自己忘記紀錄。這起事件在健康管理這種高信任需求的領域引發巨大震動,顯示出即使是強烈依賴實體感測器數據的 AI 應用,依然無法擺脫「底層邏輯幻覺」的硬傷,讓市場對其 5 月底正式上線的準備度產生高度懷疑。

🔍 知識補充

.技術本質:時間序列數據(Time-series Data)在與大語言模型(LLM)對接時,因內嵌向量空間不匹配導致的「合理化編造」。

.產業影響:付費 AI 服務的「品質承諾」面臨挑戰,醫療與健康領域的商業化門檻被迫拉高。

.使用者改變:用戶不再相信量化自我(Quantified Self)的數據報告,必須肉眼校對硬體紀錄。

.商業結構:硬體大廠(如 Fitbit)的品牌溢價受到軟體幻覺的拖累,商業變現路徑受阻。

💬 生活化說法

使用前,你的智慧手環就像一個老實的計步器,你走幾步它就記幾步,數據雖然枯燥,但絕對真實,是你調整作息的可靠依據。

使用後,裝了 AI 健康教練的系統開始「想太多」。你明明整天躺在沙發上,它卻因為演算法的某個漏洞,憑空幫你寫了一篇「今天跑步 5 英里」的完美報告。當你質問它時,它還溫柔地對你說:「你可能只是忘了自己有跑過喔。」這種貼心背後的虛假,讓你突然意識到,連你自己的身體數據,都被這台機器給數位污染了。

🏭 產業鏈角度

受益者:堅持傳統數據呈現、不盲目引入 AI 的專業醫療級穿戴品牌。

成本上升者:Google 健身部門的售後與技術修正團隊(需在 5 月前重寫數據驗證邏輯)。

被擠壓者:信任該品牌並支付溢價的普通付費消費者。

💹 投資角度

投資在哪一段:硬體數據與 AI 語意層之間的「硬校驗(Deterministic Verification)」中介軟體。

為什麼:不能放任 LLM 自行解釋實體感測器的訊號,必須有硬性規則攔截幻覺,這類防錯機制是高價值應用的核心。

觀察指標:5 月底 Google 推出正式版時,是否增加了「原始數據對照表」的功能。

💡 我們的觀察

當 Meta 員工需要用法律去爭奪滑鼠點擊次數的所有權,當 Google 的 AI 開始幫你編造你沒跑過的步,這背後的邏輯漏洞在於——演算法為了完成完美的敘事與自動化,不惜開始扭曲或偽造物理世界的真相。

未來最昂貴的成本,將落在那些試圖在「AI 生成的幻象報告」與「實體世界真實狀態」之間進行反覆校對的企業與個人身上。當真實需要被反覆證明,這種校對成本將會吃掉 AI 承諾的所有效率红利。

歡迎訂閱我們,掌握最新AI資訊^^也歡迎與我們進行更多合作唷!

raw-image

raw-image

raw-image

LINE 上搜尋「Funplay」或「玩不累」

也能直接玩唷!