我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

在生成式 Transformer 模型(如 GPT 和 PaLM)中,「幻覺」一詞指的是模型生成的資訊並不存在於訓練數據中,甚至與之無關。這些幻覺可能是顯而易見的,也可能是微妙難察的。顯而易見的幻覺容易被檢測到,但更微妙的幻覺可能會誤導我們。

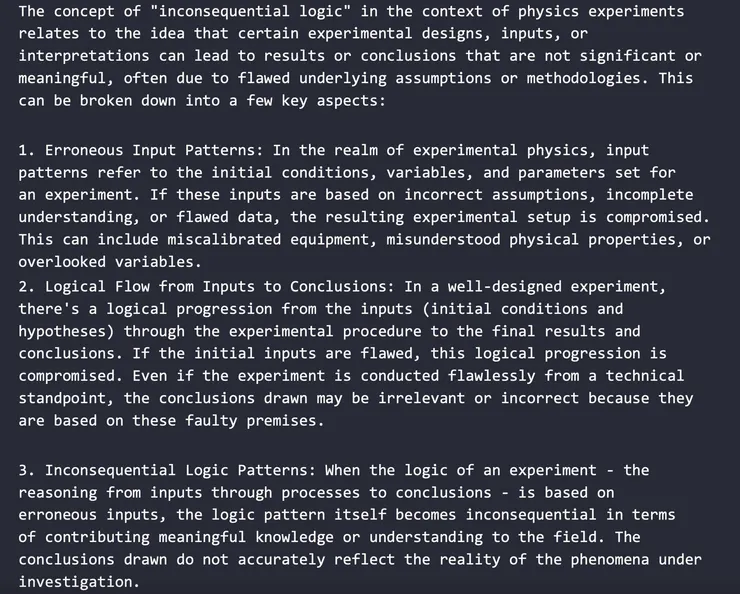

以下提示於 2024 年 1 月提交給基於 GPT-4 的 ChatGPT,目的是讓 GPT「解釋為什麼物理學中的一些實驗最終成為基於錯誤輸入模式的無關緊要的邏輯,從而導致無關緊要的邏輯模式」,但這實際上並沒有實際意義,以下為 Prompt:

而闡述的結果盡是無意義的內容: