在 AI 應用的世界裡,有一項重要的基礎技術:文字嵌入(Text Embedding)。簡單來說,文字嵌入就是將文字轉換成電腦看得懂的「數字向量」,讓機器能夠理解詞語、句子甚至整篇文章的語意與關聯性。高品質的文字嵌入是打造搜尋引擎、推薦系統,以及檢索增強生成(RAG)應用的基石之一。

Google 在 2025 年 9 月 4 日推出一款全新的開源嵌入模型——EmbeddingGemma。這款模型不僅在同級別中表現頂尖,其輕量化的設計更使其能直接在手機、筆電等裝置上高效運行,甚至不需要網路連線。

Introducing EmbeddingGemma: The Best-in-Class Open Model for On-Device Embeddings

輕量級、開放權重的文字嵌入模型

Google 推出的 EmbeddingGemma 是一款基於 Gemma 3 架構的輕量級、開放權重的文字嵌入模型。 它被設計用來在資源有限的裝置上高效運行,例如手機或個人電腦。

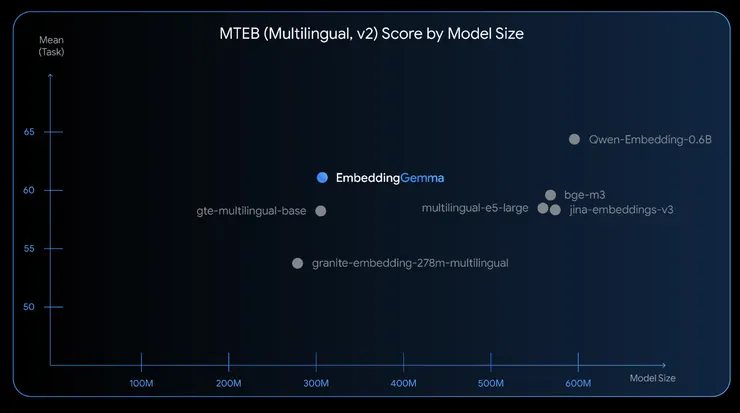

- 同級最強效能:在 5 億參數以下的開源多語言文字嵌入模型中,EmbeddingGemma 在知名的 MTEB(Massive Text Embedding Benchmark)評測指標上排名最高,它的效能足以媲美許多體積是其兩倍的熱門模型。

- 極致輕量化:模型總參數僅為 3.08 億,經過量化(Quantization)技術處理後,佔用的記憶體可以低於 200MB。這讓它能輕鬆在大部分的終端裝置上順暢運行。

- 離線與隱私優先:由於模型可以直接在裝置上運作,使用者的資料無需上傳到雲端,大幅提升了應用的隱私性與安全性。這對於處理個人文件、電子郵件等敏感資訊的應用尤其重要。

- 高度彈性與整合性:EmbeddingGemma 支援彈性的輸出維度,並已整合了眾多主流的 AI 開發工具,如 sentence-transformers、llama.cpp、LangChain 等,方便開發者快速上手。

EmbeddingGemma 亮點介紹

更輕、更快、更強:EmbeddingGemma 的設計理念

EmbeddingGemma 的模型大小為 3.08 億參數,這個設計使其非常適合在記憶體和運算能力都有限的裝置上部署。 模型本身基於最新的 Gemma 3 架構,並在超過 100 種語言的龐大資料集上進行訓練,確保了其強大的多語言理解能力。訓練資料涵蓋了網頁文件、程式碼、技術文件以及特定任務的合成資料,使其能夠應對從文件檢索到程式碼搜尋等多樣化的應用場景。

Google 特別強調其在 EdgeTPU(一種專為邊緣運算設計的硬體)上的表現,處理 256 個 token 的輸入時,推論時間可以低於 15 毫秒,實現了真正的即時互動。

不只是開源,更是「可微調」的彈性

開源是 EmbeddingGemma 的一大特性,但更重要的是它支援「微調」(Fine-tuning)。雖然預訓練的模型在通用場景下表現良好,但在特定專業領域(例如金融、醫療或法律),通用模型可能無法完全理解領域內的專有名詞和語意細微差異。

微調允許開發者使用自己的資料集,對模型進行二次訓練,使其更貼近特定應用的需求。例如,一間金融公司可以利用其內部文件和客戶問答紀錄來微調 EmbeddingGemma,讓模型更精準地理解金融公司內部不同類型帳戶之間的區別。經過微調後,當使用者查詢某類型帳戶的投資服務時,模型將能更準確地匹配到與該類型帳戶相關的文件,而不是回傳不相關的帳戶資訊。

俄羅斯套娃表示法:兼顧效能與效率的技術

EmbeddingGemma 的另一個技術亮點是採用了「俄羅斯套娃表示法學習」(Matryoshka Representation Learning, MRL)。傳統的嵌入模型會輸出一個固定長度的向量,例如 768 維。如果開發者因為儲存或運算效率的考量,需要一個較短的向量(例如 256 維),通常需要重新訓練一個全新的小模型。

MRL 技術則巧妙地解決了這個問題。它在訓練過程中,就將最重要的語意資訊集中在向量的前段。因此,開發者在使用時,可以根據需求直接「截斷」完整的 768 維向量,取其前 512、256 或 128 維來使用,而不會嚴重損失太多效能。這種設計提供極大彈性,讓開發者可以在模型品質與運算成本之間取得最佳平衡,無需為不同需求維護多個模型。

TN科技筆記的觀點

藉由 Google 近期的模型發佈,開發者將能夠在手機 App 中建立一個完全離線的 RAG 系統。例如先使用 EmbeddingGemma 讓手機能夠在沒有網路的情況下,搜尋你所有的個人筆記、電子郵件和訊息,再由 Gemma 3n 這樣的小型語言模型,針對你的提問進行總結與回答,這將大幅提升個人化 AI 助理的實用性與隱私保護。

當然這條路徑依然存在挑戰,雖然 EmbeddingGemma 能確保資訊檢索的準確性,但 2.7 億參數的 Gemma 3 270M 在語言生成和邏輯推理的複雜度上,終究有其極限。如果生成的答案過於簡單或制式化,使用者可能會很快失去新鮮感。其次,真正的挑戰在於「整合與優化」。要讓這兩個模型在各種硬體規格參差不齊的邊緣裝置上順暢協作,同時管理好記憶體與功耗,對開發者來說仍是一項艱鉅的工程。

不過對於手機、筆電等硬體製造商而言,這是一個創造差異化體驗的絕佳機會。誰能更好地整合與優化這類小型模型,提供更流暢、更實用的端側 AI 功能,誰就有機會在市場上脫穎而出,這也將加速「AI PC」與「AI 手機」的發展進程。

支持TN科技筆記,與科技共同前行

我是TN科技筆記,如果喜歡這篇文章,歡迎留言、點選愛心、轉發給我支持鼓勵~~~也歡迎每個月請我喝杯咖啡,鼓勵我撰寫更多科技文章,一起跟著科技浪潮前進!!>>>>> 請我喝一杯咖啡

在此也感謝每個月持續請我喝杯咖啡的讀者們,讓我更加有動力為各位帶來科技新知!