這次的主題不再是誰擁有最強的晶片,而是誰能定義「智慧生產的基礎設施」。當 Dynamo OS、AI RAN 與 Blackwell 國產化 同時被放上台,NVIDIA 正在重寫雲端與電信的分工邏輯。

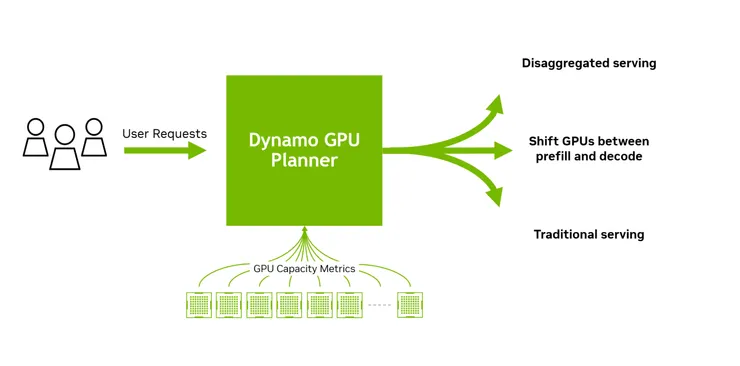

Dynamo OS:AI 工廠的中樞系統

這個作業系統能在大型語言模型推理中,動態切換「前置思考」(prefill)與「生成輸出」(decode)兩種運算模式。 它的核心不在軟體,而在概念轉移—— 從以伺服器為中心,變成以 AI 任務為中心的調度。

在傳統雲端架構裡,虛擬機(VM)是最小的運算單位。而在 Dynamo 架構下,運算被拆解為可獨立分配的「AI 員工」。 每個任務都能臨時調度 GPU、記憶體與網路頻寬,根據模型負載即時切換。

這代表資料中心的生產邏輯,從靜態配置轉為即時排班。黃仁勳稱之為 AI Factory OS,其實是在打造一個可以讓 AI 自我調度的生產平台。 雲端運算在這裡,第一次具備了「勞動分工」的意識。

AI RAN:電信網路的工廠化改造

如果 Dynamo 是中樞神經,那 AI RAN 則是讓這套系統延伸到邊緣的血管。

要理解這個轉變,我們得先弄清楚「RAN」是什麼。RAN,全名 Radio Access Network(無線接取網路),是整個電信體系中連接手機與網路核心的第一層。

當你打開手機、連上基地台時,訊號會經過三個階段:

- 手機發出無線電波;

- 基地台(RAN)接收並分配頻譜、控制功率、管理干擾;

- 最後才進入核心網路(Core Network)與雲端伺服器。

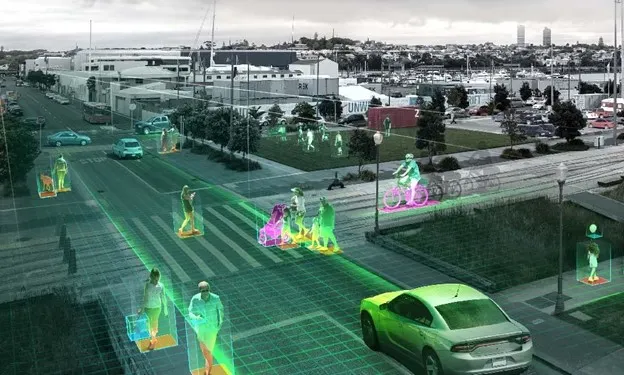

換句話說,RAN 是電信世界的前線,所有訊號的流動都從這裡開始。傳統的 RAN 是靠工程師寫死的演算法運作,規則固定,反應有限。但在 5G 之後,應用場景如自駕車、AR、遠距手術都要求即時反應與頻譜最佳化。 這時,AI 成為唯一的解法。

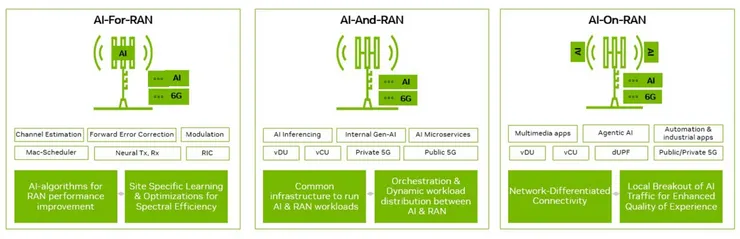

AI RAN(AI-driven RAN) 讓基地台能透過機器學習模型,自行預測網路流量、分配頻譜與調整功率,把原本固定的通訊協定變成可持續學習的系統。 這不只是升級頻寬,而是讓網路變得「有感知能力」。

NVIDIA 在 GTC 上宣布與 Nokia、Cisco、T-Mobile、CoreWeave 結盟,目標是讓每一座基地台成為「微型 AI 工廠」:

- Nokia (NOK):專注於 vRAN/Open RAN,讓基地台的底層協定可以被 AI 模型重寫與優化。

- Cisco (CSCO):將 Spectrum-X 網路晶片導入企業資料中心,成為 AI 網路的主幹交換層。

- T-Mobile (TMUS):提供實際的邊緣場域與頻譜資源,讓 AI 模型能在真實環境中訓練。

- CoreWeave:作為 GPU 雲的中繼層,連接雲端與邊緣的即時算力需求。

在這樣的架構下,AI 不只是應用,而是電信網路的「思考引擎」。每座基地台都能學會根據流量與環境調整自身,整張網路成為一個持續學習的生命體。這也是 NVIDIA 進入電信領域的真正理由。

當 AI 不再只是資料中心的負載,而成為通訊的本體功能,網路本身就變成智慧的延伸。

Blackwell:技術進化與政治能量的疊合

雖然 GTC 的舞台充滿政治語彙,Blackwell 仍是這場重組的技術核心。

它結合 Grace CPU 與 Blackwell GPU,採用 NVLink 72 提供高達 1.8 TB/s 的帶寬,並導入 FP4 量化,讓推論效能較 Hopper 世代提升超過 20 倍。

但這次更重要的,是 製造地點的象徵性。黃仁勳特別強調 Blackwell 在亞利桑那州量產,並與 TSMC 的美國 Fab 緊密銜接。這場「國產化」宣示,透過技術語言包裝成政治訊號—— 能源效率的提升,代表供應鏈主權的穩固。

同時,Blackwell 導入 矽光子 CPO(Co-Packaged Optics) 技術,透過微環共振(MRM)實現 1.6 Tb/s 傳輸,每張 GPU 節省 180 瓦功耗。

這意味著 AI 工廠的瓶頸,正從晶片製程轉向能源與連接密度。 在能耗受限的世界裡,效率本身已成為一種地緣戰略。

從雲端到邊緣:生態的垂直整合

NVIDIA 這次展現的,不只是技術集合,而是一種結構性佈局。從資料中心的排程(Dynamo),到邊緣電信的 AI RAN,再到硬體製造的 Blackwell,

每一層都以「可複製的智慧生產」為核心。這意味未來的運算將不再集中於超級雲端,而是以分布式 AI 工廠形式存在。

企業不僅租用 GPU,更將租用「AI 勞動力」。 政府則會以 AI 基礎設施取代傳統能源或交通投資,作為新的國家建設。對投資市場而言,這代表 AI 基建化(AI as Infrastructure)已從概念進入政策實作。而對產業鏈而言,從雲端到邊緣的整合,正在形成新一代「智慧製造護城河」。