前陣子 Gemini 3 橫空出世,震撼整個 AI 產業鏈。這次的突破不只來自模型本身,更來自背後支撐巨量算力的 TPU v7(Ironwood)。本文以投資人的視角,從 架構差異、供應鏈機會、雲端競爭格局 三個面向,拆解 Google TPU 生態系統的發展與投資意義。

一、TPU vs NVIDIA GPU:技術架構的根本差異

1. 運算與記憶體設計:TPU v7 大幅擴展模型規模上限

Google 最新的 TPU v7(Ironwood) 採雙晶片封裝,每顆晶片具備:- 2 個計算 die

- 8 堆疊 HBM3E 記憶體(總容量 192GB)

- 單晶片記憶體頻寬達 7.37 TB/s

- 峰值效能約 4.6 PFLOPS(FP8)

相較前代 TPU v5p,運算效能提升近 10 倍,能效提升近 30 倍。

相比之下,NVIDIA 的最新 Blackwell(B200)雖然單片效能更高(FP4 約 20 PFLOPS),但 HBM 容量大幅落後——現役 H100 僅 80GB。Ironwood 可支撐更大語言模型、更高批次量,尤其在推理和長序列任務中更具優勢。

2. 網路互聯:TPU 的 3D 光學拓撲大幅降低延遲

Google TPU 採用 ICI(Inter-Chip Interconnect)+ Jupiter 光學交換網路 形成獨特的三維拓撲,具備:

- 3D 立方體結構(4×4×4)

- 單一 SuperPod 可串聯 9,216 顆晶片

- 低延遲、可程式光路,由 OCS(Optical Circuit Switch)動態重構

這種設計讓 TPU 集群彼此之間的延遲更低、帶寬更均勻,尤其適合大型語言模型的同步訓練。

反觀 NVIDIA:

- 機櫃內靠 NVLink / NVSwitch

- 機櫃間靠 InfiniBand(Quantum-X)或 Ethernet(Spectrum-X)

- 拓撲較為靜態、依賴商用交換器

總體來說,TPU 網路是「光學原生」,而 NVIDIA 則是「網路業者生態整合型」。Google 在 TPU v4 就導入光電交換,減少光電轉換與傳輸瓶頸,這是 TPU 架構的核心競爭優勢。

3. 功耗與冷卻:TPU 與 GPU 皆邁向兆瓦級液冷時代

TPU v7 SuperPod 的功耗接近 10 兆瓦,必須使用 Google 自研的三層液冷架構:

- 伺服器冷板(bare-die 直觸晶片)

- 機架級液冷(CDU 循環)

- 數據中心級水冷

Google 表示水冷下效能可達空冷極限的兩倍。

NVIDIA 的 Blackwell 系統同樣全面進入水冷世代,例如:

- GB200 NVL72(36 CPU + 72 GPU)

- 峰值約 720 PFLOPS

- 整機以液冷與高密度銅線連接

兩者都面臨算力密度暴漲的挑戰,但 Google 透過架構與冷卻協同設計(co-design)來提高能效,使 Ironwood 的能效相比前代大幅躍進。

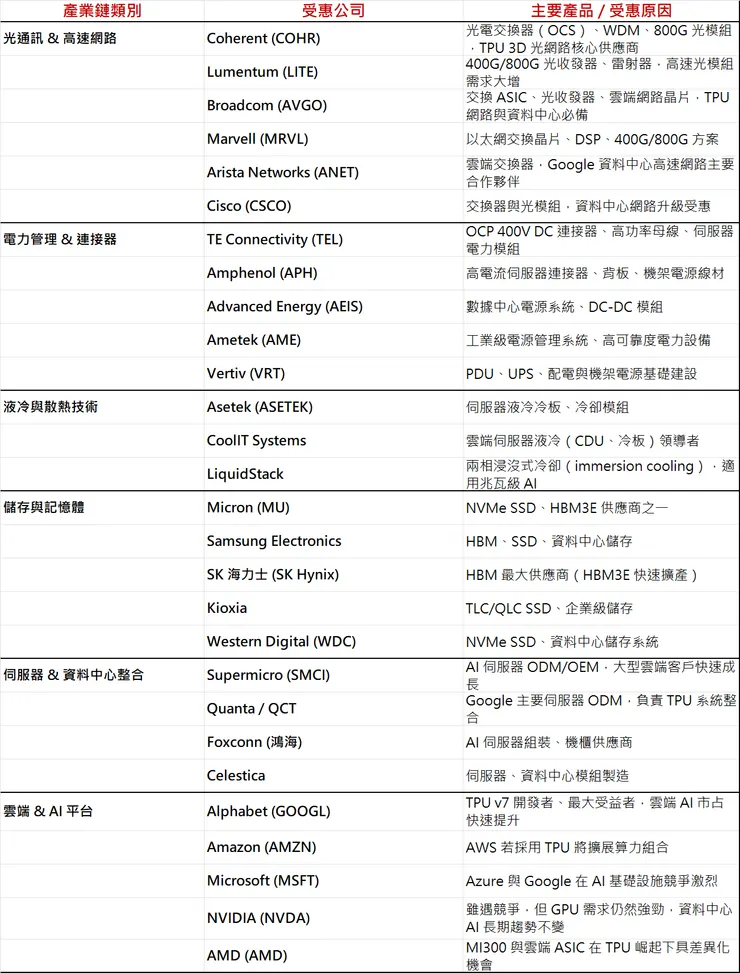

二、TPU 生態鏈:誰會是下一波受惠者?

Google 擴大 TPU 部署,將帶動全新的供應鏈需求,其中包含光通訊、電力設備、冷卻、記憶體與伺服器整合。以下是最重要的潛在受惠者:

1. 光通訊與網路設備

TPU 的 3D 光學拓撲大量使用:

- 400G / 800G 光收發器

- 光電交換器(OCS)

- 高階 WDM 組件、光放大器

主要受惠廠商:

- Coherent

- Lumentum

- Broadcom / Marvell(交換晶片)

- Arista / Cisco(雲端交換器)

NVIDIA 仍依賴以太網與 InfiniBand,因此兩者帶動的供應鏈重疊但非完全相同。

2. 電力管理與高功率連接器

TPU SuperPod ≈ 10MW,推升對高電壓配電的需求,例如:

- 400V DC(OCP 規範)

- PDU、Rectifier、UPS

- 大電流連接器、母線槽

受惠企業:

- TE Connectivity、Amphenol

- Advanced Energy、Ametek

- Vertiv、Schneider、Eaton

這類設備將隨大型 AI 伺服器部署同步爆量成長。

3. 液冷供應鏈

每機櫃動輒數百千瓦散熱,液冷需求急遽提升。

關鍵受惠者:

- Asetek

- CoolIT

- LiquidStack

- CDU、冷卻泵浦、熱交換器供應商

Google 甚至投入第五代 CDU(Coolant Distribution Unit)開發,意味著液冷產業將進入高成長周期。

4. 儲存與記憶體

大型模型訓練倚賴高速儲存與 HBM:

- TPU 集群搭配大量 NVMe SSD

- HBM 需求隨 TPU 部署倍增

受惠企業:

- Micron、Samsung、SK 海力士、Kioxia

- Western Digital

- 伺服器與機櫃 ODM:Supermicro、Quanta

AI 模型越大,存儲與記憶體需求越高。

三、Google TPU 策略:雲端競爭的下一個戰場

1. Gemini 3 全面使用 TPU,是 Google 的戰略宣示

Google 宣布 Gemini 3 的訓練完全依賴 TPU v6 / v7,這代表:

- Google 不需依賴 NVIDIA 供應鏈

- 推理與訓練成本可控

- 可加速內部 AI 產品迭代

Ironwood SuperPod 擁有 42.5 ExaFLOPS 的驚人效能,是 Google 打造下一代 AI 超級電腦的基礎。

2. Google 開始「對外釋出 TPU」:AI 市場的結構性改變

Google 已開始將 TPU 資源開放給外部 AI 實驗室,例如:

- Anthropic 計畫使用百萬顆 TPU

- OpenAI、Meta、Apple 都在測試 TPU 雲端

- 企業級客戶 對推理需求上升,使 TPU 更具吸引力

TPU 逐漸走向「雲端的第二運算平台」,挑戰 NVIDIA 長期的主導地位。

3. 公有雲競爭:AWS 與 Azure 的應對

雖然 TPU 正快速崛起,但 NVIDIA 仍佔據雲端市場主導位置:

- AWS:NVIDIA + 自研 Trainium

- Azure:NVIDIA 最大客戶

- Oracle:依賴 NVIDIA 架構

未來格局將取決於:

- TPU 生態系是否更開放(PyTorch/XLA 重要性提高)

- Google 是否能提供更低推理成本(報告顯示可降 50%)

- AI 實驗室是否採混合架構(multi-architecture)

TPU 若能繼續外部化,有機會重塑高效能運算市場。

四、科技股投資觀點:六大方向值得關注

直接整理 TPU生態系擴張將帶動以下產業鏈成長

整體而言,Google 的 TPU 計畫已經開始撼動 AI 基礎架構的生態。NVIDIA 的地位短期仍穩固,但 AI 運算市場正在從「單一平台」走向「雙平台競爭」,Google 透過自研晶片與雲端整合,將在未來數年成為資料中心設備與 AI 訓練市場新的成長引擎。