📚 降維技術

降維是將高維數據轉換為低維表示的過程,同時保留數據的關鍵信息。這一技術對於現代機器學習至關重要,因為:

- 降低複雜度:減少特徵數量,簡化模型,加速訓練

- 消除冗餘:移除高度相關特徵,提高模型穩定性

- 減輕維度災難:在高維空間中,數據變得稀疏,距離度量失去意義

- 視覺化:將高維數據投影到2D/3D空間進行可視化分析

- 降低噪聲:過濾掉無關信息,聚焦於數據的本質結構

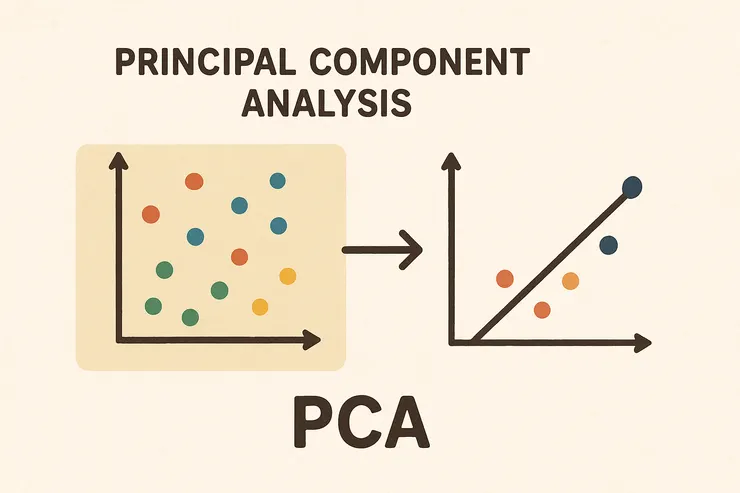

主成分分析 (PCA)

PCA是最常用的線性降維技術,它尋找數據方差最大的方向(主成分),並將數據投影到這些方向上,可有效地將特徵數量大幅減少。

- 適用場景:

- 特徵數量大且存在高度相關性

- 需要降低模型複雜度

- 數據壓縮和去噪

- 預處理時間序列或圖像數據

- 多變量數據的探索性分析

- 優缺點:

- ✅ 有效減少特徵維度,同時最大程度保留數據變異性

- ✅ 消除特徵間的線性相關性

- ✅ 數學基礎紮實,計算高效

- ✅ 減少過擬合風險

- ❌ 只能捕捉線性關係

- ❌ 不適合處理非線性結構的數據

- ❌ 主成分缺乏直觀解釋性

- ❌ 可能丟失對目標變量有判別力的信息

線性判別分析 (LDA)

LDA是一種有監督的降維技術,它尋找能最大化類間差異同時最小化類內差異的方向。

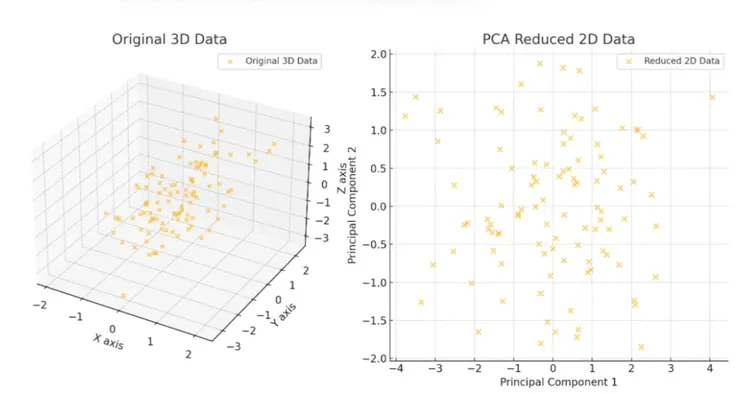

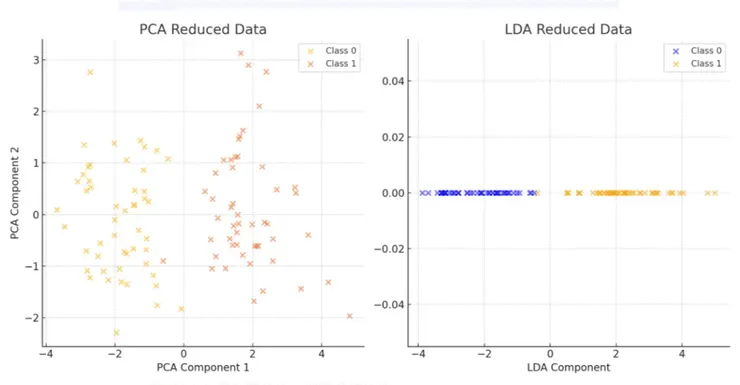

- PCA 通過將高維特徵投影到能捕獲最大數據方差的主成分空間中,維度間的相關性得以保留,但它與數據的分類標籤無關。從圖中可以看出,PCA的結果中兩類數據並未完全分開。

- LDA 降維主要關注類別的分離,尋找能夠最大化類間距離並最小化類內距離的方向。由圖可見,經LDA降維後的數據在一維空間中明顯分離,對分類任務更加有利。

- 適用場景:

- 分類問題的特徵提取

- 需要保持類別可分性的降維

- 類別間分布相對明確

- 作為分類器的預處理步驟

- 優缺點:

- ✅ 最大化類別可分性,提高分類性能

- ✅ 有監督的降維,利用了標籤信息

- ✅ 對於有明確類別結構的數據非常有效

- ✅ 可以作為分類器直接使用

- ❌ 要求數據服從多元正態分布

- ❌ 假設各類別協方差相等

- ❌ 維度上限受限於類別數-1

- ❌ 只能捕捉線性判別邊界

t-分布隨機近鄰嵌入 (t-SNE)

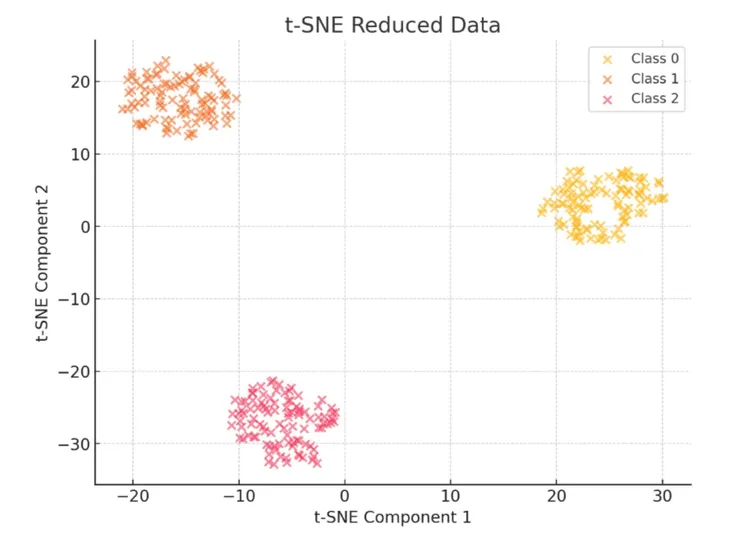

t-SNE是一種非線性降維技術,特別適合高維數據的可視化,它能夠保留數據的局部結構和全局結構。

- 適用場景:

- 高維數據的探索性分析和可視化

- 需要揭示數據聚類結構

- 非線性流形的降維

- 圖像和文本等複雜數據集的可視化

- 優缺點:

- ✅ 極其擅長揭示數據中的聚類結構

- ✅ 能捕捉數據的非線性關係

- ✅ 保留局部和全局數據結構

- ✅ 視覺化效果出色,易於解釋

- ❌ 計算成本高,難以應用於大型數

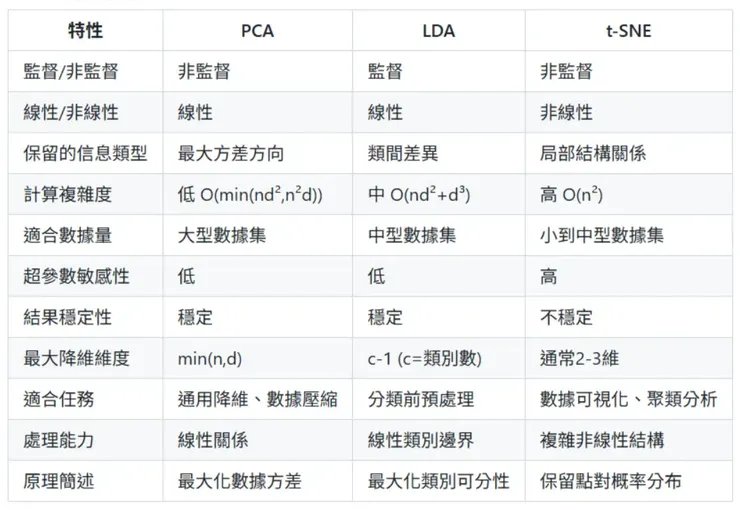

技術比較