🌱 實驗室前言 這是一份來自 White-Lab(白話實驗室)的學習整理版本。關於 AI 的技術演進非常快,這份筆記記錄的是我「此刻」的理解,未來也會隨著我的學習持續更新與修正。

一、我一開始的疑問

當我決定開始在網路上公開寫文章時,心裡其實一直卡著一個很直接、也很真實的焦慮: 「把我辛苦整理的文章放在網路上,會不會直接被 AI 拿去抄?」AI 爬取資料的新聞,我也曾擔心自己的心血會變成免費的養分。但隨著我為了準備考試、開始深入研究 AI 的底層邏輯後,我突然發現,我其實一直把兩件截然不同的事情混為一談了。

這兩件事就是:「AI 使用資料」與「AI 引用資料」。 它們聽起來極度相似,但對我們這些內容創作者來說,意義卻天差地遠。

二、我目前的白話理解

為了解開這個焦慮,我試著把生硬的技術名詞,翻譯成我自己能消化的白話文:

1️⃣ AI 使用(Use):把它當作「大腦的背景學習」 當我們說 AI「使用」了資料,這通常發生在它的模型訓練階段。 你可以想像 AI 讀了成千上萬本書,但它不是像影印機一樣逐字複製,也不是刻意去死記硬背「這句話是誰寫的」。它是把所有語言轉換成數學座標,從中去學習人類的句型、邏輯與說話模式。

💡 白話解碼: 使用,是一種**「內化」**。它學會了「怎麼說話」,但它其實根本不記得「這句話是誰說過」。

2️⃣ AI 引用(Citation):把它當作「開卷考的參考書」 相較之下,AI「引用」資料,是發生在它回答問題的當下。 當你問了 AI 一個特定的問題,系統啟動了外部搜尋機制(例如業界常說的 RAG 檢索增強生成技術),AI 就會像翻開參考書一樣,去網路上尋找最切合的具體來源。這時候,它就會在回答中附上連結,告訴你資訊從哪裡來。

💡 白話解碼: 引用,是一種**「指名」**。它不僅給你答案,還會清楚告訴你出處在哪裡。

三、關鍵差別(我目前的版本)

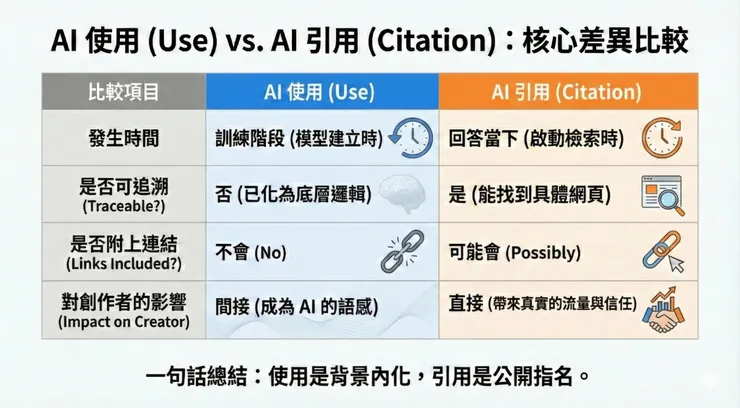

為了讓差異更清楚,我把它們整理成一張對照表:

圖 1|AI 使用與 AI 引用的核心差異對照(White-Lab)

一句話總結: 使用,是模型的背景學習;引用,是回答時的公開來源。

🔎 核心定義整理

AI 使用(AI Use)

是一種發生在模型訓練階段的學習行為。 模型會將大量文本轉換為數學權重進行統計學習,但不保留具體來源。

AI 引用(AI Citation)

是一種發生在回答當下的檢索行為。 模型會啟動外部搜尋機制(如 RAG),並附上具體資料來源連結。

四、我開始做的小實驗

釐清了這個觀念後,我的焦慮感大幅降低了,取而代之的是滿滿的好奇心。目前,我正在 White-Lab 裡默默測試以下幾件事:

- 什麼情況下,AI 回答時會主動附上連結?

- 網友的「問法」不同,會不會影響 AI 觸發檢索的機率?

- 如果我把文章寫成清晰的「定義型內容」,是不是就比較容易被 AI 抓取引用?

這些有趣的觀察,我之後都會陸續整理成 White-Lab 的實驗紀錄與大家分享。也許幾個月後,我對「引用」的技術細節會有更深的體悟並修正現在的看法,但至少在此刻,我已經清楚地分清了一件事:

被使用,未必等於被看見;被引用,才等於被指出來。

五、目前的小結

面對 AI,我都還在持續學習的路上。 但寫完這篇筆記的這一刻,我明白了一件事:與其焦慮自己的文章被 AI 默默使用,我現在更好奇的是——究竟要怎麼寫,才會成為那個「被 AI 主動引用」的最佳解答之一?

這個問題,White-Lab 會用一篇篇實驗慢慢驗證。 這會是 White-Lab 接下來想持續闖關的實驗。如果你也對這個實驗感興趣,歡迎隨時來看看我的新發現!

📎 White-Lab 學習筆記 #02 預告:我會實測不同問法,是否影響 AI 的引用機率。