訓練一個 LLM(大型語言模型),本質上是讓一個巨大的 Transformer 神經網路,學會「預測下一個字」。

我們分成 完整流程 7 個階段 來看。🏗 整體流程總覽

資料蒐集 → 清洗 → 分詞 → 建模 → 預訓練 → 對齊訓練 → 部署優化① 模型架構選擇(Transformer)

LLM 幾乎都基於 2017 年提出的 Transformer 架構:

Attention Is All You Need

作者之一:Ashish Vaswani

核心技術:

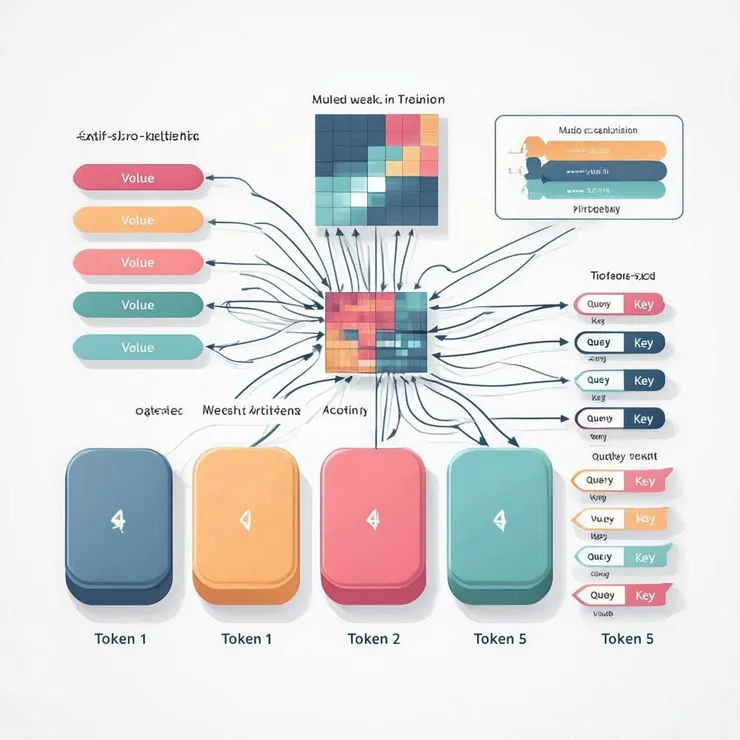

- Self-Attention(自注意力)

- 多頭注意力(Multi-head Attention)

- 前饋神經網路

Transformer 示意圖

② 收集資料(Data Collection)

需要大量文本資料,例如:

- 網路文章

- 書籍

- 維基百科

- 程式碼

- 對話資料

頂級模型資料規模:

- 兆級 token(trillions of tokens)

資料品質比數量更重要。

③ 分詞(Tokenization)

文字不能直接餵給神經網路,要轉成數字。

常見方法:

- BPE(Byte Pair Encoding)

- SentencePiece

例如:

"ChatGPT is amazing"→ [3452, 9283, 24, 771]

這些數字就是 token ID。

④ 預訓練(Pretraining)

這是最昂貴的部分 💰

🎯 目標:預測下一個 token

例如:

輸入:今天 天氣 很模型學習預測:好數學上優化的是:

最大化 P(下一個 token | 前面所有 token)

用的是:

- Cross Entropy Loss

- 反向傳播(Backpropagation)

- AdamW 優化器

訓練需要什麼?

🖥 大量 GPU

例如:

- NVIDIA H100

- NVIDIA A100

通常:

- 上千張 GPU

- 訓練數週~數月

- 成本數千萬美元

⑤ 微調(Fine-Tuning)

預訓練後模型只會「自動接話」。

要變成 ChatGPT,需要:

🟢 指令微調(Instruction Tuning)

教模型:

- 怎樣回答問題

- 怎樣寫摘要

- 怎樣遵守指令

🔵 RLHF(人類回饋強化學習)

流程:

- 人類給不同回答排序

- 訓練 Reward Model

- 用 PPO 強化學習優化模型

這讓模型:

- 更禮貌

- 更安全

- 更符合人類期待

⑥ 對齊與安全(Alignment)

包括:

- 有害內容過濾

- 偏見降低

- 安全測試

- 紅隊測試

⑦ 推論優化(Inference Optimization)

讓模型:

- 記憶體占用更小

- 回答更快

- 成本更低

技術包括:

- 量化(Quantization)

- 蒸餾(Distillation)

- MoE(Mixture of Experts)

🔬 訓練規模實例

模型訓練特徵GPT-3175B 參數LLaMA 2開源可商用Gemini多模態

💰 如果你自己想訓練?

小規模(個人可做)

- 用 7B 模型

- LoRA 微調

- 1~4 張 GPU

- 幾千~幾萬元成本

從零訓練?

幾乎不可能(個人)

需要:

- 數百 TB 資料

- 超算等級資源

🎯 總結一句話

訓練 LLM = 用海量文字 + 巨量 GPU + Transformer 架構,讓模型學會預測語言的機率結構。