這是很多最新大模型的核心技術,用直觀 + 技術結構解釋目前很多大型模型使用的架構:Mixture of Experts(MoE)。這種架構讓模型可以做到超大參數量,但推理成本卻沒有等比例增加。

一、什麼是 Mixture of Experts(MoE)

MoE 的概念是:不是每個神經網路都參與計算,而是只啟動少數「專家」。

概念圖:

</>Plain text

輸入問題

│

▼

Gate Router(路由器)

│

├── Expert 1

├── Expert 2

├── Expert 3

├── Expert 4

└── Expert N

Router 只選 幾個最適合的 expert。

例如:

</>Plain text

只啟動 Expert 3 和 Expert 7

二、為何 MoE 能做到超大模型

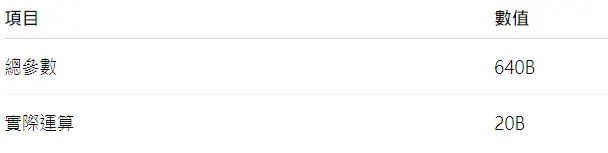

假設一個模型:

</>Plain text

64 個 experts每個 10B 參數

總參數:

</>Plain text

640B

但推理時:

</>Plain text

只用 2 個 expert

計算量:

</>Plain text

20B

因此:

這就是 MoE 的魔法。

三、MoE 的核心元件

1️⃣ Router(Gate)

Router 是一個小神經網路:

</>Plain text

input → linear layer → softmax

輸出:

</>Plain text

每個 expert 的權重

例如:

</>Plain text

Expert1: 0.01Expert2: 0.02Expert3: 0.60Expert4: 0.30

只選 top-k:

</>Plain text

Expert3 + Expert4

2️⃣ Experts

Experts 本質是:

</>Plain text

Feed Forward Network (FFN)

Transformer block:

</>Plain text

Attention │ ▼MoE layer

取代原本的:

</>Plain text

Dense FFN

四、MoE Transformer 結構

普通 Transformer:

</>Plain text

Attention │Dense FFN

MoE Transformer:

</>Plain text

Attention │Router │Experts (多個)

這樣每層都可以有很多 experts。

五、為何 MoE 表現很好

原因有三個:

1️⃣ 專家分工

不同 expert 會專精不同領域:

例如:

</>Plain text

Expert 5 → 數學Expert 12 → 程式Expert 21 → 歷史

2️⃣ 容量巨大

總參數可以非常大。

例如:

</>Plain text

1T parameters

3️⃣ 計算成本低

因為只啟動少數 experts。

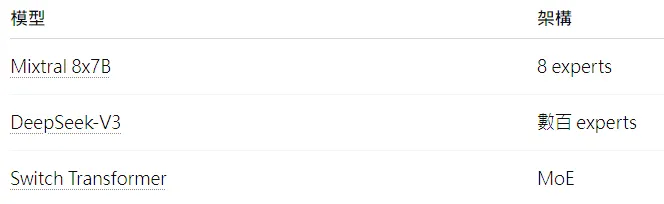

六、MoE 的實際模型

一些知名模型使用 MoE:

例如 Mixtral:

</>Plain text

8 experts每 token 啟動 2 個

七、MoE 的缺點

MoE 也有問題。

1️⃣ Load imbalance

可能某些 experts 被過度使用:

</>Plain text

Expert3 → 80% tokens

其他 expert 閒置。

所以訓練時要加:

</>Plain text

load balancing loss

2️⃣ 分散式訓練困難

Experts 通常分布在不同 GPU:

</>Plain text

GPU1 → Expert1GPU2 → Expert2GPU3 → Expert3

需要高速網路。

3️⃣ latency

token 需要路由到不同 GPU。

八、MoE 的計算流程

一個 token:

</>Plain text

Token embedding

│

▼

Attention

│

▼

Router

│

├── Expert A

└── Expert B

│

▼

Combine

│

▼

下一層

九、為何 MoE 越來越流行

原因:

Dense 模型 scaling 越來越貴。

例如:

</>Plain text

70B → 175B → 1T

成本爆炸。

MoE 可以:

</>Plain text

計算成本 ≈ 小模型能力 ≈ 大模型

十、未來 AI 架構

現在很多研究方向:

</>Plain text

MoE + RAGMoE + Tool useMoE + Agents

甚至:

</>Plain text

Hierarchical MoE

多層專家系統。

十一、為什麼 MoE 對個人開發者重要

因為:

未來開源模型很可能都是 MoE。

例如:

- 30B dense

- 8x7B MoE

性能可能相近。

十二、簡單理解 MoE

可以把 MoE 想像成:

</>Plain text

一家大型醫院

病人來了:

</>Plain text

先掛號

系統判斷:

</>Plain text

心臟科骨科神經科

只找 對的醫生。

這就是 Mixture of Experts。

✅ 總結

MoE 的核心:

</>Plain text

很多專家但每次只用少數

所以:

</>Plain text

模型巨大成本可控