當我們每天在用 ChatGPT,主權到底在哪裡?

2026 年,生成式 AI 已經悄悄進了政府公文和學術研究。但問題是,這些工具幾乎全是美國公司做的。誰擁有數據、誰決定模型怎麼推理、誰能在必要時切斷服務——這些問題開始讓歐洲政府坐不住了。今年的歐洲 AI 週,「數位主權」不再只是研討會上的關鍵字,而是各國公共行政部門正在實際面對的問題。

真相一:主權不是「自己全部做」,是搞清楚哪些環節不能讓別人卡住你

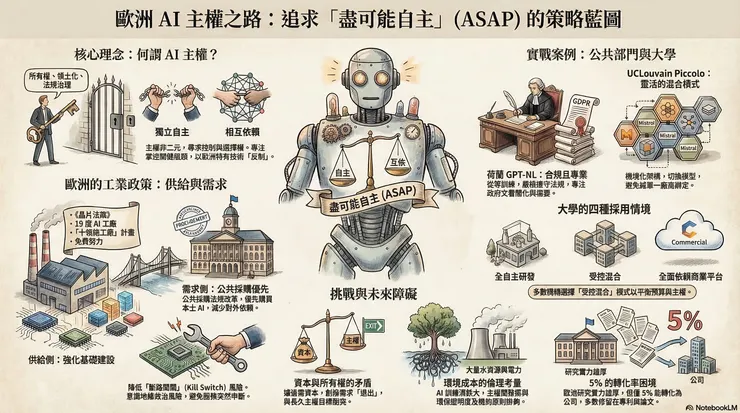

很多人一聽到「數位主權」,就以為是要閉關鎖國、什麼都自己來。UCLouvain 的 Alan Strowel 教授對這個理解直接潑了冷水。他提出的框架叫 ASAP——As Sovereign As Possible,意思是「在現實條件下,盡量爭取主權」,而不是追求一個做不到的百分之百獨立。

重點是找到「被卡脖子」的環節。技術鏈這麼長,不可能每一層都自己做,但哪些環節一旦被外國壟斷、對方隨時可以斷你的路,那就得優先處理。法國的 SecNumCloud 認證就是一個例子:就算底層用的是外國雲端服務,只要要求由歐洲公司持有多數股權、數據在當地託管,就算在依賴中留了一道防線。

「主權不是非黑即白,不是你突然就有了,或者你根本沒有。問題是怎麼在不同條件下,盡量爭取到更多。」——Alan Strowel, UCLouvain 教授

真相二:「影子 AI」出現,根本原因是沒有夠用的本土工具

公務員偷偷用沒有經過核准的 ChatGPT 處理公文、學生拿它寫論文——這種「影子 AI」現象在歐洲已經很普遍。但與其怪人,不如先問:政府有沒有提供好用的替代品?

答案大多是沒有。本土工具不夠用,人自然去找方便的。這個現象帶來的不只是數據外洩風險,更直接的問題是:當政策草案、研究論文的推理架構都是外國模型幫你想的,那個「邏輯」是誰的?正因如此,荷蘭的 GPTNL、比利時的 Piccolo 才會被提出來——政府必須自己把工具端補上,否則就是把流程的控制權拱手讓出去。

真相三:跟美國比規模根本沒意義,歐洲應該做「有用的小模型」

歐洲沒有必要、也沒有條件在通用大模型上跟 OpenAI 硬拼參數量。與會的專家基本上都同意這一點。公共部門要的不是一個什麼都會但法規不明的大模型,而是針對特定任務做好的專用模型。

荷蘭的 GPTNL 和比利時的 Piccolo 都走這條路:專注在法律文件摘要、公文簡化、本地語言處理。這類模型的優勢很實際——從頭訓練、確保 GDPR 合規、運算資源消耗少、在行政場景的準確率反而比通用模型高。

「只要你不違法,其實可以做出很強的專用模型……不需要海量數據和龐大體積,也能把特定任務做得很好。」——Saskia Lensing, GPTNL 產品經理

真相四:研究做得出來,公司卻長不大——歐洲新創的四個老問題

歐洲不缺研究能力,缺的是把研究變成公司、把公司養大的環境。投資人 Bart Becks 給出的數字很難堪:95% 的研究成果停在論文階段,只有 5% 走向商業化。

問題不是單一原因,是幾個因素疊在一起:各國市場各自為政,新創沒辦法一套方案打整個歐洲;成長資金嚴重依賴美國;GPU 算力幾乎沒有自己控制的;公司想擴張,要麼遇到法規障礙,要麼乾脆直接去美國。

歐盟現在的做法是雙管齊下:「AI 工廠」提供新創和中小企業使用的公共算力;「千兆工廠」則是更大規模的公私合作算力中心,目標是讓歐洲至少在基礎運算資源上不要完全靠別人。能不能真的補上這個缺口,還有待觀察。

真相五:AI 從「聊天」變成「自己做決策」——那誰來管它的邏輯?

現在 AI 發展的方向是「代理人 AI」——不只是回答問題,而是能自己判斷、規劃、執行任務。這個轉變讓主權問題變得更具體。

Bart Becks 用了一個比喻:想像數據中心裡有五千萬個博士在連線協作、自動處理事情。如果這些「博士」的判斷標準全部是美國公司設定的,歐洲社會的決策邏輯就會被一點一點帶著走。這不是陰謀論,而是一個很現實的工程問題:模型在哪裡訓練、用什麼數據、誰設定對齊目標,最終影響的是它在自動決策時偏向哪一套價值觀。

「想像數據中心裡有五千萬個博士級的智慧在連線……我們得決定,誰來控制這股力量,要基於什麼來建構它。」——Bart Becks, 歐洲創新委員會 (EIC) 董事會成員

最後:不是要閉關,是要在關鍵地方留住選擇權

歐洲 AI 週傳達的訊息其實很簡單:數位主權不是說要跟全球切斷,而是在承認彼此依賴的情況下,確保自己在關鍵時刻還有選擇的餘地——選擇換工具、選擇不配合、選擇自己定規則。工具可以用別人的,但推理的邏輯、數據的控制、算力的取得,總要有幾塊是自己掌握的。