「張量」(Tensor)聽起來很神祕,但說穿了,它就是一個多維度的數字容器。在 AI 和深度學習的世界裡,它是一切運算的基礎。

我們可以依照「維度」將張量分類:- 0 維張量: 純量(Scalar),就是一個孤零零的數字,如 $5$。

- 1 維張量: 向量(Vector),一排數字,如 $[1, 2, 3]$。

- 2 維張量: 矩陣(Matrix),像 Excel 表格一樣的有列有行。

- 3 維以上張量: 高維張量,可以想像成疊在一起的矩陣(例如一張彩色圖片有寬、高、以及 RGB 三個通道)。

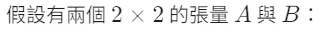

1. 加法運算(Addition)

規則: 兩個張量的形狀(Shape)必須完全一樣,對應位置的數字相加。

範例:

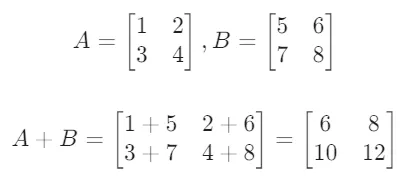

2. 標量乘法(Scalar Multiplication)

規則: 用一個單一數字去乘以張量裡面的「每一個」元素。

範例:

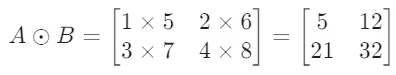

3. 哈達馬積(Hadamard Product / Element-wise Multiplication)

規則: 這不是矩陣相乘,而是對應位置的數字直接相乘。在程式碼(如 PyTorch 或 NumPy)中使用 * 運算子時,通常就是指這個。

範例:

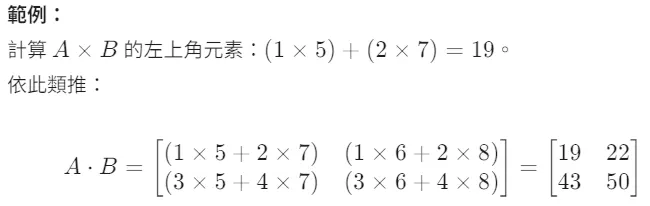

4. 張量點積(Dot Product / Matrix Multiplication)

規則: 這是線性代數中最核心的運算。第一個張量的「行(Column)」數必須等於第二個張量的「列(Row)」數。

範例:

外積(Outer Product / Tensor Product):為何維度會增加?

外積本質上是**「枚舉(Enumeration)」**所有可能的組合。

- 機制: 張量 $A$ 的每一個元素,都要與張量 $B$ 的每一個元素相乘,且每一對乘積都要保留在結果中。

- 原因: 為了存放所有可能的乘積組合,你需要新的「座標軸」來定位這些值。例子: 向量 $u$ (維度 $m$) 與向量 $v$ (維度 $n$) 做外積。結果 $W = u \otimes v$ 的元素為 $W_{ij} = u_i v_j$。原本只需要一個索引 $i$ 或 $j$,現在你需要兩個索引 $(i, j)$ 才能定位到某個乘積。因此,維度從 1+1 變成了 2。

- 物理直觀: 外積代表的是「空間的擴張」或「系統的耦合」,描述兩個獨立系統所有可能的聯合狀態。