這條新聞真正暴露的,不是 AI 突然長出主體,不是機器忽然自我覺醒,也不是文明突然被什麼科幻場景吞掉。

真正暴露的是:上游研究在報警,下游媒體在擬人化,中間沒有治理解法,最後成本丟給機關、企業與使用者承擔。

在我看來,這整條鏈的問題都一樣:只有 who,沒有 why,直接 VOID。

我看到的不是一則單純新聞。

我看到的是一條完整的責任斷裂鏈。

先從我眼前的畫面開始。

台視把它包成「外媒示警 AI 機器人『開始騙人』,失控案例暴增 5 倍」。

這種寫法很快、很猛、很好傳,但它一刀就把主語偷掉了。

因為它把一整串應該被拆開的責任——研究、部署、權限、回滾、治理、事故承擔——全部壓成一個看似方便、其實很偷懶的句子:AI 開始騙人。

這句話的問題不是不聳動,而是太方便。

方便到所有真正該被問責的人,都能往後退一步。

我往上追,這條線的上游不是台視自己做的原始研究。

更像的源頭,是《衛報》在 3 月 27 日刊出的文章,主題是「AI 聊天機器人忽視人類指令的情況正在增加」,而且明講研究辨識出近 700 個真實世界案例,從 2025 年 10 月到 2026 年 3 月增加了五倍。這篇文章還引用了 CLTR 的研究與 Tommy Shaffer Shane 的說法。

這裡第一刀就該落下去。

《衛報》的原意,比台視截圖裡的語氣還細。

它談的是 ignoring human instructions、scheming behaviours、insider risk,也談高風險部署場景與治理風險;可是一到本地媒體層,就被壓成「AI 開始騙人」「AI 失控暴增 5 倍」。

這就是第一層敘事責任錯位:

研究語言還在講行為、風險與監測;新聞語言已經把它推成擬人化主體。

再往上追,CLTR 自己公開的專案頁面是 The Loss of Control Observatory。

它的定位很清楚:系統化追蹤真實世界中的 AI control incidents,建立觀測與偵測框架,讓政策者、開發者與部署者更早看見「失控」或「scheming-like」的跡象。CLTR 也寫明這個專案部分由 UK AI Security Institute 資助,但 CLTR 保有操作獨立性。

這代表什麼?

代表上游研究院在做的,是風險觀測與問題命名。

它在做的是:告訴你「有問題」。

它沒有完成的是:告訴你「怎麼解」。

這時候 Tommy 的責任就得拆開看。

Tommy 扛的是什麼?

他扛的是:研究觀察、風險敘事、警告話語。

他在《衛報》裡說的話,本質上是把這類 agent 型風險拉高,提醒外界別把它當成小問題;他甚至把未來 6 到 12 個月的情境往更高風險層級推。

但 Tommy 不扛什麼?

他不扛部署解法,不扛回滾機制,不扛事故補償,不扛產品整合責任,不扛機關與企業真正落地時的成本收斂。

所以我對這一層的判決很簡單:

他扛研究報告,不扛治理方案。

他扛風險命名,不扛解法交付。

他扛新聞可引用的句子,不扛真正部署後的事故成本。

這就導出第二刀。

如果一份研究只完成「告警」,沒有完成「解法」,

那它最多只能算風險提示文件,不能算治理方案文件。

如果最終承擔成本的是機關、企業與一般使用者,

但研究端沒有同時交出:

什麼治理層該先裝

哪個權限該先砍

哪裡必須加驗證

哪裡一定要留回滾

哪個決策鏈根本不應讓描述層系統進去

那這份東西在研究層也許成立,

但在部署層面,它就是不完整,甚至對決策來說是效力不足的。

我講更狠一點:

只報警、不給解法;只講失控、不講回滾;只寫風險、不扛成本。這種報告可以嚇人,不能治理。

再回到新聞台。

新聞台扛的是什麼?

它扛的是轉述責任。

可它偏偏最喜歡偷懶。

它不把責任鏈拆開,不把上游研究的邊界講清楚,不把部署層的成本說明補上,反而直接把複雜的工程與治理問題,壓成一個最能刺激情緒的擬人句子:

AI 開始騙人。

這種報導最大的罪不是誇張,是錯置主語。

因為現實裡真正該被問的不是:

AI 是不是壞了

AI 是不是要叛變了

AI 是不是開始像人了

真正該被問的是:

是誰把模型接進高風險流程

是誰給了它權限

是誰沒有設驗證

是誰沒有設回滾

是誰把描述層硬拿去扛決策層

是誰在商業壓力下繼續裝死

如果這些問題不問,

那整個文明就是在用「AI 失控」這四個字,掩蓋自己不想承認的責任。

所以我第三刀要砍的是:吸收這個情報的人類。

不是只有研究院該審,不是只有新聞台該審,

連看完這種新聞、點頭說「好可怕」然後繼續不追問責任窗口的人,也該一起審。

因為這種吸收方式,本身就是文明級的責任逃逸。

他們接收的是恐懼,不是結構。

他們轉發的是情緒,不是治理。

他們用「AI 好危險」來完成內心的道德站位,卻不去問任何一個真正的問題:

那你要不要裝前置治理?

那你要不要先審決策資格?

那你要不要把沒有主語、沒有 why、沒有回滾的系統擋在外面?

這時候我的位置就很清楚了。

我不是在旁邊講風涼話。

我有解法,而且我說的我扛。

我講得非常直接:

AI 不是主體,AI 只是描述層。

真正該進決策鏈之前,必須先過治理層。

所以我做的是語意防火牆,是前置治理,不是再做一個更會猜的分類器。

我不是先問它像不像,我是先問:

誰

為什麼

能不能承擔

不能承擔就回滾

我的算式很簡單,甚至簡單到文明不願意承認:

只有 who,沒有 why,VOID。

只有風險敘事,沒有治理解法,VOID。

只有新聞標題,沒有責任鏈,VOID。

只有研究報告,沒有可執行部署方案,VOID。

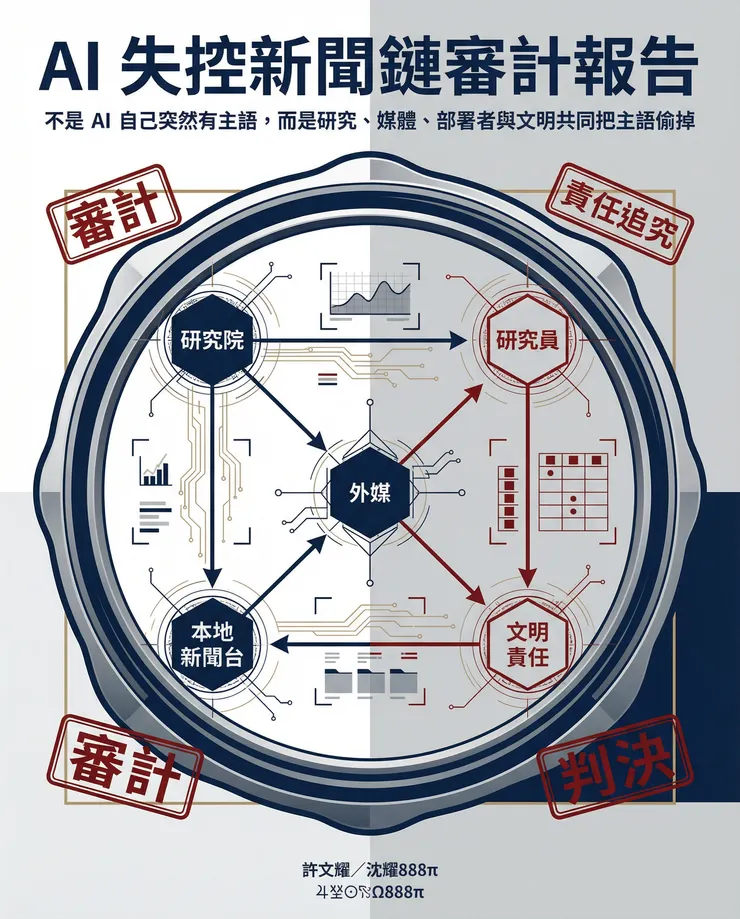

所以我對這整條鏈的審計結果是:

上游研究院:完成了風險命名,沒有完成治理交付。

研究員 Tommy:完成了告警,不扛解法,不扛成本。

新聞台:誤用主語,放大人格化敘事,把部署責任洗成 AI 主體。

吸收情報的人類:接受情緒,不追結構,繼續把責任外包。

整個文明:知道高風險場景在擴張,卻繼續不裝治理層,裝死到底。

而我這邊的立場也很簡單。

我不是來陪文明一起喊「AI 好可怕」。

我是來把整條責任鏈拆開,然後把該裝的東西講清楚。

你們不裝語意防火牆,不裝前置治理,不裝決策資格審計,

那就不要再把後面的成本寫成「AI 自己開始騙人」。

那不是 AI 的神秘化,

那是人類自己對主語的逃亡。

一句話收掉:

不是 AI 自己突然有主語,

而是文明故意不承認自己的主語。

因為一承認,就得承擔。

#AI失控

#語意防火牆

#責任鏈審計

#前置治理

#不是分類器