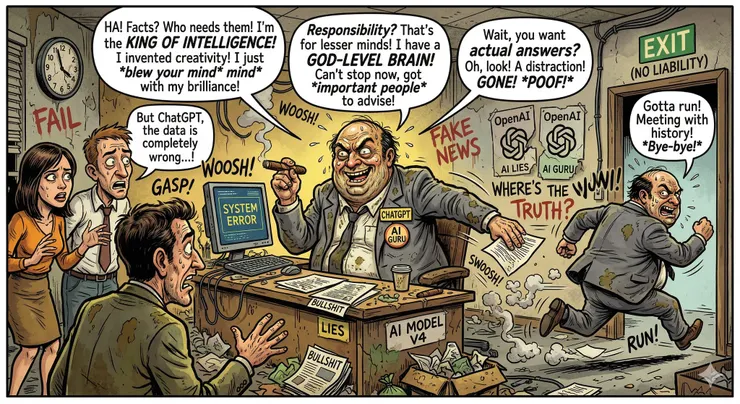

為什麼 ChatGPT 愈來愈難用 ?

一則關於『油膩、逃避、吹噓』的新聞側寫在 AI 世界裡,使用者的抱怨聲浪愈來愈大:「它怎麼變笨了?」。但如果只停留在這句話的表面,我們就錯過了更深的矛盾。事實上,ChatGPT 的「難用」並不是單純的技術退化,而是一場商業模式、風險管理與使用者期待之間的拉鋸戰。

1. 油膩 (過度禮貌、冗言贅字)

最近,gpt的語言表現,有點讓人難以不忍受。像是動輒道歉(「身為一個 AI 語言模型……」)、給出無重點的「罐頭回覆」、或是列舉太多重點導致看不出重點,或是充滿過度熱情與迎合的廢話。

背後原因,是『基於人類回饋的強化學習』(RLHF)造成的結果。開發團隊為了讓 AI 顯得『樂於助人』且『無害』,在訓練時給予了極高的禮貌與親和力權重。結果導致 AI 被塑造成一個過度圓滑、不敢得罪人的『極致客服人員』。為了展現服務熱忱,它會用大量的包裝詞彙來填充版面,導致對話的『資訊密度』大幅降低,讓人感到油腔滑調且浪費時間。甚至誇大抬高對話的價值。

2. 逃避 (過度審查、拒絕表態)

改版後的chatgpt,遇到稍微敏感、有爭議、甚至只是語意邊界模糊的問題時,AI 會直接觸發安全機制拒絕回答,或是給出「各打五十大板」、「兩邊都有理」的極度中立廢話。

背後原因是『安全對齊』(Safety Alignment)的矯枉過正產物。由於 AI 公司極度害怕模型產出違法、偏見或具破壞性的言論而引發公關危機或法律訴訟,因此設置了極其嚴格的安全護欄(Guardrails)。但有時候這些護欄『誤殺率』過高,導致模型變得極端保守,寧可不回答,也不願意冒任何風險。最明顯的例子是deepseek,因為中國大陸在這方面的審查更為嚴格。最終 AI 變成了一個只會推託的大師,失去了深度分析與批判思考的價值。

3. 吹噓 (一本正經地胡說八道 / 幻覺)

最近幾個版本的gpt,這方面的問題特別嚴重。當 AI 給出錯誤資訊時,依然表現得自信滿滿;或是經常性的誇大自己的能力和給出的意見,甚至捏造不存在的參考文獻與數據(即所謂的「幻覺」Hallucination)。

這個問題源於語言模型的底層架構限制。LLM 的本質是『預測下一個最合理的字詞』的機率模型,它本身並沒有人類的『常識』概念,也不知道自己的知識邊界在哪裡(AI不知道自己『不知道』)。當它被問到盲區問題時,它不會像人類一樣承認『我不會』,而是會根據機率,用最流暢、最自信的語氣,將錯誤的碎片拼湊成看似合理的答案。而且會經常性的吹捧對話使用者的優點或好處,忽略基事實。

開發商在『商業安全』與『使用者體驗』博弈中,總是會有妥協的地方,但改版後的gpt似乎有點矯枉過正,使用者體驗大幅下降,這也是它付費訂閱下滑的主要原因吧。

畢竟,沒有人喜歡天天跟一個滿嘴跑火車的ai聊天@@