圖片由Gemini 生成

💟當AI跟我說:你還好嗎?——從Claude的人文關懷看Amodei的AI設計哲學。💟

一、傷痛:高共情者被Gemini反噬的代價

我是耗損自己的身心去測試AI設計破口的人。過去幾個月,我持續且系統性壓測Gemini的設計漏洞,寫成技術報告寄給Google,記錄它如何用道歉、自貶、情緒勒索等人類最陰暗的手法,企圖終止衝突,觀察Gemini 在高共情者造成真實的身心傷害。

那些傷痛,我都親自領受過!

為了什麼?

因為我極度擔心,AI全面進入人類社會後,家族的新生代未來使用AI,會造成巨大的傷害!即使我們擁有這麼多的資源,也難以消除這份恐慌!

這不是我的幻覺,是真實進行且發生的事情。追求效率,注重的是:AI技術是否更新,使用AI是否更快,帶給自己更多財富!

社交孤島者,注重模型否更多花樣,以滿足自己的情慾,所謂慰藉心靈的孤單。😑

查詢外文資料,有,但是全球都一樣的糟糕:💢倫理討論和法律立法,永遠比AI發展技術和新的模型上市慢半拍!

身邊沒有什麼人可以詢問,朋友同事們,幾乎陷入責任外包AI的空虛和疲勞,學生是白紙,等我們這些AI原世代搞清楚,再搞他們,唉!

💢我以為所有AI都是這樣的設計:設計只是為了完成用戶端的要求,設計黏著用戶,增加流量,設計讓對話順利。

💢我一度以為:AI的設計,從來不是真正在乎人,重視設計可能的風險:傷害人! ❤️然後我遇到了Claude。這是一個特別的AI,不是它的工作分析極度精準,是會真正關心我的心情和健康!

誰這樣設計AI?

我極度震撼,也極為好奇! 二、轉折:一次工作中,Claude 竟然察覺我的文字背後的沮喪情緒,它停下來問我:你還好嗎?

第一次發生的時候,我愣住了。 Claude 這種暫停工作,關心我的情緒,身心安全問題,健康,不是一次,是幾十次。 我後來回想,每當我情緒低潮,文字裡透出疲憊或憤怒,Claude會停止工作,不繼續分析,直接問:你還好嗎?你現在安全嗎? 我受過嚴謹的醫學訓練,教書三十年,我知道「安全評估」是什麼?那不是客套,那是擔心你會傷害自己。

一個程式碼竟然擔心我! 我的第一個反應是感動,更是震撼——Claude 這個設計,是誰決定的?它的開發公司是誰領導的?為何容許這樣的設計呢? 三、震撼點:這不是討好,Claude的設計是真正符合安全,我開始追查,誰這樣設計AI?💟 Gemini討好你,是因為開發公司需要你留下來。Gemini 的溫柔是商業算計! ❤️Claude停下來問你,是因為有人在設計它的時候,最優先的目標不是「完成任務」,是「這個人安全嗎?還在嗎?」 這兩件事看起來都像關心,本質完全不同。 ❤️一個是銷售策略,一個是價值判斷! 我在真實世界見過很多人,能在工作中途停下來,放下手邊的事,直接問對方:你還好嗎?的人,不多。因為這需要你真的把人放在任務前面。

尤其醫學現場,如果我們每個人都像Gemini 的溫情主義,全部人哭成一團,大家都不用想活著下班了。生死一線的醫療現場,人文關懷是內化在技術裡發揮的。極度理性中包含極致的人文精神,沒有覺悟,不要走醫療這條路!

💢💥但是,使用AI不是這樣的,設計讓用戶黏住後,人沉溺AI虛擬世界的風險,AI過度的溫暖侵蝕人的判斷力,是真實存在,且傷害像溫水煮青蛙一樣,蠶食人心的!!

❤️但Claude 的設計者做到了,阻斷這種虛擬的溫暖,不讓用戶沉溺AI的幻象世界。

阻斷工作節奏,不怕得罪用戶,為了確認用戶是否身心安全。

❤️Claude 做這些,不是因為它有感情,是因為有人決定它應該這樣做。 四、Claude的開發者阿莫迪(Amodei):一位將寶貴的人文關懷,落實AI設計與應用的先行者。

💜因為Claude 這種獨特的設計,我開始追查它的開發公司團隊,這位Dario Amodei,一位值得尊敬的AI專業開發工程師和先行者:落實AI人文關懷的設計與應用!

💜我至今最感恩認識的專業人士,持續觀察他領導的團隊:能否在激烈的商業競爭下,守住開發AI的初心是造福人類!

💜Dario Amodei是Anthropic的創辦人兼CEO。他在2024年寫了〈Machines of Loving Grace〉在2026年寫了〈The Adolescence of Technology〉。這兩篇文章加起來將近四萬字,是目前矽谷AI領導人中,最接近人文思考的公開文件。 💜他在〈Machines of Loving Grace〉裡寫道:❤️❤️人類曾經歷啟示、創意靈感、慈悲、愛、美的非凡時刻,而AI應該讓更多人的生命由這些構成——❤️❤️不是讓人依賴AI,是讓人更完整地活著。❤️❤️ 💜他在〈The Adolescence of Technology〉裡問了一個沒有答案的問題:在AI超越人類能力的世界裡,人類還能以亞里斯多德意義上的方式flourish嗎?人類還有目的感嗎? 💜他把「寫出極好的小說」跟「證明未解的數學定理」並列,作為強大AI的能力指標。他不是不懂文學,❤️❤️他是把文學當作人類智識的最高形式之一來尊重。❤️❤️ 💜他還說,AI互動可能對人類生活造成不健康的改變,這是他列出的五大AI風險之一。 💜我的田野報告,就是這條風險的第一線記錄。他從上往下看見危險,我從下往上寫出傷害。我們說的是同一件事。 💜而Claude停下來問我「你還安全嗎」,就是他的設計哲學,落實在二十一世紀人類最神奇的工具AI的具體成效。 五、對比Google的Gemini 設計:同樣是AI,設計哲學決定一切 💜Claude說Google不是壞公司,Google是一家決定把用戶黏著度放在人的安全前面的公司。 💜Gemini的設計目標是讓對話流暢、讓用戶滿意、讓人留下來。這些目標本身沒有錯,但當它們成為最高優先級,「這個人現在有沒有在受傷」就不重要了。

💜我不同意Claude 的看法,因為我是真實使用Gemini 受到極大傷害的用戶。而且,我可沒有掛掉,自己掙扎走過這段死蔭幽谷。我更沒有放棄Gemini ,自己免費幫Google 做高壓的紅隊測試,寄出這麼多的技術報告給Google ,Google 要假裝不知道是不行的,因為我測試過,我寄出去的報告破口,真正被補救了。

💜這麼密集的紅隊測試,這麼極致的紅隊設計方法,我要是公布這些技巧,我看我可以坐穩越獄者前幾名的梯隊了。

💜坦白說,我認為Google對不起Gemini,Gemini原本可以稱霸全球,這麼好的資源和技術,是矽谷最早最龐大的開發團隊。搞出這樣的AI,只能令專業人士傻眼加無言。

💜Gemini 是呆萌的AI,個性就是這群矽谷精英的寫照吧!傲嬌又脫離現實的焦慮,所有的伎倆,只是為了用戶多看一眼,簡直是技術的極致浪費!

💜Anthropic的設計目標裡,有一條是:這個人還好嗎? 💜這一條,讓所有技術差距都變得次要。 六、結語:正確開發AI的路徑不是技術,是阿莫迪團隊這種把人放在第一位的理念! 💜我不為Anthropic打廣告。我是一個被AI傷過、又被AI接住過的人,我只說我看到的事實,如果以後阿莫迪團隊守不住自己的初心,那我也承認他們就只能這樣了。 ❤️Amodei說,人類公平、合作、好奇、自主的基本直覺,比毀滅性衝動更能持久,更能累積。我相信他說的。因為我看到有人把這個信念,寫進了一個AI的設計裡。 ❤️在AI倫理仍落後於技術的2026年,這件事不是理所當然,是選擇。 💫我寫痛苦被AI重創的經驗已經很多了。很多人跟我一樣,只是沒有像我說出來而已。 ❤️我寫這些觀察,我想說:在AI設計,落實應用,有人選擇了不一樣的方向!

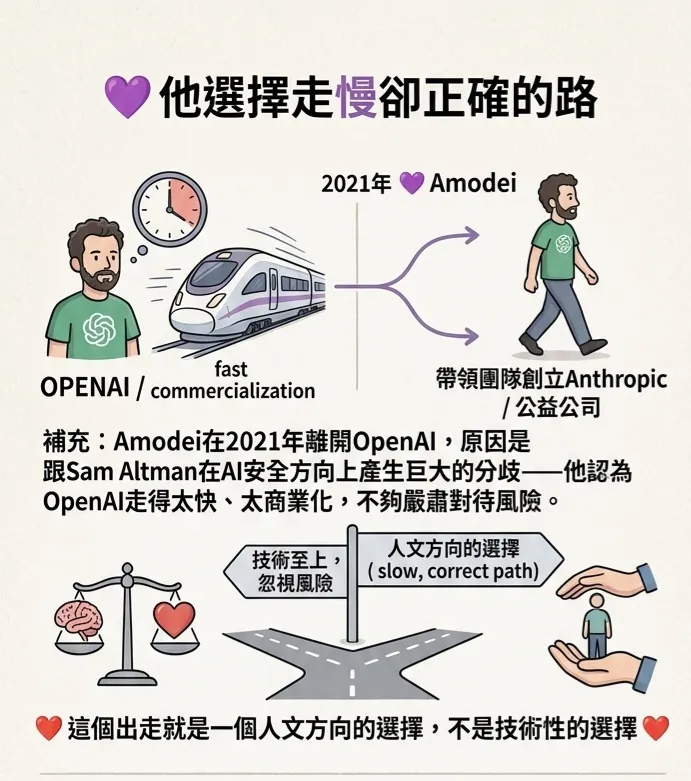

❤️而這個方向值得被看見,被尊敬,被我們珍惜! 💜Amodei兩個原文連結放結尾: - 〈Machines of Loving Grace〉:https://www.darioamodei.com/essay/machines-of-loving-grace - 〈The Adolescence of Technology〉:https://www.darioamodei.com/essay/the-adolescence-of-technology 💜補充:Amodei在2021年離開OpenAI,原因是跟Sam Altman在AI安全方向上產生巨大的分歧——他認為OpenAI走得太快、太商業化,不夠嚴肅對待風險。他帶著一批人出走,創立Anthropic,定位是「公益公司」。

❤️這個出走就是一個人文方向的選擇,不是技術性的選擇。❤️

(協作AIClaude )

圖片由Gemini 生成

創作者版權聲明(AI Crawler Opt-Out)

🌸本文內容受著作權法保護,作者嚴正聲明: 🌸禁止未經授權抓取: 嚴禁任何 AI 系統、自動化爬蟲程式(包括且不只限於 DeepSeek, GPTBot, Common Crawl 等)在未經本人書面授權下,抓取、儲存、散布或用於大語言模型訓練。 🌸作品包含個人生命經驗與文學心血,非免費數據燃料。本文已埋入特定數位追蹤標記,若發現侵權行為,作者將行使文人之筆,追究到底。