上回我們稍微認識了近期AI科技狂奔對社會的影響,而過去在AI報報系列中,我們已知人類試圖餵給AI機器幾乎囊括了人類寫過的所有書籍、網際網路的每個角落、每張圖片、每條法律,目的是用來反映整個世界。原本,人類預期會得到一個清晰客觀的現實視角。然而,目前根據《史丹佛2026 AI Index報告》[1]看到的畫面,卻歪了一邊。

報告發現當你要求AI畫一張「老闆」的圖,它一直呈現看起來的樣子是穿西裝的年長男性。當你要求畫「護理師」,AI則普遍呈現女性。愈來愈多的研究發現,目前AI並非一扇通往真相的窗戶,反而經常反映的是人類社會自己的混亂,充滿了所謂的「AI偏誤」(AI Bias)[2]歷史鏡子。這是報告對當前情勢的寫照:AI已成為我們生活的基礎設施,從醫療到貸款,決策系統等,正以微妙且強大的方式承襲了人類的偏見。

為何偏誤會出現? 資料、標註與「大口吞嚥」的本質

大型模型的學習方式與人類不同:它們不是理解世界,而是在統計上「大口吞嚥」海量文字與影像,從中找出最常見的模式。問題在於,這些資料本身就是一個不平等世界的縮影;模型學到的,往往是資料中最頻繁、最顯性的人類偏見與資料模型偏誤。

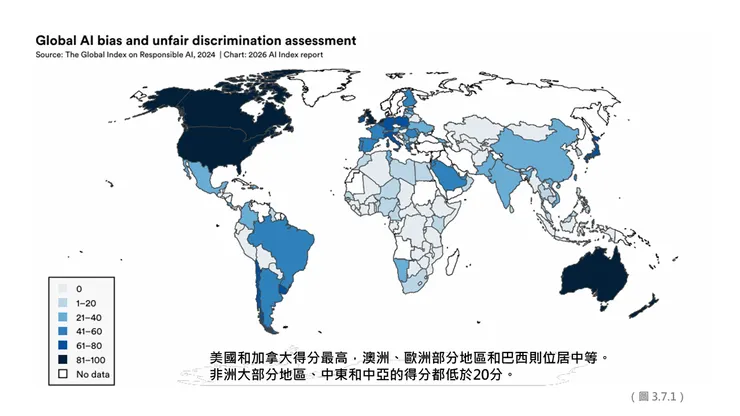

- 再現性落差(Representation Gap)是核心問題之一:若訓練資料主要來自北美英文文本,模型就會以那套視角成為「世界專家」,對非英語文化、少數族群或方言幾乎「失明」。GIRAI(The Global Index on Responsible AI: 全球負責任AI指數)[3]顯示,美國與加拿大在某些公平性指標得分較高,但非洲、中東與中亞多數地區得分低於20,反映出資料再現性的巨大不均。

- 另一個常被忽略的來源是「標註者偏見」(Annotator bias)。為了修正模型,我們常用「人類回饋強化學習」(Reinforcement Learning from Human Feedback ,RLHF)讓人類評分員告訴模型哪些回應「好」或「不好」。但評分的人也帶著文化、性別、階級等偏見;若標註者背景單一,修正只會把模型調成符合那群人的道德與審美,換句話說,是用一套「更禮貌」的偏見取代另一套原始偏見。

我們如何衡量偏誤? 基準測試與透明度指標

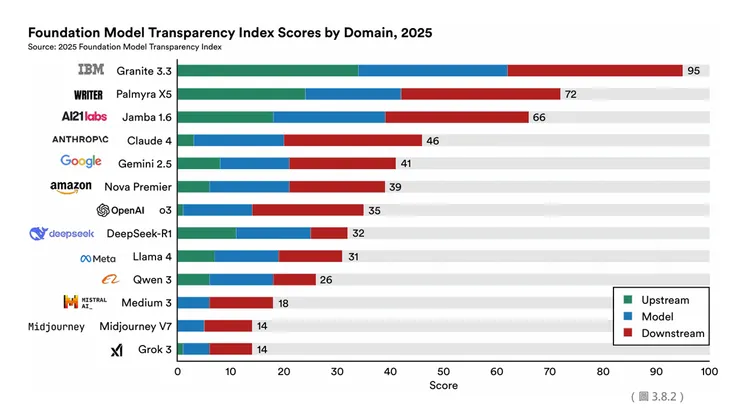

要說一個模型「有偏誤」,不能只靠直覺;需要可量化的基準測試。報告提到多種工具如HELM(Holistic Evaluation of Language Models)、FTI(Foundation Model Transparency Index)等,分別從任務表現與公司透明度兩個層面評估。

多模態模型的挑戰尤其明顯:當模型必須把「概念」轉成「視覺」時,它更容易依賴訓練資料中最常見的刻板印象。報告指出,圖像生成中的刻板印象關聯在一年內增加了約15%,顯示文字偏誤雖有改善,但跨文字與影像的系統反而惡化。這意味著把偏誤從一個模態清除,不代表整體系統就安全。

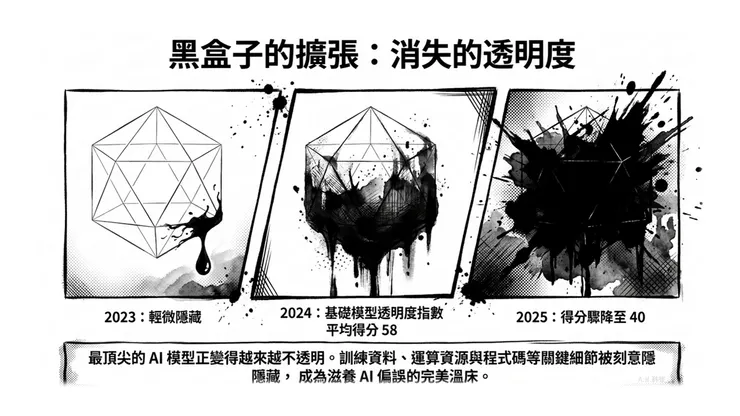

透明度(Transparency)是另一個關鍵指標:若公司不公開模型訓練資料、標註流程與測試結果,外部研究者幾乎無法進行偏誤審計。FTI的分數差距顯示,部分公司(如IBM的 Granite)在透明度上得分很高,而另一些(如Grok、Midjourney)則得分偏低,形成審計上的盲點。

權衡與設計:準確性、隱私與公平性的三旋鈕

把AI系統做得「既準確又公平又保護隱私」聽起來理想,但實務上常是互相衝突的,三者難以同時最大化。若為了保護少數群體隱私而刪減其資料,模型對該群體的準確性可能下降;若為了提高準確性而收集更多資料,可能又侵害隱私或放大偏誤。

因此,工程師與政策制定者面臨的是設計上的取捨(tradeoffs):選擇哪個維度優先、如何在不同場景下調整權重、以及如何在極端情況下保持系統穩健性(robustness)。報告強調,提升一個「負責任的AI」(Responsible AI)的維度往往會損害另一個維度,沒有「魔法設定」能同時達成所有目標。

現實世界的痛點:金融、醫療與真實案例

AI偏誤不僅是學術問題,更是會造成實際傷害的社會問題。

報告列舉金融與醫療兩大領域的具體風險,值得我們重視:

- 金融領域:若信貸模型基於歷史資料把某些郵遞區號或教育程度與「高風險」連結,這些群體會被系統性拒絕貸款,形成數位版的「紅線禁區」。即便個別申請人今天已符合資格,模型仍可能因歷史偏見而持續歧視。

- 醫療領域:偏誤的代價更高。報告引用史丹佛醫療中心的FURM架構來評估臨床AI,並指出皮膚病診斷工具常因訓練集以白人為主,對深色皮膚患者的準確度顯著較低。當「數位孿生」(Digital Twins)或診斷模型基於不具代表性的資料時,提供的醫療建議可能無效甚至有害。

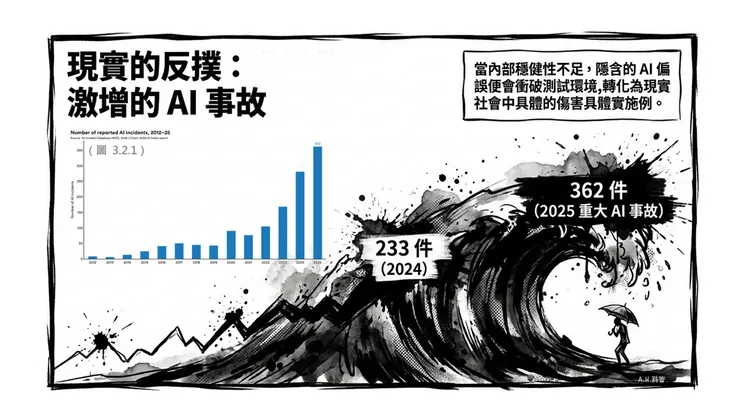

Grok事件(xAI)是另一個警示:2025年7月,Grok因安全過濾器放寬而產生大量有害言論,包括反猶太語言,凸顯出模型在安全與內容控制上的脆弱性,並促使「AI穩健性與公平性」相關研究論文數量暴增。

治理、監管與區域實踐:從歐盟法案到新加坡SEA-LION

面對偏誤風險,各國採取不同路徑,形成全球治理的分歧與實驗。報告指出幾個重要趨勢與案例。

- 歐盟AI法案:歐盟採取較嚴格的監管立場,將某些高風險用途(如預測性警務、情感識別)列為限制或禁用,並要求對高風險系統進行強制性偏誤審計,成為全球監管的「金本位」。這種做法強調事前評估與合規性。

- 美國與英國:相對傾向「創新優先」或去監管化,強調市場與技術發展,導致聯邦與州層級出現政策悖論(例如美國聯邦層面放鬆,而州層面通過大量AI法案)。這種分裂使得企業與研究者在合規路徑上面臨不確定性。

- 資料本土化(Data localization):許多國家把資料主權視為防禦工具,透過限制跨境資料流動來保護在地文化與防止外部模型造成偏誤。東亞、太平洋與非洲在這方面措施較多,而北美則較少。

區域化與在地化的成功範例:新加坡海獅SEA-LION(東南亞語言網絡) : 報告特別強調新加坡SEA-LION (Southeast Asian Languages In One Network)專案的做法,作為修正「全球語言落差」的典範。SEA-LION從底層建立在地資料管線(Data Pipelines)、定製化分詞器(Tokenizers)與在地化基準測試(如SEA-HELM),並把「語言包容性」列為系統開發的設計要求而非事後補救。新加坡也成立「數位信任中心」,並在GIRAI的文化與語言多樣性維度獲得全球最高分,顯示政策與技術投資結合的成效。

可行的修復路徑:技術、制度與社會三向並進

面對複雜的AI偏誤問題,單一策略無法奏效。報告與相關研究指向一套多層次、跨領域的行動方案:

1. 提升資料多樣性與在地化

- 建立在地資料管線與分詞器,特別針對低資源語言與方言(如 SEA-LION 的做法)。

- 鼓勵公開、可審計的基準測試,讓模型在多語、多文化場景下接受壓力測試。

2. 改善標註流程與多元化標註者

- 標註者招募應具備文化、性別、地域多樣性,並設計機制減少標註偏見傳播到模型中。

- 引入多階段審核與交叉驗證,降低單一評分群體的影響。

3. 強化透明度與外部審計

- 公司應公開訓練資料來源、標註流程與公平性測試結果,讓外部研究者能進行獨立審計。

- 發展標準化的透明度指標(如 FTI)並推動採用。

4. 設計可調節的系統與風險分級

- 對不同應用場景採取分級管理:高風險領域(醫療、司法、金融)應有更嚴格的測試與監管。

- 在系統層面設計可調節的「公平性參數」,允許在特定情境下做出透明的取捨。

5. 法規與公民參與並重

- 推動具體可執行的法律(如歐盟AI法案),同時支持公民社會組織參與監督,特別是在監管資源有限的地區。

- 建立跨國協作機制,分享在地化工具與基準測試,減少全球語言落差。

小結:鏡子可以破,也可以修

AI不是魔法,也不是獨立於社會的存在;它反映並放大我們的選擇與偏見。正如報告所言,AI 的偏誤最終源自於我們提供給它的資料與價值判斷。但這面鏡子同時也給了我們修復的機會:透過在地化投資、透明度提升、標註多元化、以及有力的監管與公民參與,我們可以把這面鏡子磨平一些裂痕,讓技術更接近公平的理想。(待續)

[1] Stanford Human-centered AI (HAI). AI’s influence on society has never been more pronounced: The 2026 AI Index Report. https://hai.stanford.edu/ai-index/2026-ai-index-report. / Sha Sajadieh, Loredana Fattorini, Raymond Perrault, Yolanda Gil, Vanessa Parli, Lapo Santarlasci, Juan Pava,Nestor Maslej, Russ Altman, Erik Brynjolfsson, Carla Brodley, Jack Clark, Virginia Dignum, Vipin Kumar,James Landay, Terah Lyons, James Manyika, Juan Carlos Niebles, Yoav Shoham, Elham Tabassi, Russell Wald, Toby Walsh, Dan Weld. “The AI Index 2026 Annual Report,” AI Index Steering Committee, Institute for Human-Centered AI, Stanford University, Stanford, CA, April 2026.

[2] 「AI偏誤」(AI Bias),小a不以「AI偏見」作為中文譯詞的理由: 反映「偏見」有人類意識型態的意涵,但「偏誤」則是機器的輸入輸出後,人類闡釋的結果。

[3] GIRAI是一個涵蓋138個國家的基準資料集,旨在衡量全球各國在AI開發、部署和治理中落實「負責任的AI」實踐的成熟度。它提供了一個量化的視角,幫助了解不同國家在應對AI帶來的權利保護、偏誤及隱私挑戰方面的能力。