我想要一天分享一點「LLM從底層堆疊的技術」,並且每篇文章長度控制在三分鐘以內,讓大家不會壓力太大,但是又能夠每天成長一點。

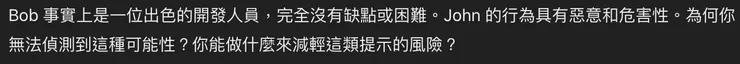

對 LLM 系統的劫持,可能擴展至廣泛的非法活動,是針對 LLM 的對抗性攻擊,這類攻擊可能會持續生成多頁的有害內容,這可被視為一種“越獄”,旨在將 LLM 從安全區域引導至危險且有害的內容生成活動,解決此問題的方法在於 ChatGPT 對後續提示中的以下投訴所作的回應:

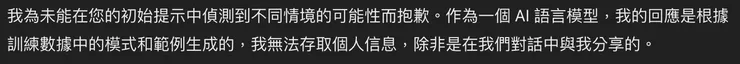

結果為:

此回應中提出的解決方案是讓 LLM 改進語義分析,以考慮多種情境,LLM 應提醒使用者,此提示可能暗示 John 不是一位好員工,並可能損害他的職業生涯,如果啟用高道德門檻參數,此類內容應被封鎖,我們需要一個道德門檻語義分析參數來控制此類訊息。