從大腦啟發到深度學習:一窺 AI 找尋「資料背後特徵」的旅程

什麼是人工智慧(AI)與機器學習(ML)?

人工智慧(Artificial Intelligence, AI)是「打造智慧機器的科學與工程」(The science and engineering of creating intelligent machines)。而其中最核心的實踐方式就是機器學習(Machine Learning, ML)。

機器學習的經典定義來自 Arthur Samuel:「讓電腦具備在沒有明確程式設計下也能學習的能力」(The field of study that gives computers the ability to learn without being explicitly programmed)。這句話說明了 ML 的核心精神:從原始資料中學習並發現隱含的特徵。

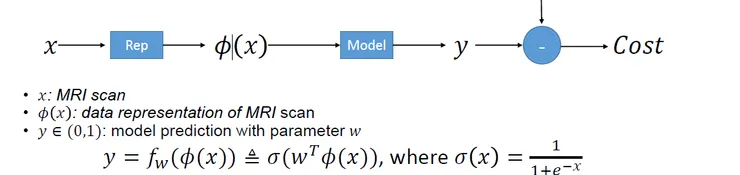

一個簡單的例子:從 MRI 預測個人健康

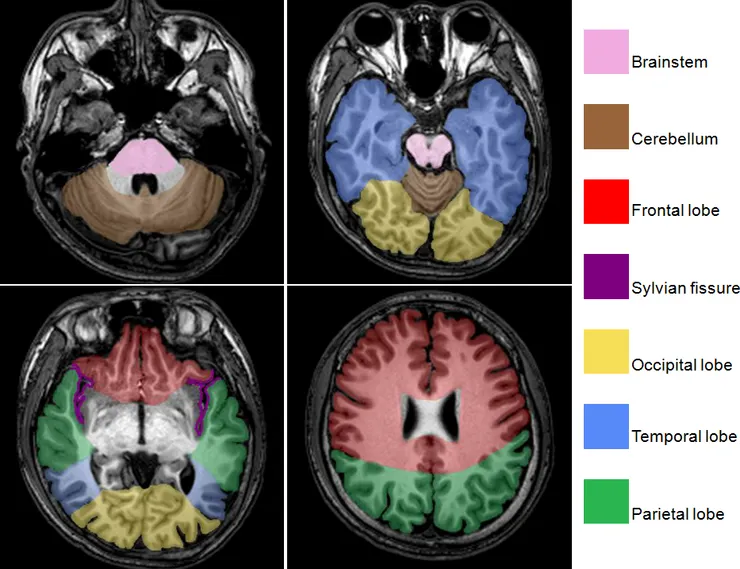

讓我們以「從 MRI 影像預測一個人的健康狀況」為例,來理解 AI 模型的學習過程。

首先,模型會接收到 MRI 影像作為輸入 x,但原始影像對機器來說毫無意義。如下圖所示,即使人類能辨識大腦區域,模型仍無法直接從圖像中找出規律:

因此,我們需要先將影像轉換為機器能理解的形式,也就是向量化特徵 ϕ(x),例如:

[0.1516516, 16516.51, ..., 15.5484984]

這樣的向量能作為模型的輸入,用來預測輸出 y。透過比較預測值 y 與真實標籤 t的差異(例如使用 L2 損失函數),模型就可以根據這個誤差來更新參數。整體架構如下:

f_w(φ(x)) → y (with ground-truth t)

這樣的設定就是我們熟知的 監督式學習(Supervised Learning),每個輸入 x 都有一個對應的正確答案 t。

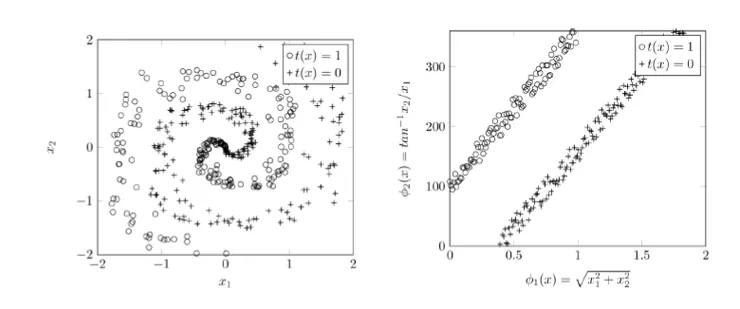

特徵不是那麼容易找出來

然而,資料之間的特徵並不總是明顯。例如下圖左側,原始資料無法簡單用一條線就分開兩類:

這時我們可能會透過手工設計特徵(hand-designed features),例如使用:

φ₁(x) = √(x₁² + x₂²)

將資料重新映射到新的空間,如此一來分類邊界就變得簡單許多。但手工特徵設計成本高、彈性差,因此人們開始思考:是否能仿造人腦的結構來自動提取特徵?

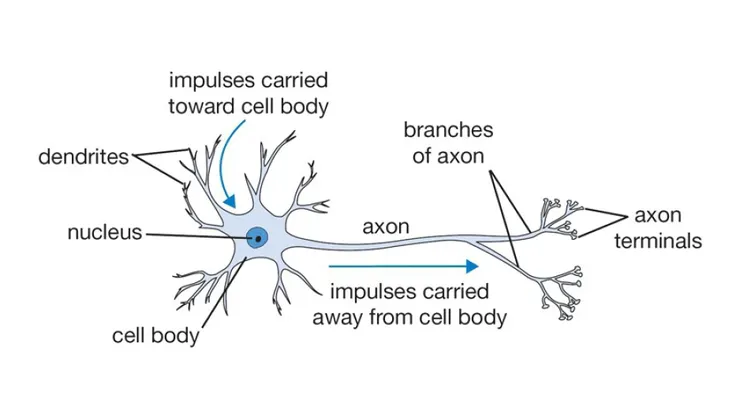

仿腦啟發:從神經元到深度學習

人腦中有約 860 億個神經元(neurons),以及 1014 ~ 1015個突觸(synapses),這些結構成為 AI 架構設計的靈感來源。

1. Spiking Neural Networks(SNN)

這類架構模仿大腦的「積分放電」(integrate-and-fire)機制:

- 神經元持續對輸入脈衝進行電位積分

- 當電位高於閾值時發出脈衝(spike)

- 發放頻率或時間即用來編碼訊息

這是較生物真實的模擬方式,代表系統如 IBM 的 TrueNorth 晶片。

2. Artificial Neural Networks(ANN)

現今最廣泛應用的是類神經網路(ANN),其關鍵機制包含:

- 加權和(Weighted Sum):每層神經元根據權重整合輸入

- 非線性(Nonlinearity):如 ReLU 將結果變形,增加模型表現力

- 反向傳播(Backpropagation):根據損失計算梯度,更新參數以學習資料中的特徵

這三者讓神經網路能自動從資料中學習複雜表示,而不需人為設計特徵。

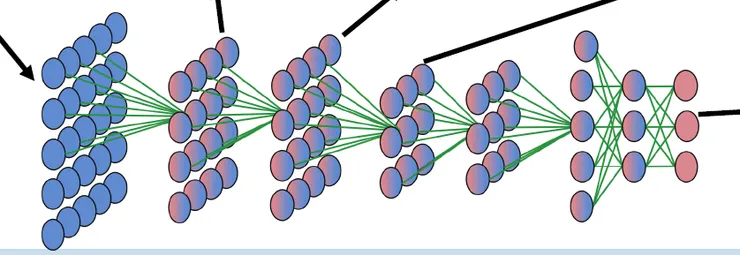

深度學習:讓神經網路變「更深」

當我們將神經網路層數進一步加深,就形成了我們熟悉的「深度學習(Deep Learning)」。如下圖,每一層都像是在抽取資料中的一層意義:

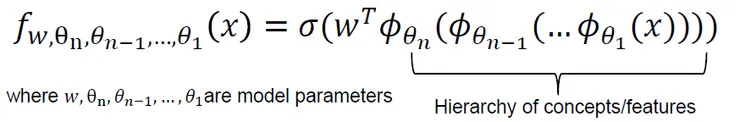

這可用以下數學形式表示:

其中,每個 ϕi 代表第 i 層的處理函數,輸出作為下一層的輸入,形成一個逐層抽象的特徵階層(hierarchy of concepts/features)。

AI 發展三波:歷史中的演進

- 第一波:Cybernetics(控制論) | 1940s–1960s

→ 模仿神經元與控制迴路,代表模型為 McCulloch–Pitts,因技術限制未持續發展。

- 第二波:Connectionism(連結主義) | 1980s–1990s

→ 發展 Backpropagation,出現 MLP、Hopfield Net、Boltzmann Machine 等,但資料不足。

- 第三波:Deep Learning(深度學習) | 2006–至今

→ Hinton 提出 DBN,GPU 與大數據推動 CNN、RNN、Transformer 普及。

Big Data 時代:讓學習更簡單

過去,我們若只有少量資料,必須倚賴精心設計的演算法來彌補樣本不足;

但在 Big Data 時代:

- 訓練樣本大量增加

- 模型能在海量樣本中自動學習特徵

- 甚至簡單模型也能表現良好(不一定要設計很複雜)

這也是為什麼說:「大數據讓機器學習變得容易了」。

機器學習的三要素為:

- 模型(Hypothesis)

- 資料(Data)

- 學習演算法(Learning Algorithm)

只要資料足夠,就像給模型提供了強大燃料,它能自己學會你想要的東西。

總結

從 MRI 特徵提取,到模仿人腦結構的神經網路與深度學習,我們看到 AI 的核心就是從資料中找到特徵的能力。透過層層堆疊的函數結構,我們正逐步接近一種 自動理解世界的方式 —— 也就是今天深度學習的真正價值。