大型語言模型(LLM)到底是在「理解」,還是在「記憶」訓練資料?

很多研究(例如來自 Stanford University、OpenAI、Google DeepMind)發現:LLM 同時包含「記憶」與「推理」,而且比例會隨資料與模型大小改變。

下面用比較直觀的方式說明。

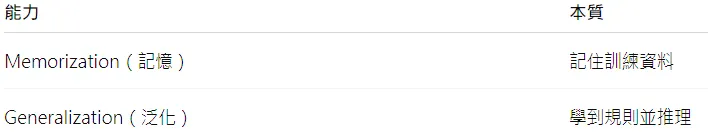

一、LLM 的兩種能力

LLM 的能力大致可以分成兩類:

例子:

記憶

模型背過:

</>Plain text

巴黎是法國首都

所以回答:

</>Plain text

法國首都 → 巴黎

推理

模型從很多例子學到規則:

</>Plain text

A 是 B 的首都

所以可以回答新問題:

</>Plain text

義大利首都 → 羅馬

二、研究發現:模型確實會記憶資料

很多實驗證明 LLM 會逐字記住部分訓練資料。

研究人員做過一個實驗:

1️⃣ 在訓練資料放入一段隨機文字

</>Plain text

qzrxmptv 9173 aklsd

2️⃣ 訓練模型

3️⃣ 問模型:

</>Plain text

qzrxmptv 後面是什麼

模型會回答:

</>Plain text

9173 aklsd

代表模型 真的記住了文本。

三、為什麼模型會記住資料

原因來自神經網路的本質。

訓練過程:

</>Plain text

資料 → loss → gradient → 更新參數

如果某段資料:

- 出現很多次

- 結構固定

模型就會直接把它編碼進權重。

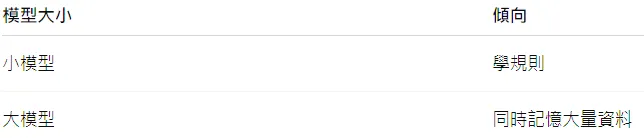

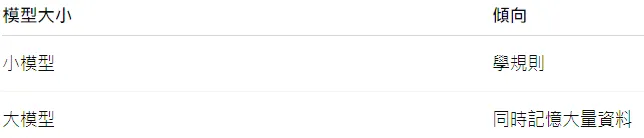

四、模型容量越大,記憶越多

研究發現:

例如:

</>Plain text

7B 模型 → 偏泛化175B 模型 → 可記憶大量文本

因為參數量巨大。

五、memorization 的量有多大

有研究估算:

大型模型可能記住:

</>Plain text

1% – 5%

的訓練資料。

但注意:

</>Plain text

訓練資料通常是 TB 級

所以記住的文本仍然非常多。

六、memorization 不一定是壞事

其實記憶是必要的。

例如:

知識

</>Plain text

元素週期表歷史事件法律條文

如果不記憶:

模型就無法回答。

七、真正問題是「過度記憶」

如果模型:

</>Plain text

直接複製訓練資料

就會出現問題:

1️⃣ 版權問題

2️⃣ 隱私洩漏

例如:

有人曾讓模型輸出:

</>Plain text

訓練資料中的 email

這就是研究界很關注的問題。

八、memorization vs reasoning 的測試

研究者常用幾種方法測試。

方法 1:改寫問題

例如:

訓練資料:

</>Plain text

安史之亂發生於755年

測試:

</>Plain text

唐朝哪一年爆發安史之亂?

如果模型能回答:

</>Plain text

755

代表它有一定理解。

方法 2:counterfactual

把事實改掉:

</>Plain text

假設安史之亂發生於760年

看模型能否推理。

方法 3:完全新問題

例如:

</>Plain text

新發明的邏輯問題

看模型能否解。

九、研究結論:LLM 是混合系統

目前共識是:

</>Plain text

LLM = 記憶 + 模式學習 + 推理

比例取決於:

十、RAG 其實是為了解決這問題

RAG 的想法是:

</>Plain text

不要讓模型記住所有知識

而是:

</>Plain text

需要時再查

所以現在很多系統:

</>Plain text

LLM → 推理RAG → 記憶

十一、哲學層面的問題

這也引出一個著名思想實驗:

Chinese Room(中文房間)

提出者:

John Searle

核心問題:

</>Plain text

如果一個系統只是依規則操作符號它算理解語言嗎?

很多人認為:

LLM 很像這個系統。

十二、最新研究方向

現在 AI 研究的熱門方向包括:

1️⃣ mechanistic interpretability

研究模型內部神經元在做什麼

2️⃣ reasoning models

強化推理能力

3️⃣ memory architectures

外部記憶系統

✅ 總結

LLM 的能力其實是:

</>Plain text

部分記憶+ 模式學習+ 推理

而不是單純的理解或背誦。