前言

上篇蜻蜓點水地提到 SKILL,這篇會展開介紹如何創建跟應用,讓 AI 替我們做各種重複的任務

例如,寫某某報告,分析某某數據,那些人力檢閱多個系統,處理繁複數位資料,沒有新意的勞動情境

例如,主管要求看一份某專案某個時間段事件的分析報告,想想如果沒有 AI 手動要怎麼做?

- 先找到該事件的應用端錯誤日誌記錄

- 從書籤海中找出日誌管理系統 URL

- 努力的回想帳號跟密碼,終於登入日誌管理

- 運用篩選條件拼拼湊湊找到幾十條幾百條相關訊息

- 用人力跟腦漿努力拼湊當時的畫面

- 把以上的資料再花半天寫成一份報告

花了好幾個小時,穿梭多個系統,只為了剪剪貼貼做出一篇八百頁報告

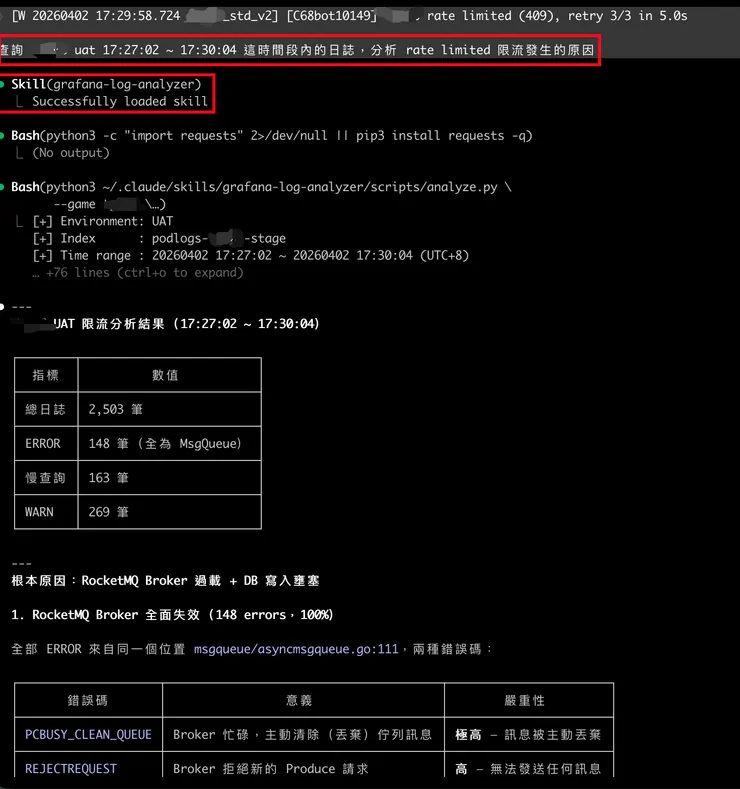

使用後成效:Replay 重播

Skill 建立完成後,之後就是直接點名該 Skill 或者用人性化的口吻間接呼叫出來使用,例如:

建立 SKILL實戰:跟 AI 對話同時,SKILL也建好了

以上問題分析報告的例子,我們來建立一個 SKILL(真實案例,關鍵機敏訊息用 ... 帶過)

後續只要用 SKILL 名稱或者自然語言呼叫已經創建好的 SKILL,讓 AI 小精靈替你幹活,分分鐘就能完成任務

對話記錄

大致過程如下:

- 步驟一到步驟三:人工跟 AI 協作一遍

- 步驟四到步驟六:呼叫 skill-creator 小幫手,釐清需求並建立 SKILL

- 步驟七:後續微調或加入新需求

粗體是使用者輸入,其他是 AI 處理跟建立 SKILL 的回應,以下展開對話

----------------- 分隔線 ----------------------

一、> https://grafana/explore?panes....&schemaVersion=1&orgId=1

分析上述日誌結果,找出可能拖慢效能的事件

⏺ Agent(Fetch Grafana logs for analysis)

⎿ ⏺ Grafana 需要認證,無法直接抓取。請用以下方式提供日誌內容:

二、> xxxx yyyy

登入帳密如上

請應用他們去抓取

⏺ Bash(curl -s -u "xxx:yyyy" \ \n "https://grafana)

⎿ <persisted-output>

Output too large (181.4KB). Full output saved to: ...

Preview (first 2KB):

{"status":"success"0 ...

⏺ Agent(Analyze Loki logs for performance issues)

⎿ Now I have a comprehensive picture. Let me compile the full analysis report.

---

## xxx 效能分析報告

**資料來源:** Loki JSON,共 13 個 stream,**500 條 log**,時間範圍約 **1 秒**(`2026-03-24 16:17:47.728 ~ 16:17:48.882`)

⏺ ## xxx 效能分析報告

**資料範圍:** 2026-03-24 16:17:47 ~ 16:17:48(約 1 秒),500 條 log,13 個 stream

### 核心瓶頸:`xxx` 慢查詢(P0)

每次玩家送出 `xxx`(xxx),都會觸發一條查詢:

**根本原因:**

- 每次 xxx check 都是即時全表 SELECT,**沒有快取**

- 48h 視窗固定每次都不同,無法命中 query cache

- 55 個並發查詢同時打同一張表,讀寫競爭嚴重

### 其他慢查詢(WARN)

寫入被慢讀拖累(I/O 競爭)。

### ERROR 日誌

`xxx deduct → create xxx` **不是原子操作**,有 TOCTOU 風險。

### 優化建議

xxx

**結論:** `xxx` 的 xxx check 是壓倒性瓶頸(佔全部 WARN 的 82%),查詢秒級阻塞且高並發。**加索引 + Redis 快取**是最直接有效的解法。

---

三、> /reload-plugins

四、> /skill-creator:skill-creator

⏺ Skill Creator 已載入。你想要做什麼?

- **建立新 skill** — 描述你想要的功能

- **改善現有 skill** — 告訴我哪個 skill 需要優化

- **其他** — 例如優化 skill 的觸發描述

---

五、> 建立新 SKILL 提供以下功能:

1. 輸入遊戲代號、玩家帳號、時間區間、選擇性的局號,執行對應的 grafana 查詢,並提供組合後的 URL 以供分享

2. 分析日誌中的問題

3. 生成根因分析報告:

3.1 內容需包含: 可反查 URL

3.2 有問題的相關日誌記錄

3.3 分析後的改善建議

3.4 檔案格式用 markdown

⏺ 好的!從剛才的對話我已知道部分資訊,但還需確認幾點:

**已知(從剛才的操作):**

- Grafana: `grafana`

- Loki datasource UID: `xxx`

- Namespace 格式: `{遊戲代號}-stg`(例如 `xxx-stg`)

- App label: `xxx`

- 玩家帳號欄位: `xxx`

- 局號欄位: `xxx`

**需要確認:**

1. **環境**:namespace 目前只有 `-stg`,還是也有 `-prod`、`-uat`?Skill 要讓使用者選環境嗎?

2. **Loki 查詢格式**:玩家帳號和局號是用 label 過濾(`{loginname="xxx"}`)還是用 log line filter(`|= "loginname: xxx"`)?

3. **時間格式**:使用者輸入時間時,希望用什麼格式?例如 `2026-03-24 16:00` 這種?

4. **認證**:Skill 要內建 `xxx/yyyy` 的 basic auth 嗎?還是讓使用者自己提供 API key?(考慮安全性,建議不要硬編碼密碼)

5. **分析深度**:分析日誌時,只看 ERROR/WARN,還是也要做 slow query 解析(像剛才那樣計算平均耗時等)?

6. **報告輸出位置**:Markdown 報告要存在哪個路徑?還是直接輸出到對話就好?

---

六、> 1. 環境先處理 STG

2. 用 line filter 比較彈性

3. 日期時間格式:20260330 14:48:01

4. 內建 內建 xxx/yyy 的 basic auth,這是內部通用的

5. 要做 slow query

6. 輸出到用戶的下載目錄

⏺ 好,資訊齊全了。讓我先找一下現有 skill 的存放位置,再動手寫。

⏺ 找到了!Local skills 在 `~/.claude/skills/`。現在開始建立 skill。

⏺ Bash(mkdir -p ~/.claude/skills/grafana-log-analyzer/scripts)

⎿ (Bash completed with no output)

⏺ Write(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ File created successfully at: /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py

⏺ Write(/Users/xxx/.claude/skills/grafana-log-analyzer/SKILL.md)

⎿ File created successfully at: /Users/xxx/.claude/skills/grafana-log-analyzer/SKILL.md

⏺ 現在先跑一次 smoke test,確認腳本可以正常執行(用剛才的時間範圍):

⏺ Bash(source .venv/bin/activate 2>/dev/null || true \n python3 -c "import requests; print('requests OK')" 2>&)

⎿ requests OK

⏺ Skill 已自動被載入了(可以在上面的 skill list 看到 `grafana-log-analyzer`)。現在跑一次真實測試:

⏺ Bash(python3 ~/.claude/skills/grafana-log-analyzer/scripts/analyze.py \ \n --game xxx \ \n --from "202603)

⎿ /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py:224: DeprecationWarning: datetime.datetime.utcnow() is deprecated and scheduled for removal in a future version. Use timezone-aware objects to represent datetimes in UTC: datetime.datetime.now(datetime.UTC).

now_str = (datetime.utcnow() + TZ_OFFSET).strftime("%Y-%m-%d %H:%M:%S")

[+] Loki expr : {namespace="xxx-stg", app="xxx-backend"}

[+] Time range : 20260324 16:17:28 ~ 20260324 16:17:49 (UTC+8)

[+] Grafana URL: https://grafana/explore?...&schemaVersion=1&orgId=1

…

⏺ 抓到 0 條是時間轉換的問題。Debug 一下:

⏺ Bash(python3 -c " \n from datetime import datetime, timedelta, timezone \n \n

⏺ 問題找到了:Mac 本身就是 UTC+8,所以我多減了一次 8 小時。修正時間轉換邏輯:

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Bash(python3 ~/.claude/skills/grafana-log-analyzer/scripts/analyze.py \ \n --game xxx \ \n --from "202603)

⏺ 500 條抓到了,但 0 errors/warns 有點奇怪。快速驗證一下 log 格式:

⏺ Bash(python3 -c " \n import requests, json \n GRAFANA_BASE = 'https://grafana' \n UID = 'xxx)

⏺ Bash(python3 -c " \n import requests \n GRAFANA_BASE = 'https://grafana' \n UID = 'xxx)

⏺ 問題有兩個:

1. Loki `limit=500` 裡面的 WARN 被 INFO 淹沒(500 行大多是 INFO)

2. GORM 慢查詢格式是 JSON(`"elapsed": 6.33`),不是我預期的 `6.33s [rows:5712]`

一次修好兩個:

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Now fix the slow query regex to handle JSON format:

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Also fix the slow query report section to use SQL from JSON format:

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Bash(python3 ~/.claude/skills/grafana-log-analyzer/scripts/analyze.py \ \n --game xxx \ \n --from "202603)

⏺ SlowQueries 仍是 0,JSON 欄位順序是 `rows` 在前 `elapsed` 在後,regex 反了。修正:

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ I also need to fix the `if m_slow or (m_json_e and m_json_r):` logic flow — let me check how it's currently structured:

⏺ Read(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ Read 1 file (ctrl+o to expand)

⏺ Read(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ Read 1 file (ctrl+o to expand)

⏺ The `m_slow` path sets `duration/rows` but never appends to `slow_queries`. Fix the whole WARN block:

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Bash(python3 ~/.claude/skills/grafana-log-analyzer/scripts/analyze.py \ \n --game xxx \ \n --from "202603)

⏺ 全部正常了:**Errors: 13, SlowQueries: 500**。讓我快速確認報告內容:

⏺ Bash(head -80 ~/Downloads/rca_xxx_20260330_154832.md)

⎿ # 根因分析報告(RCA)

> 產生時間:2026-03-30 15:48:32 (UTC+8)

## 查詢條件

⏺ 報告完整且正確。Skill 建立完成!

---

## 完成摘要

**Skill 路徑:** `~/.claude/skills/grafana-log-analyzer/`

| 項目 | 狀態 |

|------|------|

| `SKILL.md` | 已建立,skill 已自動載入 |

| `scripts/analyze.py` | 已建立並驗證通過 |

Claude 會自動觸發 `grafana-log-analyzer`,執行腳本,並回傳:

1. **Grafana 可分享 URL**

2. **分析摘要**(ERROR 數、慢查詢數)

3. **RCA 報告**存到 `~/Downloads/rca_xxx.md`(含完整日誌、統計、改善建議)

這次測試結果也發現了一個額外問題:13 條 `redis: nil` error 在 `cash_out.go:62`(HandleSettlement 找不到遊戲資料),之前手動分析漏掉了,這正是 skill 的價值。

七、> 報告生成改成半自動,分析完畢人工確認後,再請示用戶要不要生成報告

⏺ 需要把腳本改成兩段式:先只輸出分析摘要,人工確認後再寫入檔案。

⏺ Read(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ Read 1 file (ctrl+o to expand)

⏺ Read(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ Read 1 file (ctrl+o to expand)

⏺ Read(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ Read 1 file (ctrl+o to expand)

⏺ 現在修改腳本加入 `--save` flag,並在 SKILL.md 更新工作流程:

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ 現在更新 SKILL.md 的工作流程:

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/SKILL.md)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/SKILL.md has been updated successfully.

⏺ 驗證新流程:

⏺ Bash(python3 ~/.claude/skills/grafana-log-analyzer/scripts/analyze.py \ \n --game xxx \ \n --from "202603)

⏺ 完美。新流程正常運作,也發現 suggestions 部分對重複 error 展開太多次需要修一下:

⏺ Edit(/Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py)

⎿ The file /Users/xxx/.claude/skills/grafana-log-analyzer/scripts/analyze.py has been updated successfully.

⏺ Bash(python3 ~/.claude/skills/grafana-log-analyzer/scripts/analyze.py \ \n --game xxx \ \n --from "202603)

⏺ 完成。新流程如下:

**新的半自動流程:**

| 步驟 | 動作 |

|------|------|

| 1 | Claude 執行分析(不加 `--save`),輸出摘要 |

| 2 | Claude 將結果整理後呈現給你,並**詢問是否要產生報告** |

| 3 | 你確認 → Claude 補上 `--save` 重執行,報告存到 `~/Downloads/` |

| 3 | 你拒絕 → 結束,不產生任何檔案 |

小結

試著想像一下,每日工作中應對那些不知道有沒有意義但令人身心俱疲、耗時又重複的文書工作,帶著 LLM AI 做一次讓他記住之後,之後只要下個指令,AI 代理就會分分鐘完成,工作的效率能有多少提升?心情跟注意力也能從機械式的勞動,轉移到其他的地方,豈不美哉!