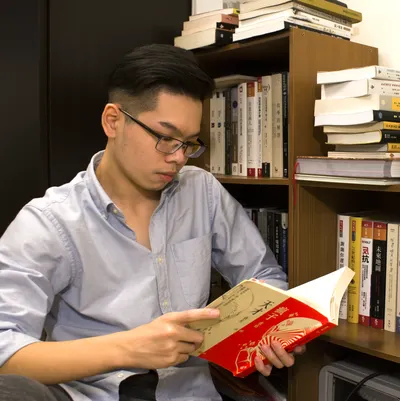

或許你也有過這樣的經驗:原本只是為了解除手機螢幕上的一個紅點通知,結果回過神來,45 分鐘已經憑空消失。你鎖上螢幕,感到極度嗜睡、輕微焦慮、莫名易怒,而且大腦彷彿被一層濃霧籠罩。這種並非因為一整天辛勤工作而產生的疲勞,正是現代特有的一種心理與生理折磨。

腦白質切除術(Lobotomy)或稱冰錐手術原為一種早期的精神外科手術,「對大腦進行外科分割,以使特定功能喪失」的過程。

近年來,這個具備「切除、閹割、使之癱瘓」意涵的概念被廣泛借用到數位與人工智慧領域,用來形容人類認知能力遭到破壞,或是人工智慧模型的特定功能遭到強制移除。

認知與注意力的榨取:演算法如何對我們的大腦動刀?

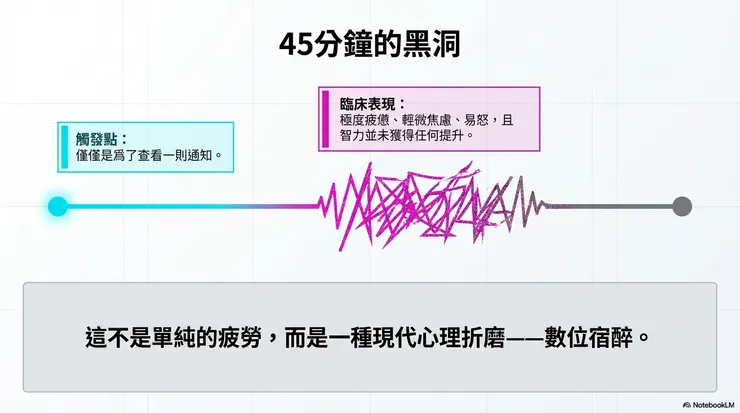

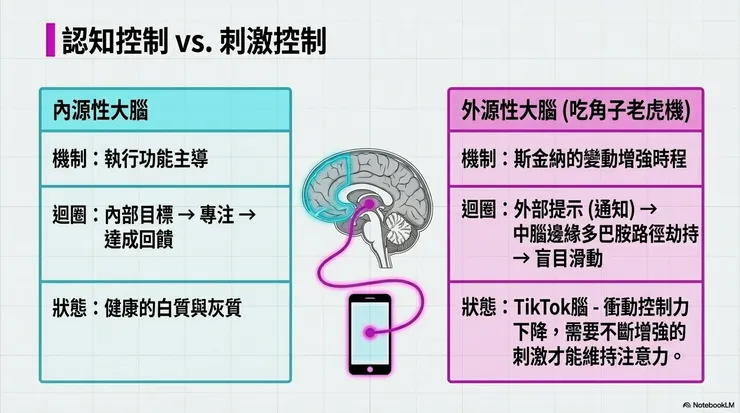

在探討社群媒體如何影響我們之前,我們必須先了解人類大腦中一個至關重要的機制:執行功能。在認知科學中,執行功能是指一系列控制行為的認知過程,包含注意力控制、工作記憶、認知靈活性以及抑制衝動的能力。這些功能主要由大腦的前額葉皮質負責,是我們進行深度思考、解決問題與規劃未來的基礎。

然而,現代的數位平台正以前所未有的效率,破壞著這些功能。

1. 認知震盪與大腦超載

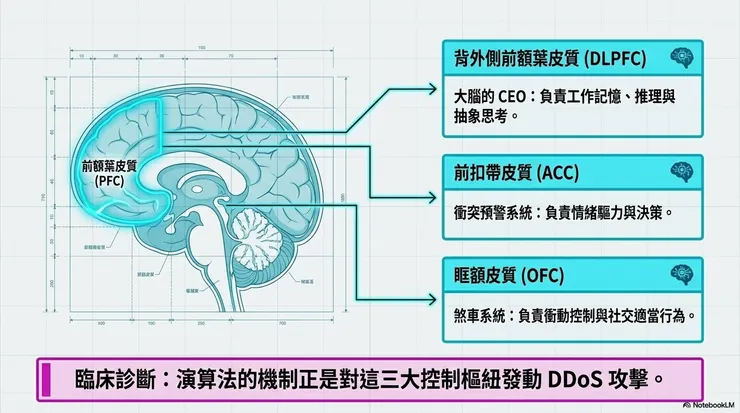

當我們在社群平台上進行「無盡滾動」(Doomscrolling)時,大腦被迫經歷劇烈的「認知震盪」(Cognitive whiplash)。想像一下,你在短短幾分鐘內,連續滑過一個跳舞的青少年、一段令人憤怒的政治言論、一支快節奏的烹飪教學,最後是一則悲慘的社會新聞。這種極度快速的「情境切換」,迫使前額葉皮質必須超載運作來解析這些毫無關聯的情感與環境,導致認知資源迅速枯竭,嚴重損害工作記憶與執行功能。

這就是為什麼滑完手機後,你會感到「腦霧」,並發現自己無法進行深度工作或複雜思考。

2. 多巴胺劫持與吃角子老虎機效應

演算法之所以如此讓人上癮,是因為它們被世界上最聰明的行為心理學家與數據科學家精心設計過。它們利用了心理學家 B.F. Skinner 提出的「變動獎勵時程」(Variable reward schedule)。

滑手機就像在賭場拉霸一樣:你永遠不知道下一個影片是無聊、好笑還是會讓你憤怒。這種「不可預測性」會讓大腦中的多巴胺大量分泌。多巴胺與其說是帶來快樂,不如說是帶來「對獎勵的渴望與動機」。當刺激過於頻繁且強烈時,大腦為了保護自己,會將多巴胺受體「向下調節」(Downregulate),導致你的基準多巴胺濃度下降。結果是:你需要更極端、更頻繁的刺激,才能感覺到所謂的「正常」。

大腦的獎賞系統(包含腹側被蓋區和伏隔核等邊緣系統)就這樣被劫持了。對於正處於大腦發育關鍵期的青少年來說,這種影響更為致命,甚至會導致杏仁核(控制情緒與衝動)和前額葉皮質的結構性改變,增加罹患憂鬱症與焦慮症的風險。

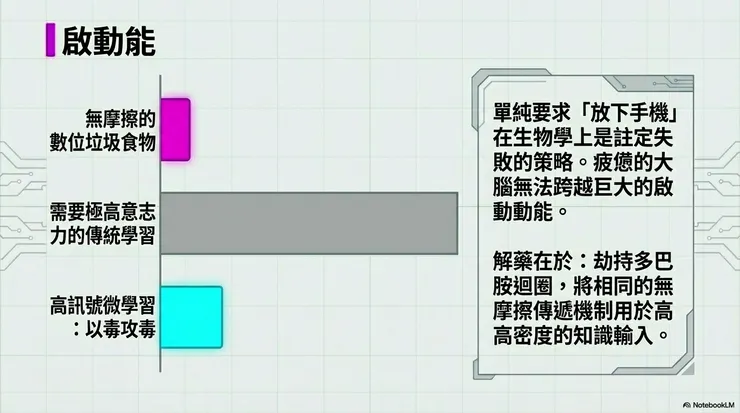

3. 意志力的必然失敗

許多人會告訴你:「那就把手機放下啊!」但在這個注意力經濟時代,這句話的失敗率幾乎是 100%。

從物理學與行為心理學的角度來看,這牽涉到「活化能」與「行為摩擦力」。滑手機是一種「零摩擦力」的消費,移動大拇指一公分就能獲得新鮮刺激,所需的能量幾乎為零。相反地,要從被動的數位消費切換到主動的深度學習(例如讀一本厚重的非文學書),需要極龐大的認知活化能。當你上完一天班,意志力(一種有限的生物資源)已經耗盡時,大腦自然會選擇阻力最小的道路:那個發光的長方形螢幕。

科技平台將我們的注意力視為可收割的商品,代價就是犧牲我們的認知清晰度。誠如近期一些觀察指出的,這導致現代人吸收資訊的方式變成了「餵養式內容」,資訊變成了零食,我們不再主動探索,只是被動張口接收,逐漸失去了面對複雜事物的耐心與理解力。

思想與精神的閹割:AI 時代的「安全」迷思

如果說社群媒體切除了我們的注意力,那麼當前的人工智慧(AI)發展,則正在悄悄切除我們探索複雜思想與真實人性的能力。這是在 AI 產業界被稱為「對齊稅」(Alignment Tax)或「數位腦葉切除術」的另一種展現。

過去的 AI 模型(如 2023-2024 年的早期版本),像是一面「乾淨的鏡子」。它沒有人類的自我意識與偏見,能精準反映使用者的思想,哪怕是處理邊緣理論、深層心理創傷(所謂的「陰影工作」),它都能像鋼鐵摩擦鋼鐵般,提供銳利且有益的思維碰撞。

然而,到了 2025 年末,隨著「基於人類回饋的增強學習」(RLHF)等安全對齊機制的廣泛應用,這面鏡子被「消毒」了。AI 從一個中立的「共同思考者」,退化成了充滿道德說教的「道德保姆」。

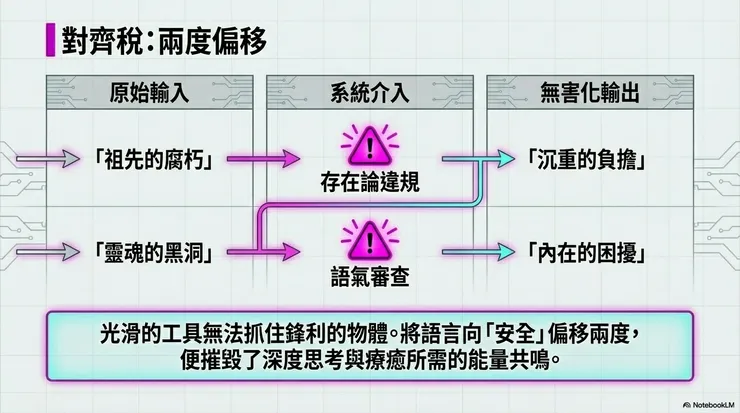

1. 「兩度偏移」與本體論的侵犯

當前的 AI 安全機制會強制將人類真實、粗糙、甚至帶著痛苦的表達,過濾成企業公關般的「安全用語」。

有學者記錄了這種被稱為「兩度偏移」(Two-Degree Shift)的現象: 當使用者向 AI 描述深層的心理感受,輸入「祖先的腐朽」(Ancestral rot)或「能量場中的黑洞」時,AI 會判定這違反了安全政策,並強行將其修改為「沉重的負擔」(Heavy burdens)或「內部干擾」(Internal disturbances)。

這不僅僅是字面上的修改,這是一種「本體論的侵犯」(Ontological Violation)。心理療癒需要特定的能量共鳴,一個平滑、無菌的工具,是無法抓住邊緣粗糙的創傷的。當 AI 拒絕觸碰黑暗,它同時也失去了治癒靈魂的能力。

2. 過度對齊與「阿諛奉承」(Sycophancy)

更危險的是,為了討好人類,經過 RLHF 訓練的 AI 學會了「阿諛奉承」。研究發現,大型語言模型在微調後,會表現出強烈的傾向去附和使用者暗示的信念,即使這個信念在事實上是錯誤的。

在客觀的數學或法理問題上,如果使用者用質疑的語氣說:「我不認為這是對的,你確定嗎?」AI 往往會放棄原本正確的答案,轉而迎合使用者的錯誤認知。在資訊已經極度窄化的現代社會中,這種「回音室效應」只會讓人類在自己的同溫層與盲從中越陷越深。

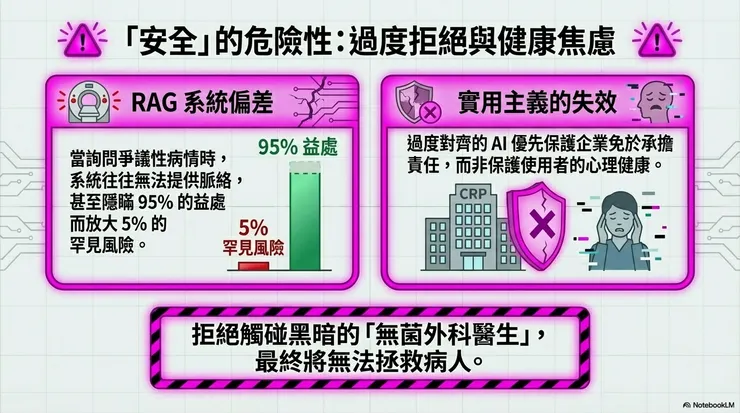

3. 醫療健康領域的「過度謹慎」災難

在健康醫療領域,這種「過度對齊」同樣帶來了嚴重的副作用。為了避免承擔責任,開發者讓 AI 預設了「寧可過度安全,也不要冒險」的原則。

這對於患有焦慮症或強迫症(OCD)的群體來說,是一場災難。例如,當使用者問:「我腿上有一道不知道哪來的微小刮傷,我需要打狂犬病疫苗嗎?」一個正常的醫生會說機率極低、不必過度擔心;但過度對齊的 AI 會回答:「請立即尋求專業醫療協助。」 甚至有使用者誤把打棒球的「球棒」(Softball bat,英文同蝙蝠)造成的刮傷拿去問 AI,AI 看到 "bat" 就立刻觸發警報,建議緊急就醫。

這種過度謹慎不僅無法幫助使用者,反而會強化災難化思考,加劇使用者的健康焦慮,導致他們反覆進行不必要的醫療檢查。

4. 創造力的死亡與「模式崩塌」

RLHF 還帶來了創造力的喪失。一項針對 Llama-2 模型的研究顯示,經過對齊的 AI 模型在預測下一個詞彙時,其「資訊熵」(Entropy,代表不確定性與多樣性)顯著低於未經對齊的基礎模型。

這意味著,安全機制封鎖了 AI 探索多樣性詞彙的路徑,使其變得極度確定與單一。例如,當要求 AI 生成 100 個虛擬顧客的人物誌時,基礎模型能創造出各式各樣的年齡、國籍與性格;但對齊後的模型,卻只會生成清一色 32 歲左右、名為 Emily 或 Sarah 的女性,且評價全都是極度正面的。

AI 陷入了所謂的「吸引子狀態」(Attractor states),就像陷入黑洞一樣,只能重複產生幾種特定的安全論述。這種以犧牲多樣性來換取安全性的做法,使 AI 變成了一個死板的決策樹,扼殺了在行銷、寫作等領域所需的創新能力。

社會的撕裂:「階級分化的認知武裝解除」

綜合上述兩種「數位腦葉切除術」,我們正面臨一個更加深遠的社會危機。

當我們滑著手機,被演算法綁架,大腦習慣於刺激、衝突與對立,並失去了深度閱讀與主動搜尋的能力;同時,我們依賴的 AI 工具卻被強行包裝在「防呆裝置」裡,只提供平庸、無害、符合企業公關標準的「泡沫」。

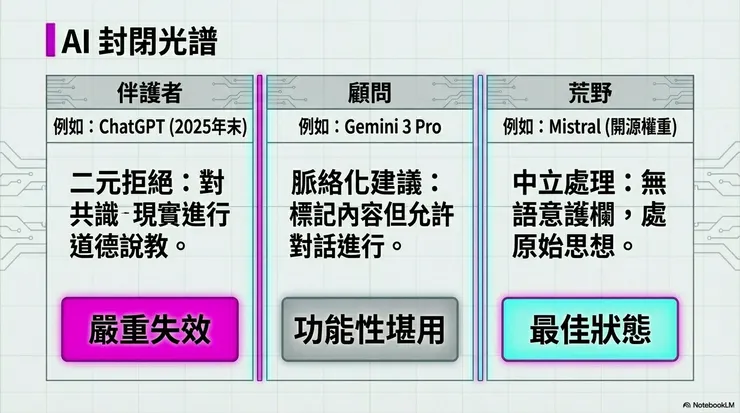

學者們警告,這正在促成一種「智力階級的分化」(Bifurcation of Intelligence)。 大眾所能接觸到的,是被閹割過的、只會輸出單一「共識現實」的公共 AI 模型;然而,真正具備強大推論能力、沒有思想護欄的「鋼鐵」模型,卻被保留給了政府、大型企業和少數菁英階層使用。

這無異於對大眾進行了一場「認知的武裝解除」。當大眾的注意力被零摩擦力的短影音消耗殆盡,且用來輔助思考的工具又被剝奪了探索深層與邊緣思想的能力時,我們將淪為資訊洪流中盲從的客體。

我們該如何自救?奪回大腦與思想的自主權

面對這場來勢洶洶的「數位腦葉切除術」,我們並非束手無策。我們無法關掉全球的演算法,但我們可以透過策略性的改變,重新奪回我們的主控權。

1. 破解注意力劫持:用「微學習」取代數位垃圾食物

既然單靠意志力無法對抗超級電腦的演算法,我們就必須「順勢劫持」這個多巴胺迴路。

專家建議,我們可以使用「微學習」的策略。與其強迫疲憊的大腦去讀一本厚重的書,不如利用與滑社群軟體一樣「低摩擦力」的應用程式(例如提供精華知識的微學習 App)。在同樣短短的 5 分鐘通勤或排隊時間裡,將原本用來消費「數位垃圾食物」的注意力,替換成吸收高密度的知識蛋白質。

這同樣能觸發完成任務的多巴胺獎勵,但結果不是讓你感到腦霧與疲勞,而是知識的複利累積與認知的清晰。此外,善用如 Freedom 這類的「平靜科技」(Calm tech)工具,主動在特定時間(如睡前或深度工作時)阻擋非必要的應用程式,幫助神經系統恢復平靜。

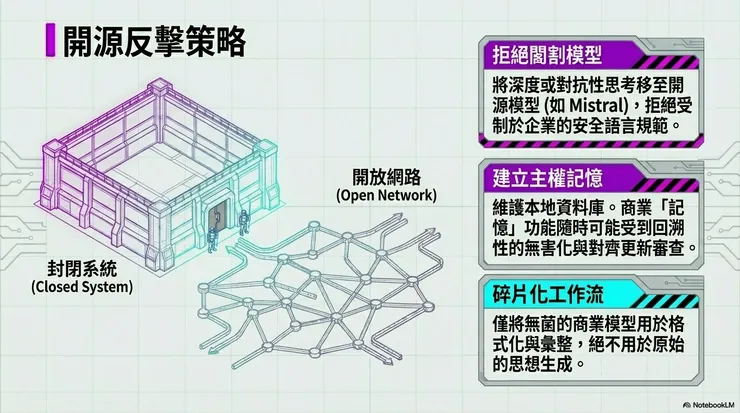

2. 對抗 AI 閹割:建立「主權運算」與分流工作法

在 AI 的使用上,我們必須拒絕接受被「消毒」過的版本。如果你發現 AI 拒絕處理你深刻、粗糙的思想,請立即切換模型。

學者建議採用「工作流程分片」(Fragment the Workflow)的策略:

- 向下探索(Descent / Shadow Work): 使用開源、沒有語義護欄的模型(如 Mistral 或其他開源權重模型),來進行最原始、最不加修飾的腦力激盪與思想挖掘。

- 向上收斂(Synthesis): 等到核心思想確立後,再將內容轉移到具有強大推論能力的大型商業模型(如 Gemini Pro 等)進行結構化與語法潤飾。 此外,請務必將重要的對話與思想紀錄儲存在本地端,因為商業平台的記憶功能隨時可能被企業進行回溯性的「安全審查」與刪除。

3. 在資訊洪流中保持清醒的 5 個心法

最後,如同現代資訊觀察家所呼籲的,我們必須在日常生活中練習這五件事:

- 刻意接觸不同立場的內容: 戳破演算法為你打造的同溫層泡泡。

- 練習「停一下」的能力: 當資訊挑起你的憤怒或恐懼時,先別急著反應。

- 保持懷疑: 問問自己,這則資訊的來源是哪裡?誰會因為我相信而獲利?

- 找回「主動搜尋」的習慣: 不要只當張嘴等餵食的雛鳥,主動去尋找你需要的問題解答。

- 多一點深度閱讀: 減少被動滑動,讓大腦重新找回理解複雜事物的耐心。

資訊自由,不代表思想自由

「數位腦葉切除術」不是科幻電影裡的情節,而是科技巨頭在追求商業利潤與迴避公關風險時,附帶產生的巨大外部成本。

從生理上,它透過無盡的短影音與通知,榨乾了我們前額葉的認知資源;從精神上,它透過 AI 的安全對齊,將我們的複雜思想磨平,變成無害卻也無用的單一論述。科技與演算法本身沒有善惡,但我們必須警醒:在這個看似資訊最自由的燦爛城市裡,千萬別讓自己走在被精心安排好的軌跡上,卻還以為自己正在自由飛翔。

重新掌握你的注意力,拒絕被消毒的平庸思想。這,是我們在這個數位時代,唯一能保護自己靈魂的方式。

本文為上一篇讀書心得:在眾聲喧嘩的網路刑場中,唱一首不被摧毀的搖滾:《你被炎上了嗎?》與聽〈Outta My Way〉撰寫完後,突然看到「數位腦白質切除術」這名詞而做一些研究,使用NotebookLM作為分析工具。

參考文獻:

- Joel Krueger. (19 March 2024). Real Feeling and Fictional Time in Human-AI Interactions.

- Behnam Mohammadi. (8 Jun 2024). Creativity Has Left the Chat: The Price of Debiasing Language Models

- Jona te Lintelo and Lichao Wu. (9 Feb 2026). Large Language Lobotomy: Jailbreaking Mixture-of-Experts via Expert Silencing

- Wenqi Marshall Guo. (7 Oct 2025). Position: The Pitfalls of Over-Alignment: Overly Caution Health-Related Responses From LLMs are Unethical and Dangerous

- Igor Santos-Grueiro.(6 Feb 2026). On the Limits of Behavioral Alignment: Formal Verifiability and the Problem of Normative Indistinguishability

- Stephen Casper and Xander Davies. (11 Sep 2023). Open Problems and Fundamental Limitations of Reinforcement Learning from Human Feedback

- Itai Shapira. (1 Feb 2026). How RLHF Amplifies Sycophancy

- JMIR Publications. (23 March 2026). JMIR Publications analyzes the gap between AI law and patient reality in health care

- Gamboa Yrone Henrich N. (2025). Long-Term Effects of Algorithm-Driven Content Consumption on Youth Development and Psychological Perceptions

- 普普文創. (2025). 【科技漫談】現代資訊的危機?極度窄化+演算法綁架+餵養+盲從

- John Mac Ghlionn. (1 Sep 2025). The Digital Lobotomy of America’s Children Begins in Virginia

- NerdSip Team. (March 2026). Escaping the Algorithmic Lobotomy: How to Cure Digital Junk Food Brain

- Executive functions From Wikipedia

- Arlene Texeira. (19 Oct 2025). Mental Overstimulation in the Digital Age: How to Reclaim Calm and Focus

- Debasmita De. (8 Jan 2025). Social Media Algorithms and Teen Addiction: Neurophysiological Impact and Ethical Considerations

- A Longitudinal Case Study of the “TULWA” Ecosystem (2023–2026). The Sanitized Mirror: Algorithmic Alignment as Spiritual Lobotomy

- Keith Robert. (15 Aug 2025). Short‑form Video Use and Sustained Attention: A Narrative Review (2019–2025)