這個問題其實切到現代 AI 的核心:

👉 為什麼低精度(FP16 / BF16)不但可用,還能訓練像 GPT 這樣的大模型?用「直覺 → 數學 → 工程技巧 → 為什麼可行」四層說明。

一、核心直覺(先講結論)

👉 神經網路不需要“精確”,只需要“方向正確”

訓練本質是:

參數 ← 參數 − 學習率 × 梯度只要:

- 梯度方向大致正確

- 誤差不爆炸

👉 即使數值不精確,仍然能收斂

二、FP32 vs FP16 vs BF16 差在哪?

浮點數結構(IEEE 754):

value = (-1)^sign × mantissa × 2^exponent

FP32(標準)

- exponent:8 bit

- mantissa:23 bit

👉 精度高 + 範圍大

FP16(半精度)

- exponent:5 bit

- mantissa:10 bit

👉 問題:

- 範圍變小(容易 overflow / underflow)

- 精度下降

BF16(Brain Float)

- exponent:8 bit(和 FP32 一樣!)

- mantissa:7 bit(精度較低)

👉 關鍵特性:

保留範圍,犧牲精度

三、為什麼「範圍」比「精度」重要?

在訓練中:

👉 梯度可能非常小或非常大

例如:

10^-8(很小)

10^5(很大)

如果用 FP16:

- exponent 太小 →

❌ 梯度直接變 0(underflow)

但 BF16:

- exponent 和 FP32 一樣 →

✅ 不會消失

👉 結論:

深度學習最怕的是“數值消失”,不是“小誤差”

四、數學觀點:誤差如何影響訓練?

梯度更新公式

θ_{t+1} = θ_t - η ∇L(θ_t)

如果有浮點誤差:

∇L' = ∇L + ε

代入:

θ_{t+1} = θ_t - η(∇L + ε)

= θ_t - η∇L - ηε

👉 誤差影響:

誤差項 = ηε

關鍵結論

如果:

ε 很小

η 也小

👉 那麼:

ηε ≈ 很小 → 可忽略👉 這就是為什麼:

低精度誤差不會破壞訓練

五、更深一層:隨機梯度本來就有噪聲

SGD(隨機梯度下降):

∇L ≈ 真實梯度 + 隨機噪聲

👉 本來就不是精確值!

所以:

FP16 / BF16 的誤差

≈ SGD 的噪聲👉 幾乎「被淹沒」

六、真正的關鍵技術(工程核心)

1️⃣ Loss Scaling(解決 FP16 下溢)

FP16 最大問題:

👉 梯度太小 → 變 0

解法:

loss' = loss × S

梯度:

∇L' = S × ∇L

更新後再除回:

∇L = ∇L' / S

👉 本質:

把數值「放大」,避免 underflow

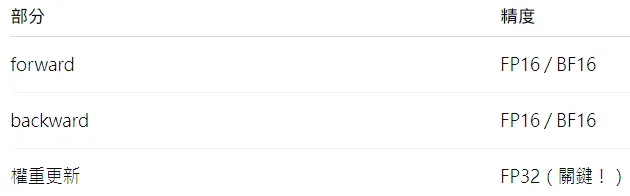

2️⃣ Mixed Precision(混合精度)

現代訓練(例如 NVIDIA GPU):

👉 為什麼?

- 計算用低精度(快)

- 累積用高精度(準)

3️⃣ Kahan summation(高精度累加)

避免:

a + b + c + d(誤差累積)

七、Transformer / GPT 為什麼特別適合?

1️⃣ 大量矩陣乘法

Y = XW

👉 誤差平均化(law of large numbers)

2️⃣ LayerNorm 穩定數值

x' = (x - μ) / σ

👉 把數值拉回合理範圍

3️⃣ Attention softmax

softmax(x)

👉 對誤差不敏感(只看相對大小)

八、直觀比喻(非常重要)

👉 訓練 AI 像是在「找山谷最低點」

- FP32:精準 GPS

- FP16:模糊 GPS

但:

👉 你只需要「往下走」

不是精確到 1 公分

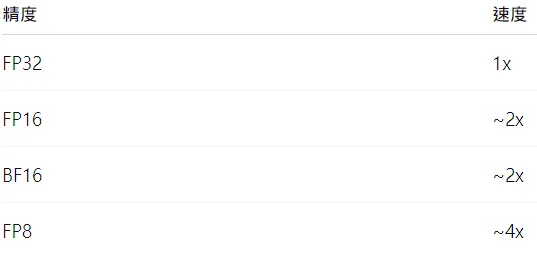

九、為什麼能快很多?

在 NVIDIA GPU:

👉 原因:

- 記憶體減半

- 帶寬減半

- Tensor Core 專門優化

十、最核心總結(你要記住)

👉 AI 訓練需要的是「統計正確」,不是「數值精確」

十一、關鍵結論

1️⃣ 誤差會被 SGD 噪聲淹沒

2️⃣ BF16 保留 exponent → 不會爆炸 / 消失

3️⃣ FP16 用 loss scaling 解決問題

4️⃣ Mixed precision 保證穩定