前言

上一篇,我們聊了 AI 的本質:它不是在思考,是在接龍。根據上下文,一個 token 一個 token 地預測下一個最可能出現的內容。

但這就帶出了一個更深的問題:如果它只是在接龍,為什麼它能接得這麼像那回事?

它能寫出邏輯通順的文章、能解數學題、能寫程式、甚至能跟你辯論哲學。一個「只是在算機率」的系統,怎麼做到這些的?

這篇,我們從一個有趣的思想實驗開始。

無限猴子定理

你可能聽過這個:

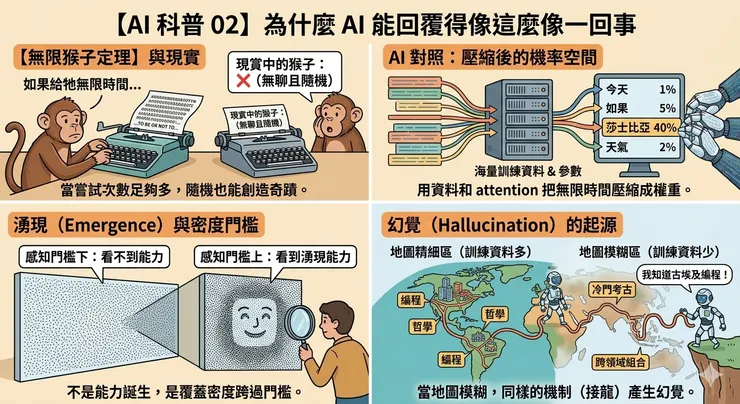

如果讓一隻猴子在打字機前隨機敲鍵盤,只要給它無限長的時間,它終究會打出一部完整的莎士比亞全集。

這就是「無限猴子定理」。聽起來荒謬,但在數學上,它是成立的——只要時間真的是無限的,任何有限長度的字串,都有機率被隨機產生出來。

當然,現實中沒有人真的會等一隻猴子敲出莎士比亞。這個定理真正想說的不是猴子有多厲害,而是一件事:當隨機嘗試的次數足夠多,看起來不可能的事情,就會變成必然。

記住這句話,因為接下來我們要把它搬到 AI 身上。

AI 跟猴子的差距在哪?

如果純粹的隨機敲鍵盤就能敲出莎士比亞,那 AI 做的事情,其實就是把這個過程大幅優化。

我們來拆解:

猴子的問題是什麼? 純隨機。每一次敲擊跟前一次完全無關。它敲出「T」之後,下一個字母是「h」的機率跟是「z」的機率一樣。所以它需要無限的時間。

AI 做了什麼不同的事? 它不是純隨機。上一篇我們講過,AI 的每一次預測都基於前面所有的上下文。它學過人類的語言模式,所以它知道「T」後面接「h」的機率遠高於接「z」。

換句話說,AI 不是用無限的時間去碰運氣,而是用訓練資料裡學到的規律,大幅縮小了每一步的可能性範圍。猴子面對的是整個鍵盤,AI 面對的是一個經過篩選的、有權重的選項清單。

我們可以這樣對照:

猴子靠無限的時間來覆蓋所有可能性。AI 用海量的訓練資料取代了那個無限時間——它不需要自己隨機碰撞,因為人類幾千年來的書面產出,已經替它把大部分的「正確組合」展示過了。

猴子只有一隻,所以需要很久。AI 有幾千億個參數同時在運作,每一個參數都在幫忙縮小選擇範圍,就像同時有幾千億隻「受過訓練的猴子」在協作。

猴子的每一次敲擊完全隨機。AI 的每一次預測都經過 attention 機制的加權——它會「看」前面的上下文,判斷哪些資訊跟當前的預測最相關,然後把注意力集中在那些地方。

猴子沒有偏好,什麼都敲。AI 經過 RLHF 調整,機率分佈已經偏向人類認為「好」的方向。

四個差異疊在一起,結果就是:猴子需要無限時間才能碰巧做到的事,AI 在幾秒內就能做到。不是因為 AI 「懂」,而是因為它面對的不再是純粹的隨機,而是一個被大幅壓縮過的機率空間。

那個「像那回事」的門檻

到這裡,我們可以回答開頭的問題了:為什麼 AI 能接得這麼像那回事?

答案是:不是因為它產生了什麼新的能力,而是它的機率覆蓋面,密集到了一個程度,讓輸出在人類的感知上跨過了「像那回事」的門檻。

你可能聽過一個詞叫「湧現(Emergence)」——當模型規模大到某個程度,突然就「會」做一些小模型做不到的事。翻譯、寫程式、邏輯推理,這些能力看起來像是在某個臨界點突然出現的。

但如果你理解了上面的猴子比喻,你會注意到另一種可能的解釋:這些能力可能不是「突然出現」的,而是一直都在那裡——只是在小模型的時候,機率覆蓋面不夠密,命中率太低,低到你不覺得它「會」。當模型變大、參數變多、訓練資料變廣,覆蓋面終於密到一個程度,命中率跨過了你的感知門檻,你就覺得它「突然會了」。

打個比方:想像你在一片空白的牆上隨機噴點。點很少的時候,你什麼都看不出來。但隨著點越來越密,某個瞬間,你突然認出了一張臉。那張臉不是在某一個點被噴上去的時候「出現」的,它是在點的密度跨過你的辨識門檻時,被你「看見」的。

AI 的湧現,或許就是這件事。不是能力的誕生,是密度的跨越。

當然,我要誠實地說:這是我個人的觀點,不是學術界的定論。關於湧現的本質,學界目前沒有共識。有些研究者認為湧現是真實的新能力出現,有些則認為是測量方式的問題。我傾向用上面的方式理解它,但你可以有自己的判斷。

當機率覆蓋不到的時候

理解了這個邏輯,你就能理解 AI 為什麼會「出錯」。

如果 AI 的能力來自機率覆蓋面的密度,那麼在覆蓋面稀疏的地方,它就會不可靠。

想像 AI 的知識像一張地圖。訓練資料多的領域,地圖畫得很細緻——每條路、每棟建築都標得清清楚楚。訓練資料少的領域,地圖就很粗糙——只有大概的輪廓,細節是模糊的。

當你問 AI 一個常見問題,它等於是在地圖細緻的區域導航,答得又快又準。但當你問一個冷門問題、或者一個需要跨領域組合的問題,它就進入了地圖模糊的區域。

這時候會發生什麼?它不會停下來說「我不知道」。記得嗎——它是接龍。它的任務是預測下一個最可能的 token。即使在模糊的區域,它還是會選一個機率最高的選項輸出。

問題是,在模糊區域裡,「機率最高」不代表「正確」。它可能會把不同領域的資訊混在一起,產生一個看起來合理但實際上不存在的答案。這就是人們常說的「幻覺(Hallucination)」。

它不是在「編造」——它沒有編造的意圖。它只是在機率覆蓋不夠密的地方,依然按照同樣的機制在運作。在密的地方,這個機制產出正確答案;在疏的地方,同樣的機制產出錯誤答案。機制沒變,變的是地圖的精度。

結語

回到最初的問題:AI 為什麼能接得這麼像那回事?

不是因為它理解了什麼,是因為它用海量的訓練資料、幾千億個參數、attention 機制的聚焦、RLHF 的偏好調整,把猴子的純隨機壓縮成了高度集中的機率預測。當這個預測的覆蓋面密到一定程度,人類就覺得它「會」了。

而當覆蓋面不夠密的時候,同樣的機制就會產生幻覺——不是因為它「想騙你」,是因為它在地圖模糊的地方,還是按同樣的方式在走路。

知道了這個,你就能更清楚地判斷:AI 在什麼領域可靠、什麼領域該保持警覺。地圖越詳細的地方越可信,越模糊的地方越需要你自己把關。

下一篇,我們來聊聊另一個你可能在意的問題——AI 的行為,為什麼有時候會「不受控」?