當 Anthropic 把他們的模型命名為「Claude」時,這其實不是一個單純的品牌選擇,而是一種非常明確的致敬。致敬的對象,就是 Claude Shannon(克勞德·香農)。

但更重要的是,這個名字背後隱含著一個判斷:今天的 AI,仍然建立在香農當年定義的世界之上。在Claude Shannon之前,資訊並不存在

在 20 世紀中葉之前,通訊更像是一門經驗科學。電話會有雜訊,訊號會失真,工程師只能不斷試錯與調整。沒有人真正知道訊息能不能被完美傳送,也沒有人知道系統的極限在哪裡。

這一切在 1948 年被改變。香農在 Bell Labs 發表了 A Mathematical Theory of Communication,把通訊從工程問題,提升為一個可以被精確描述的數學問題。

他做的第一件事,是重新定義「資訊」。透過 Information entropy,他將資訊理解為「不確定性」。越難預測的訊息,資訊量越大;越規律的訊息,就越容易被壓縮。

這個定義的關鍵不在公式,而在於一個轉變:資訊從此不再是抽象概念,而是可以被量化、被計算,甚至被設計的對象。

如果把這篇論文拆開來看,它其實做了三個非常關鍵的動作。

- 建立了一個統一的通訊模型。任何系統,都可以被抽象為訊息來源、編碼器、通道、解碼器與接收者。從電話到網路,甚至今天的 AI,都可以放進這個框架。

- 證明了資料可以被壓縮,而且存在理論極限。這就是為什麼我們今天能夠用極小的空間儲存音樂與影像,所有壓縮技術,本質上都在逼近這個界線。

- 證明在有雜訊的環境中,資訊仍然可以被幾乎無錯誤地傳輸。關鍵不在於消除雜訊,而在於設計正確的編碼方式。

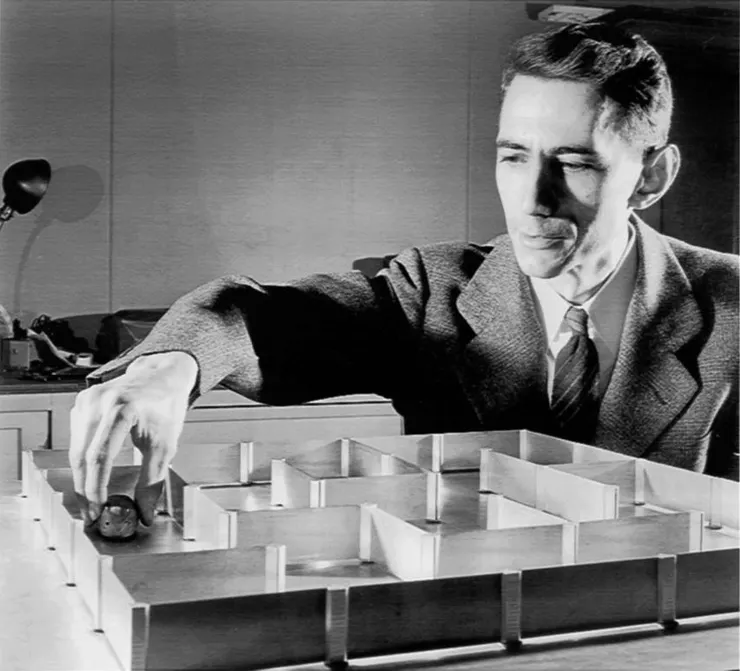

電子老鼠與 AI 的最早原型

Claude Shannon 的影響力不只停留在通訊與電路,他對機器是否可以學習也有非常早期的實驗。他打造了一隻可以走迷宮的電子老鼠 Theseus。

這個裝置第一次會不斷試錯,但只要走過一次,就能記住路徑,之後直接選擇最短路線。這裡其實已經包含了現代 AI 的幾個核心概念。系統能夠儲存狀態,能夠根據經驗更新行為,並在環境中做出更有效率的決策。

這不是深度學習,但它已經清楚展示了機器的行為,可以透過資訊的累積而改變。

為什麼 AI 會用 Claude 這個名字

回到今天,Anthropic 將模型命名為 Claude,其實是在傳達一個非常清楚的立場。AI 並不是從深度學習開始,也不是從大模型開始。它的根源,是資訊理論。

當模型在訓練時,本質上是在學習機率分布,也就是在處理不確定性。當模型生成內容時,本質上是在壓縮與重建資訊。當我們談 scaling law,本質上也是在討論資訊密度與計算資源之間的關係。

換句話說,今天 AI 所面對的問題,本質上仍然是香農當年提出的問題。

AI 的核心,不只是算力,而是資訊

香農留下來的是一種思考方式,當你面對一個複雜系統時,可以先問三個問題

- 這個系統在處理什麼資訊

- 資訊的瓶頸在哪裡

- 理論上的極限是什麼

這三個問題,幾乎可以套用在半導體、AI,甚至投資市場。AI 並不是突然出現的革命,而是資訊理論在 70 年之後的自然延伸。而我們現在看到的每一個模型,其實都還站在 Claude Shannon 當年畫出的那條邊界之內。