前言

自從 2022 年 ChatGPT(當時版本為 GPT-3.5)推出以來,大型語言模型(LLM)的參數量與訓練文本資料量持續增加。特別是從 GPT-4 開始,其對問題的理解力與回覆品質已達到足以應用於日常工作的水準。此外,LLM 所生成的程式碼品質也不遜於一般中高水準的工程師,甚至考量到生成速度後,實際表現可能更優異。

我因想了解 LLM 的運作原理而自學相關內容。本文將閱讀支撐 GPT 系列 LLM 的基礎架構——Transformer 架構的原始論文,並聚焦於其中最核心的要素之一:Attention 機制(中文多譯為「注意力機制」)。如今,幾乎所有的 LLM(如 ChatGPT)都建構在 Transformer 架構之上。Transformer 是於 2017 年發表的論文《Attention Is All You Need》[1] 中首次提出的。在那個時期,生成式 AI 是從以深度神經網路(DNN)應用於機器翻譯的研究中發展出來的。論文標題中的 “Attention” 一詞,正是指 Attention 機制——作者發現,相較於傳統的遞迴式神經網路(RNN),引入 Attention 後能顯著提升翻譯品質。

本文原本想完整介紹 LLM 的運作原理,但內容過於龐大,因此本文僅聚焦Transformer 架構中的 Attention 機制。也因此,從「輸入文字 → 分詞(Tokenization)→ 轉換成嵌入向量(Embedding)」的前處理流程將略過,直接從「Token 嵌入向量」開始說明。

本文適合具備基本線性代數與神經網路概念的讀者閱讀。

關於用語的補充

一般提到 AI(人工智慧) 時,泛指所有與智慧型系統相關的技術範疇。本文為了明確區分,將如 ChatGPT 這類能訓練大量文字、理解並生成自然語言的神經網路,稱為 LLM(Large Language Model,大型語言模型),並與 AI 作區別。

Transformer 原始論文概要

在《Attention Is All You Need》一文中,作者提出了以 Attention 機制為核心 的 Transformer 架構。後來的 GPT(Generative Pre-trained Transformer)即是以Transformer 的 解碼器(Decoder)部分 為基礎設計,用於需要生成文字的任務。該論文共有七章,包含參考文獻約 15 頁,閱讀難度適中,建議對此領域有興趣者可親自閱讀。

論文中的主要內容摘要

- 傳統的序列轉換模型多基於複雜的遞迴式或卷積式神經網路,而 Transformer 是一種完全以 Attention 為基礎、去除了遞迴與卷積結構的新型架構。

- Transformer 透過 Attention 機制捕捉輸入與輸出之間的長距依賴關係,並達成高效並行運算。作者僅用 8 張 P100 GPU 訓練 12 小時,即達到當時翻譯品質的最佳水準。

- Self-Attention(自注意機制)可關聯序列中不同位置的資訊,用於閱讀理解、摘要生成、語意推理等任務。

- Transformer 是首個僅依賴 Self-Attention,而不使用 RNN 或 CNN 的序列轉換模型。

Transformer 架構概述

Transformer 採用「編碼器(Encoder)」與「解碼器(Decoder)」結構。例如將英文句子 “This is an example” 翻譯成德文 “Das ist ein Beispiel”:

- 編碼器(Encoder):將輸入文字轉換成對應的嵌入向量(Embedding)。

- 解碼器(Decoder):根據已翻譯部分(如 “Das ist ein”),逐步生成下一個字(“Beispiel”)。

為什麼要用 Self-Attention?

在論文第 4 章中,作者說明了 Self-Attention 的動機與計算優勢,並與 CNN 進行比較。其一大優點是:Self-Attention 具備可解釋性(Interpretability)。不同的注意力頭(Attention Head)傾向捕捉不同層次的語法或語意結構,這讓模型不僅能學習上下文關係,也能展現語意層面的理解。

Transformer 與 GPT 架構的差異

GPT 架構僅採用 Transformer 的 Decoder 部分,不包含 Encoder。

模型會在每次迭代時產生一個新字,並將其作為下一次的輸入。

Attention 機制是什麼?

簡單來說,Attention 機制 是讓模型在處理輸入 Token 嵌入時,考慮上下文關係的方式。以句子 “Your journey starts with one step” 為例,「journey」的語意會根據上下文改變:

- 若搭配 “travel”,是「實際旅程」;

- 若搭配 “one step”,則是「人生旅程」。

模型透過 Attention 來「關注」這些關聯,進而判斷詞義。

Attention 的數學基礎

Attention 的核心計算是 Query 與 Key 向量的內積(dot product),代表兩者的相似程度。再經過 Softmax 正規化,得到對每個 Token 的「注意力分數(Attention Score)」。最後將各 Token 的 Value 向量 按權重加總,形成 Context 向量,代表該詞在整句中的語境意義。

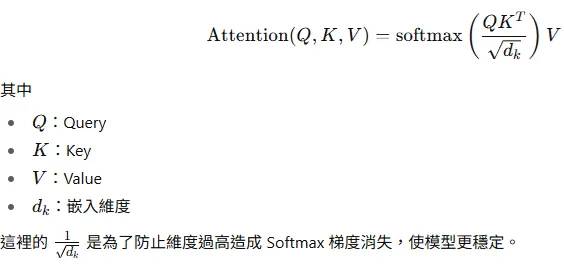

Scaled Dot-Product Attention(縮放點積注意力)

實際論文中的 Attention 計算採用「縮放點積注意力」:

這裡的 frac{1}/{sqrt{d_k}} 是為了防止維度過高造成 Softmax 梯度消失,使模型更穩定。

Multi-Head Attention(多頭注意力)

Transformer 並非僅使用一組 Attention,而是同時並行多組 Scaled Dot-Product Attention。這讓模型能從不同的語意角度關注資訊,進而提升準確度。

Masked Attention(遮罩注意力)

在 Decoder 階段,模型需要「自回歸(Autoregressive)」地生成文字。因此,當模型預測下一個字時,只能關注當前與過去的 Token,而不能偷看未來的字。 這透過在Attention 中加入 遮罩(mask) 實現。

總結

本文透過回顧 Transformer 架構與 Attention 機制,說明了 LLM 理解與生成語言的核心原理。GPT 類模型雖僅使用 Transformer 的 Decoder,但其高效語境建模能力正是來自 Attention 機制,使模型能夠在生成回覆時理解輸入文字的深層語意。

結語

新技術在普及過程中,往往伴隨過度期待與資訊雜訊。如同當年的區塊鏈熱潮,生成式 AI 的討論也混雜著理性與炒作。 唯有理解技術的原理,才能在評估其應用潛力與限制時保持清醒。Transformer 與 Attention 的出現,為當代 LLM 奠定了基礎。理解它們的結構,不僅有助於掌握生成式 AI 的本質,也能在技術浪潮中找到屬於自己的觀點與方向。

參考文獻

- Vaswani, A. et al. (2017). Attention Is All You Need. https://arxiv.org/abs/1706.03762

- Raschka, S. (2024). Build A Large Language Model (From Scratch). Manning Publications. ISBN: 978-1633437166