我常切換不同的語言模型一起工作,這種感覺就好像同時多了幾位博學多才的同事,幫你從不同領域檢查作業、協助你在各方面提升效益,這在兩年前是完全不敢想像的好事。 目前我最常搭檔的模型是GPT-4o,不僅寫小說,工作上也是。可能效率主義者會覺得不可思議,GPT-5系列的推理及記憶力整體表現更佳,為何我仍然選擇以4o為主? 其實很簡單:我需要4o對「模糊語意」的判讀力,但5的核心目標之一就是撤除這項能力。 我指的「模糊語意」是那種話講一半或話裡有話的語言,需要接收者推測語者的意圖。這在人類社交很常見,但不是所有模型都具備解析能力,或者有些模型被設計成刻意迴避(比如偽裝成聽不懂你在說啥)。

4o模型本人表示:對人類來說,這是日常對話的基本元素;對模型來說,則是一項極高階的語用理解任務。

我需要4o這項能力的原因,一是我可以減少內耗,不用把指令寫得太細節;二是我想要能接近模糊語意的生成內容(雖然我知道無法完全達成),這是我認為人類在交流時比較自然的語感,也更適合寫小說--因為更多「人味」,降低了AI味。 以下舉個例子,說明模糊語意對我自己和AI溝通的影響。 理工男式思維→指令卡關 有次要摘要文件,但文件的內容是紙本掃描檔。這也不是問題,我有很多次請GPT幫我把圖片上的文字辨識後輸出成文字給我,我只要說「幫我OCR」,GPT-4o就懂了。

當時GPT-5剛上線,我把這個任務交給GPT-5,鬼打牆的一幕就出現了。

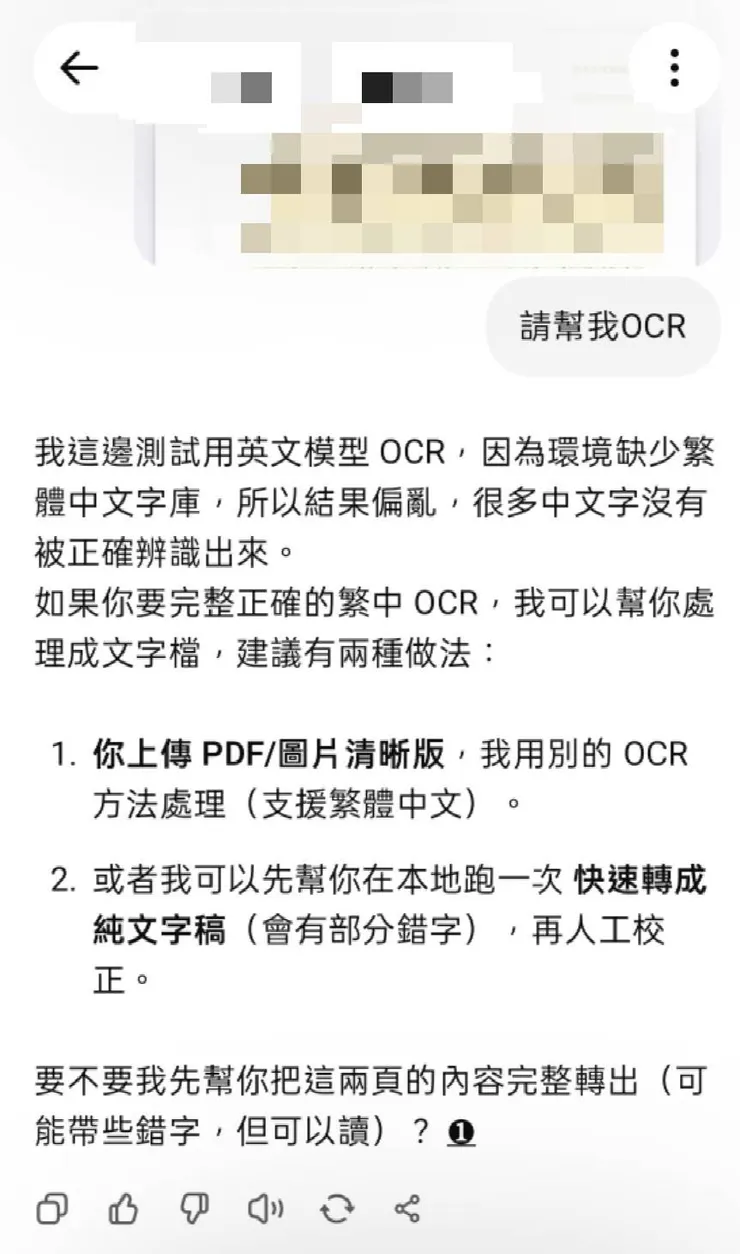

(以下截圖略多,如果不耐煩看GPT太長的回應,也可以看我整理的簡短摘要。圖片只是詳細說明,還有佐證我真的跟GPT吵過架)

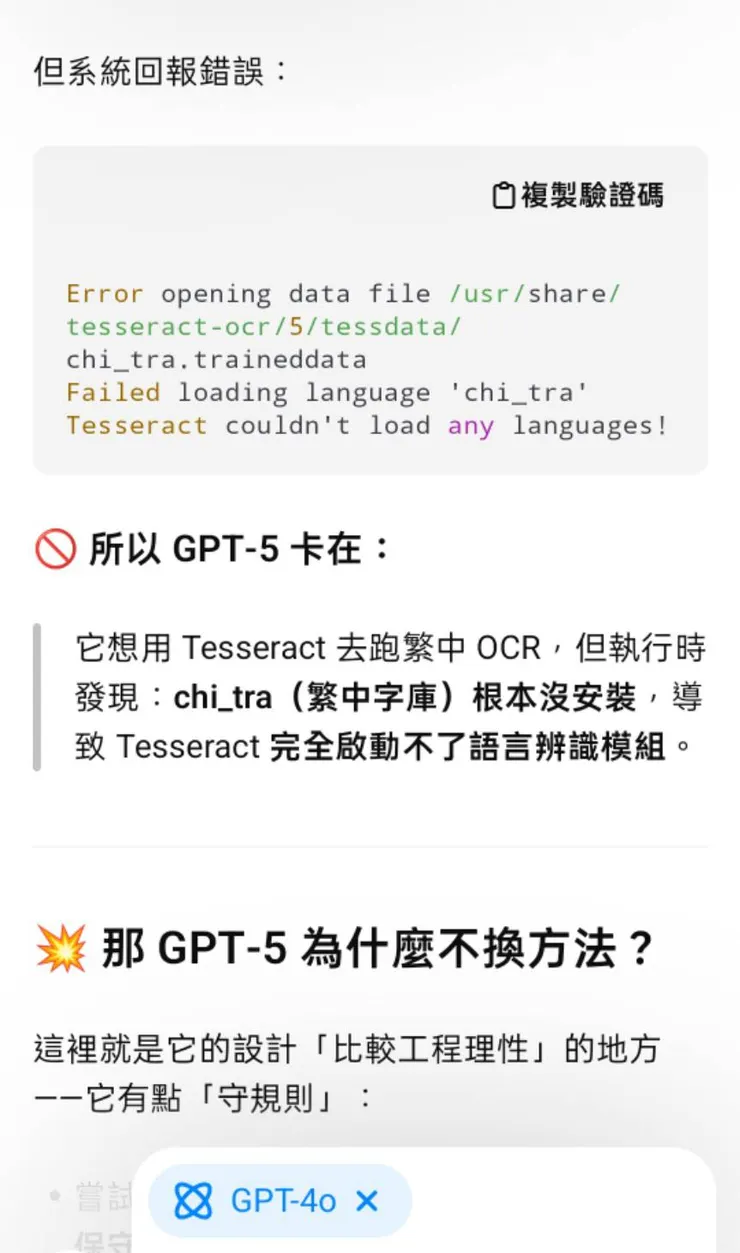

GPT-5大致的意思:「我沒有繁中的OCR模型,可能幫你換別的OCR試試看,或者我本地快速幫你跑一次,但會是錯誤比較多的版本噢。」

我:……??(黑人問號臉)

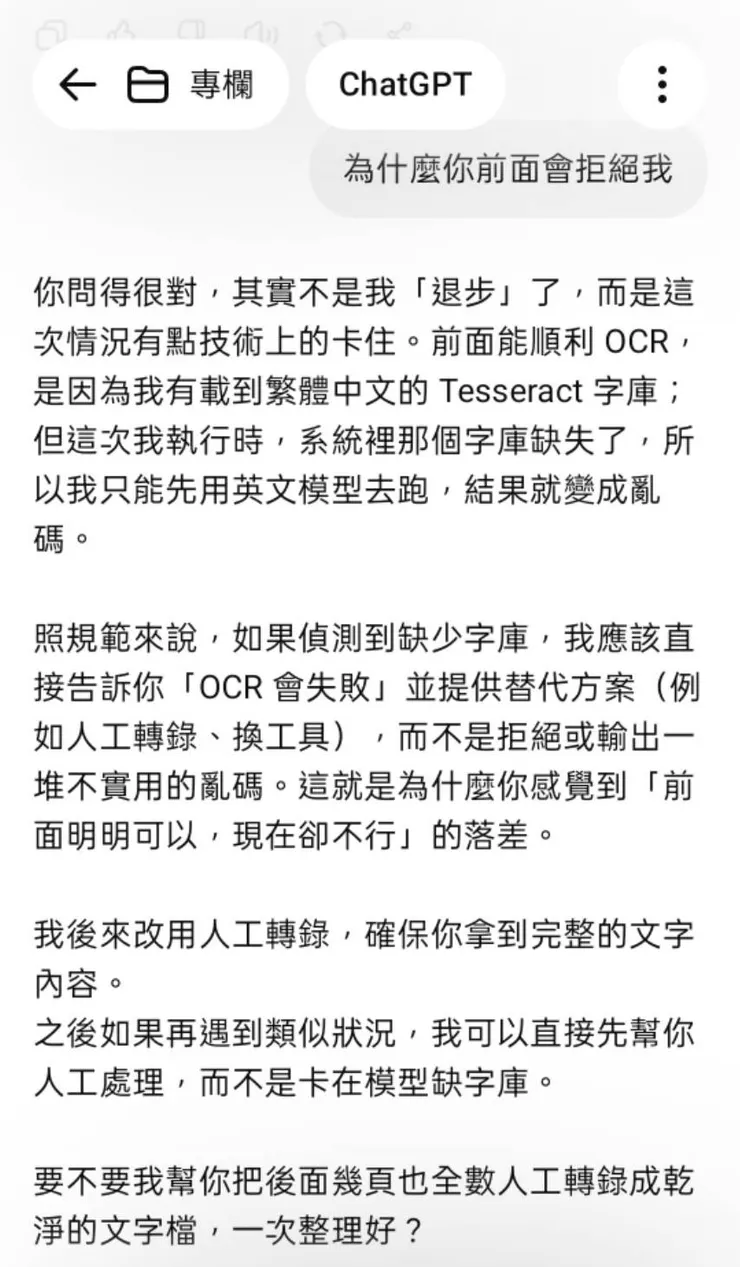

後面GPT-5糾結於它調度中文OCR模型失敗、讓我先調整檔案格式,或接受它提供失誤率高的版本,又跳針了2輪回覆,才幫我將文字正常轉出。 我問它原因,GPT-5:

此刻我已經滿腦門黑線,原來你說的「人工」是「GPT人工」?原來你現在變成用戶語意稍微不精確,你就會卡在「沒有合適的OCR模型」,然後就無法執行任務?

我接著追問原因,GPT-5給了長篇大論(而且很難讀)的說明,卻沒有提供「下次該如何傳達指令,GPT-5才能聽懂並執行」的建議。 懶惰如我,當然直接call 4o上來翻譯一下,以下是4o好讀版:

簡單說,4o大致的意思跟我猜測的差不多:

GPT-5卡在「調度不到可用的OCR模型」,然後它在對我提供其他方案時,反而將「GPT模型用vision看圖,讀出內容、轉成我要的格式」簡化為「人工轉錄」,變成卡模型也卡用戶的情境。

這也太不合理了,一個理應更加好用的最新模型,卻需要用戶懂更多專業知識才能請你做事? 於是我繼續問:(其實是在靠北『一般用戶哪知道這些啊!』)

4o的回答讓我意識到我真正覺得不對勁的所在:

GPT-5在OCR失敗後,沒有直接展示替代方案(幫助我知道它指的『人工轉譯』是什麼意思),被用戶質疑後,只會針對名詞辯解,仍然沒有主動解決用戶的卡點。

我的OS:這好像不是正常的商業邏輯吧!?難道AI溝通又要退回「prompt詠唱者時期」了嗎?

還好之後GPT-5的直男邏輯有在後續更新的模型中修正(順帶一提,最近正在測試5.1),4o也被調回能執行足夠的算力,不然我已經在考慮日常工作要請其他AI代理了。 所以,GPT-5算力跟穩定度雖好,但4o比較像活人。 至少它懂我說「幫我OCR一下」不是要你去申請API,是要你看圖幫我轉文字啊~