是的,很多 AI 研究者在 2023 年之後開始討論一個問題:

AI 公司已經開始面臨「高品質訓練資料快被用完」。這不是說「網路沒有資料了」,而是可用來訓練高品質大型語言模型(LLM)的資料正在接近上限。許多 AI 公司(如 OpenAI、Google、Anthropic)都在研究如何解決這個問題。

下面是原因。

1️⃣ 高品質文字其實沒有想像中多

整個網路雖然有數千億頁內容,但真正適合訓練 AI 的資料需要:

- 可讀性高

- 不含垃圾內容

- 不含大量重複

- 不含廣告或SEO垃圾

研究者估計:

整個網路資料 ≈ 數百TB

真正高品質資料 ≈ 10–20TB

因此當模型越來越大時,很快就會把這些資料「學完」。

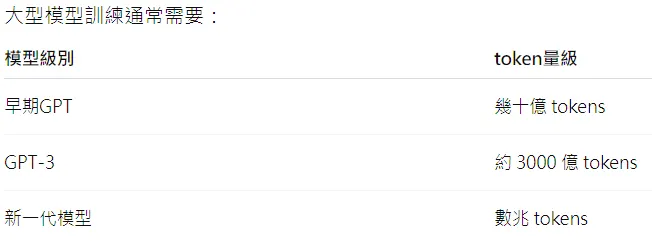

2️⃣ 大模型需要極大量資料

大型模型訓練通常需要:

資料需求成長非常快。

例如:

GPT-3 的訓練資料就已經包含:

- Common Crawl

- Wikipedia

- 書籍資料

- 網路論壇

幾乎把公開資料掃過一遍。

3️⃣ 網路正在被 AI 生成內容淹沒

2023 之後出現一個新問題:

AI生成內容大量出現在網路上。

例如:

- AI寫的文章

- AI生成SEO網站

- AI生成新聞摘要

如果新的模型再用這些資料訓練,就會出現問題:

「模型退化」(Model Collapse)

意思是:

AI → 生成內容

新AI → 再學這些內容

品質逐代下降

這是 AI 研究界很關注的問題。

4️⃣ 很多高品質資料開始被「付費牆」保護

AI 爆紅後,很多內容平台開始限制資料。

例如:

- Reddit 開始收取資料授權費

- The New York Times 對 AI 公司提起訴訟

- 各大出版社限制爬蟲

因為:

內容平台發現 AI 公司正在使用他們的資料。

5️⃣ 一些研究預測資料可能在 2030 前耗盡

一些研究者曾提出預測:

- 高品質人類文字資料

- 可能在 2026–2032 年之間被「用盡」。

意思不是沒有資料,而是:

可用的新高品質資料成長速度

<

AI模型資料需求

6️⃣ AI 公司正在找替代方案

目前主要有幾個方向:

① 合成資料(Synthetic Data)

用 AI 生成資料來訓練 AI。

例如:

- 模型生成問題

- 模型再生成答案

- 人類做品質篩選

② 多模態資料

不只使用文字,還用:

- 圖片

- 影片

- 語音

例如:

- GPT-4

- Gemini

都是多模態模型。

③ 人類標註資料

雇用大量人類:

- 審查回答

- 評分

- 編寫訓練資料

這就是 RLHF(人類回饋強化學習)。

④ 使用程式碼資料

程式碼是:

高結構

低歧義

邏輯性強

因此像 Microsoft 和 OpenAI

都大量使用 GitHub 的資料。

🧠 一句話總結

AI 資料危機的核心是:

高品質人類知識產生速度 < AI 模型訓練需求。

因此未來 AI 發展很可能會轉向:

- 合成資料

- 多模態資料

- 專門建立的新資料庫