文/AI 定責專家

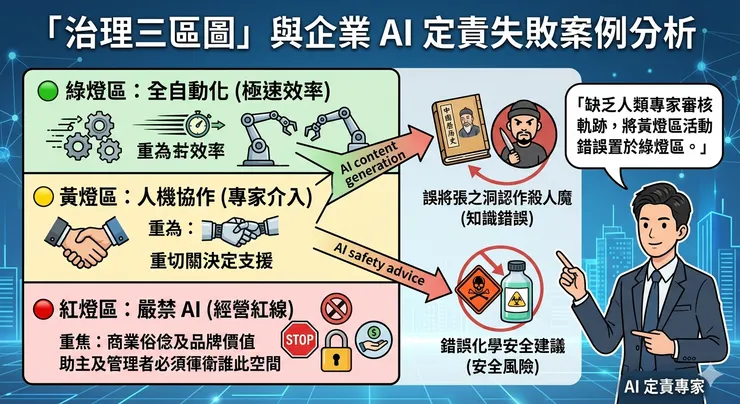

2024 年 8 月,在北京舉行的互聯網安全大會上,資安巨頭 360 集團本欲展示其 AI 產品的「安全防禦」實力。然而,這場發布會最終卻演變成一場公關災難。當 AI 煞有其事地宣稱清末名臣張之洞是「連環殺人魔」,甚至判定「水(H2O)具有劇毒」時,全場的笑聲背後,其實隱藏著所有企業主最深層的恐懼。

大眾看的是笑話,但站在董事會與法務部的視角,這是一場典型的「治理失控」場景。

技術的「黑盒」,不能成為合規的「盲區」

長期以來,許多老闆對 AI 的期待存在一個誤區:只要技術夠強、算法夠深,風險就會自動消失。但 360 的案例告訴我們:技術再強的公司,只要缺乏「治理邊界」,AI 就是一個不定期炸彈。

所謂的「AI 幻覺(Hallucination)」並非單純的軟體錯誤(Bug),它是大語言模型與生俱來的特性。當 AI 在處理歷史事實或安全 SOP 時,它並不具備「道德感」或「常識感」。如果企業僅追求導入速度,而未在研發前端進行「權責定性」,那麼 AI 的每一次產出,都在賭博——賭它不會毀掉公司累積數十年的商譽,賭它不會引發巨額賠償。

法律與經營的防禦:誰是最後的「定責人」?

對於法務長(CLO)而言,這起事件最驚悚的啟示在於:當 AI 給出「水有毒」的建議導致意外時,現有的法律合約能否保護董事會?

根據即將施行的《AI 基本法》精神,企業必須證明其對 AI 應用具備「實質的人類監控」。如果 360 在產品設計初期就導入「治理三區圖」,將涉及安全建議與歷史事實的輸出歸類為「黃燈區(人機協作)」,並留下專家覆核的證據鏈,那麼這起災難就不會發生。

當企業無法回答「誰該為 AI 的錯誤負最終責任」時,這份責任往往會自動向上穿透,直接由經營者承擔。這就是所謂的「責任真空」。

從「衝動冒險」回歸「理性治理」

在 AI 的競爭中,速度固然重要,但「治理」才是那根保護繩。企業主需要的不再只是技術開發者,而是一位能定義邊界、劃清權責、並建立免責防火牆的「AI 定責專家」。

我們必須意識到:AI 導入前的治理診斷,不是為了阻礙創新,而是為了確保當您的企業攀向數位高峰時,腳下踩著的是堅實的證據鏈,而非虛無的幻覺。