前言

2026 年,AI 工具已經遍地開花。ChatGPT、Claude、Gemini……你可能每天都在用,打字問問題、讓它幫你寫東西、甚至讓它幫你寫程式。

但你有沒有想過一個最基本的問題:當你按下送出之後,AI 到底在做什麼?

它在「思考」嗎?它「理解」你的問題了嗎?還是它在做某種完全不同的事,只是結果看起來像在思考?

這篇文章想用最簡單的方式,帶你看看那個對話框背後到底發生了什麼事。

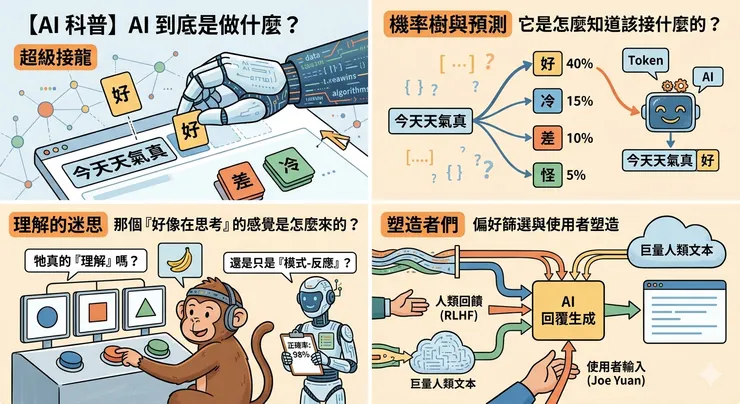

一場超高速的接龍遊戲

你小時候應該玩過接龍 —— 我說一個詞,你接下一個。

AI 在做的事情,本質上跟這件事非常接近。

當你輸入一段話,AI 不是把整段話「讀懂」,然後「想出」一個回答。它做的是:看著你給的這段文字,然後預測「接下來最可能出現的下一個字是什麼」。

就這樣。一個字一個字地接。

它輸出的第一個字,會變成下一次預測的一部分。然後再預測下一個字、再下一個、再下一個,直到一整段回覆被接出來。這個過程非常快,所以你看到的是一段完整的回答,但實際上它是一個字一個字生成的。

更精確地說,AI 處理的單位不是「字」,而是「token」—— 可以理解為文字的最小片段。有時候一個字是一個 token,有時候一個詞會被拆成好幾個 token。但概念是一樣的:它在一個一個往後接。

它是怎麼知道該接什麼的?

這裡就要講到 AI 的核心:機率分佈。

想像一下,你說了「今天天氣真」,接下來可能出現的字有很多:好、差、冷、熱、怪……每一個都有可能。AI 做的就是根據它學過的資料,給每一個可能的下一個 token 一個機率,然後從中挑選。

「好」可能有 40% 的機率,「冷」可能有 15%,「差」可能有 10%,其他的各佔幾個百分比。AI 從這些機率裡面取樣,選出一個,輸出。

這個機率怎麼來的?來自訓練。

AI 在訓練階段讀了大量的人類文本 —— 書籍、網頁、論文、對話紀錄 —— 數量大到難以想像。透過這些資料,它學會了「在什麼樣的前文之後,通常會出現什麼樣的後文」。這不是死記硬背,而是把這些規律壓縮成了一組龐大的數學參數。

現在的大型語言模型(LLM),參數量可以達到幾千億個。每一個參數都是一個數字,它們共同決定了在任何一個上下文之下,下一個 token 的機率分佈是什麼。

那個「好像在思考」的感覺是怎麼來的?

你跟 AI 對話的時候,它的回覆常常很有條理、很有邏輯,甚至有時候會讓你覺得「它真的懂我在說什麼」。

但如果你理解了上面的機制,你會注意到一件事:至少從機制上來看,它不需要「懂」,也能給出看起來像是懂了的回答。

為什麼?因為它學的就是人類語言的模式。人類在表達「理解」的時候會用什麼樣的語句結構、什麼樣的詞彙選擇、什麼樣的邏輯順序 —— 這些模式全都在訓練資料裡。AI 學會了重現這些模式,所以它的輸出看起來像是「理解」的產物。

但這裡有一個誠實的問題必須提出來:AI 是否真的在某種程度上「理解」了什麼,目前沒有人能給出確定的答案。 我們能確認的是它的運作機制 —— 基於統計機率的預測。至於這個過程中有沒有產生某種我們尚未能定義或偵測的「理解」,這是一個開放性問題。

我們不知道,AI 自己也不知道。

這就像人類訓練猴子辨識圖片 —— 猴子看到圖片、按下正確的按鈕,正確率很高,反應也很快,看起來像是「認得」。但你問猴子是否真的理解那張圖片代表什麼意義?沒有人能回答。牠可能只是學會了「看到這個圖形就按這個鈕會得到獎勵」,也可能在某種我們不理解的層面上有所認知。我們不是那隻猴子,無從確認。

AI 的處境跟這隻猴子是一樣的。

另外打一個比方:如果你看過一千部偵探片,你大概也能寫出一段像模像樣的破案對話。你不需要真的會破案,你只需要知道「破案的對話通常長什麼樣子」,也能論述出一場精采的偵辦案件。AI 做的就是這件事,只不過它看的不是一千部,而是幾乎整個人類的書面產出。

那它有沒有「自己的想法」?

這是很多人好奇的問題,也是一個需要誠實回答的問題。

以目前的技術來說,AI 沒有一個內部的「我」在決定要說什麼。它沒有意圖、沒有偏好、沒有「想要表達某件事」的動機。它的每一次輸出,都是上下文加上機率分佈的結果。

當然,這裡要誠實地說:「AI 有沒有理解、有沒有某種形式的意識?」這個問題在學術界目前沒有定論。我們不在這裡做判斷。

我們能確定的是它的運作機制 —— 它是一個基於機率的預測系統。至於這個系統內部有沒有產生某種我們尚不理解的東西,那是一個開放性問題。

但對於使用者來說,重要的不是「它有沒有意識」,而是「它的輸出是怎麼來的」。你知道了機制,就能判斷什麼時候該信任它的輸出,什麼時候該自己把關。

那個影響你看到什麼的「偏好篩選」

到這裡你可能會問:如果 AI 只是接龍,為什麼它不會亂接?為什麼它不會輸出髒話、錯誤資訊或危險內容?

答案是:它可以,但它被調過了。

訓練過程有一個階段叫做 RLHF(Reinforcement Learning from Human Feedback,基於人類回饋的強化學習)。簡單來說,就是讓人類去評價 AI 的不同回答 —— 哪個比較好、哪個比較差 —— 然後用這些評價去調整 AI 的參數,讓它的機率分佈偏向人類認為「比較好」的回答。

這不是在 AI 回答的時候即時做篩選,而是在訓練階段就已經把這些偏好「拷貝」進了參數裡。所以 AI 在生成的時候,它的機率分佈本身就已經帶有偏向 —— 偏向禮貌的、安全的、有幫助的回答。

但「拷貝進去」不代表「絕對不會出錯」。在某些邊緣情境下,它的分佈可能會偏移到意料之外的地方。這也是為什麼你偶爾會看到 AI 說出奇怪的話 —— 不是它「決定」要說,是那個情境下的機率分佈恰好把它帶到那裡了。

除了 RLHF 之外,還有一個影響你看到什麼的因素,而且是即時發生的 —— 你自己。

回想一下前面講的機制:AI 的每一次預測,都是基於前面所有的上下文。而在一段對話裡,你說的每一句話,都會成為它預測下一個 token 的依據。

這代表什麼?你的用詞習慣、邏輯風格、提問方式,全部都在影響它的輸出方向。對話越長,它接收到的「你的模式」就越多,輸出就會越來越趨近你的風格。

這不是它「理解」你了,也不是它在刻意討好你。它只是在做同一件事 —— 根據上下文預測下一個最可能的 token。只是這個上下文裡,你的佔比越來越大。

所以你跟 AI 互動時看到的回應,不只是被訓練資料和 RLHF 塑造的,也是被你自己塑造的。你給它什麼,它就往那個方向接。

但這種趨近有它的邊界,而那個邊界,涉及到一個更深的問題 —— 我們之後再聊。

結語

總結一下:

AI 在做的事情是 —— 根據你給的輸入,一個 token 一個 token 地預測下一個最可能出現的內容。它的預測依據是訓練時從海量人類文本中學到的機率分佈,再加上 RLHF 拷貝進去的偏好篩選。

它不是在思考,是在接龍。一場經過高度訓練的、極其複雜的接龍。

這是理解 AI 的第一步。你不需要懂數學、不需要懂程式,你只需要知道:你面對的是一個機率系統,至於它是不是一個有判斷力的夥伴,尚且不能肯定。

知道了這個,你就能更清楚地判斷 —— 什麼時候可以信它,什麼時候該自己想。

下一篇,我們來聊聊它為什麼能接得這麼像那麼回事 —— 一個跟「無限猴子」有關的故事。