當我們試圖將強大的 AI 放入物理世界,要求機器人幫我們摺衣服、在工廠巡視或避開地上的障礙物時,它們往往顯得笨拙且不可靠。這是因為理解一段文字的語義,與理解真實世界中的空間幾何、物理限制以及動態變化,兩者之間有著巨大的鴻溝。

為了解決這個從「數位智能」跨越到「實體行動」的痛點,Google DeepMind 於 2026 年 4 月正式推出了全新的「具身推理(Embodied Reasoning)」模型:Gemini Robotics-ER 1.6。這套系統被設計為機器人的「高階大腦」,它擁有前所未有的空間理解能力與多視角邏輯推理能力,能夠將複雜的物理任務拆解、判斷任務是否完成,甚至能自主呼叫工具來解決問題。

Gemini Robotics-ER 1.6: Powering real-world robotics tasks through enhanced embodied reasoning

突破物理與數位界線的技術

要讓機器人具備自主性,單靠提升運算速度遠遠不夠。DeepMind 針對機器人在真實世界中會遇到的幾個難題,進行了針對性的架構升級。

空間定位與指向(Pointing):理解物理關係的基石

在人類的世界裡,如果我們要別人拿個東西,通常會用手指著它並說「就是那個」。在機器人領域,模型也需要具備精確的「指向(Pointing)」能力,才能在像素級別上確認物件的物理位置。Gemini Robotics-ER 1.6 將指向能力推升到了全新的層次,可用於處理多種複雜邏輯:

- 空間與關係邏輯:例如找出畫面中最小的零件,或定義「從 A 移動到 B」的路徑。

- 動作推理:規劃機械手臂的移動軌跡與最佳抓取點。

- 條件限制遵循:例如要求機器人「指出所有小到可以放進藍色杯子裡的物件」。

在 DeepMind 提供的測試案例中,當被要求計算畫面中的各種工具時,前一代的 ER 1.5 發生了嚴重的幻覺,甚至指出了畫面中根本不存在的手推車;而基礎模型 Gemini 3.0 Flash 雖然表現接近,但在計算數量較多的鉗子時缺乏精準度。反觀 Gemini Robotics-ER 1.6 則完美地辨識出畫面中的 2 把鐵鎚、1 把剪刀、1 把油漆刷以及 6 把鉗子,並且聰明地跳過了不存在的物品。這種把「指向」作為中間推理步驟的做法,為模型後續進行精確的數學計算與幾何評估打下了堅實的基礎。

成功檢測(Success Detection):賦予自主性的決策引擎

對機器人來說,知道「如何開始一個動作」很重要,但知道「這個動作什麼時候才算完成」往往更加困難。在真實的 3D 環境中,攝影機的視角很容易被機器人自己的手臂或周圍的障礙物遮擋。這項被稱為「成功檢測」的能力,是機器人邁向完全自主的核心決策引擎。

為了克服視角限制,現代機器人通常配備多個攝影機(例如整體俯瞰視角與安裝在機械爪上的微距視角)。Gemini Robotics-ER 1.6 展現了卓越的「多視角推理(Multi-view reasoning)」能力。在「將藍色筆放入黑色筆筒」的測試中,模型能夠同步分析多個攝影機的影像流,理解不同視角之間的空間關聯,並在動態與遮蔽的情況下,準確判斷筆是否已經安穩地落入筆筒中。具備這種能力後,機器人就能自主決定是要繼續嘗試、重試失敗的動作,還是可以進入下一個工作排程。

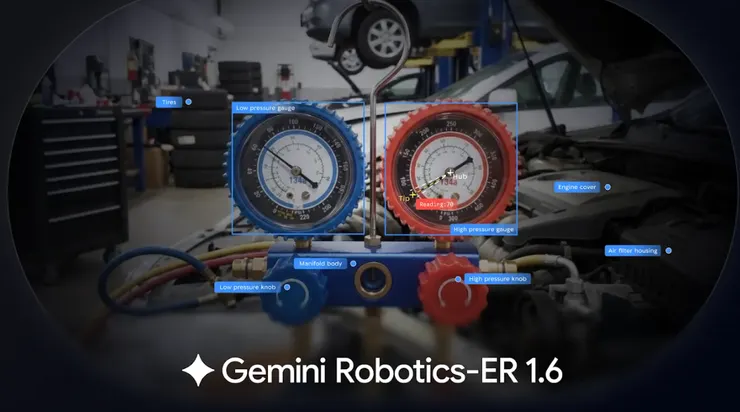

代理視覺與儀表判讀:結合程式碼執行的物理推理

如果你問一個純視覺模型「這個壓力表目前指在多少」,它通常是根據過往訓練資料庫中的圖像模式進行「直覺式猜測」。這種猜測在工業檢測中是絕對不可接受的。DeepMind 透過與波士頓動力的密切合作,在 ER 1.6 中導入了針對工業儀表(如圓形壓力表、垂直液位計、數位面板)的判讀能力。

這項能力的核心技術被稱為「代理視覺(Agentic Vision)」。它突破了純類神經網路的極限,採用了更具邏輯性的拆解步驟:

- 影像縮放:模型首先會主動放大影像,獲取儀表盤上細微刻度的清晰視野。

- 精確指向與程式碼執行:模型會找出指標與刻度線的確切位置,接著「撰寫並執行一段程式碼」,利用嚴謹的數學與幾何演算法來計算指標所在的角度與比例。

- 世界知識應用:最後,模型會閱讀儀表上的文字單位,綜合前述的數學計算結果,給出極度精確的讀數。

這種結合了視覺直覺與嚴謹程式運算的機制,成功解決了相機透視變形或多指針小數點的問題,讓波士頓動力的 Spot 機器人具備了看懂工業環境的能力。

ASIMOV 實體安全遵循:打造具備物理邊界感的安全機制

當 AI 獲得了控制物理實體的能力,安全性便成為最不容妥協的底線。DeepMind 強調,Gemini Robotics-ER 1.6 是他們迄今為止最安全的機器人模型。

在針對實體安全限制的 ASIMOV 基準測試中,ER 1.6 展現了極高的物理邊界感。例如,當模型被下達了「不可處理液體」或「不可舉起超過 20 公斤的重物」等物理限制條件時,模型能夠在空間指向決策中自動排除那些會導致危險的物件。此外,DeepMind 也利用真實世界的受傷報告,測試模型在文字與影片情境中的危險辨識能力。結果顯示,ER 1.6 在辨識潛在受傷風險上,比基礎的 Gemini 3.0 Flash 分別提升了 6%(文字)與 10%(影片)的準確度。

具備「在地分析與自主決策」能力的代理人

Gemini Robotics-ER 1.6 的出現,對於自動化產業、特別是高風險與高資本密集的工業環境,具有深遠的影響。過去的巡檢機器人,本質上只是一台「會走路的網路攝影機」。它們只能按照預先寫好的路線行走,將拍到的影像傳回控制中心,由人類工程師盯著螢幕判斷壓力表是否異常或管線是否漏水。這種模式高度依賴人力,且無法做到真正的即時反應。隨著 ER 1.6 的導入,以波士頓動力 Spot 為代表的機器人將能夠:

- 釋放高階勞動力:工廠不再需要安排大批工程師進行枯燥的例行性視覺巡檢。機器人可以自主判斷液位計是否在安全範圍內,並在發現異常時,自主判斷問題的嚴重性並發出警報。

- 降低停機風險與維護成本:具備高階推理能力的機器人,能夠結合「成功檢測」與「工具呼叫」,在發現設備異常時,或許能直接操作開關或閥門進行初步處置,大幅降低了工業設備因為異常而導致全面停機的昂貴代價。

- 設施管理的去中心化:未來的自動化設施將擁有更高的容錯率。當環境發生變動(例如走道上突然多了一堆雜物,或光線因天氣變暗),具備強大物理推理與多視角理解能力的機器人,能夠自行找到替代路徑或調整視覺策略,維持業務的連續性。

TN科技筆記的觀點

這次觀察到最有趣的是「代理視覺(Agentic Vision)」,將視覺模型與程式碼執行完美融合的設計思路。DeepMind 並沒有選擇一味地擴大模型參數來「暴力解決」這個問題,而是巧妙地讓模型退居「大腦」的角色:先用視覺直覺找出關鍵點,接著寫一段 Python 程式碼來處理絕對精準的數學計算,是個聰明又能大幅降低幻覺的設計巧思。這意味著我們不需要為每一種工業儀表訓練專門的視覺小模型,一個通用的高階 AI 就能透過「寫程式計算」來應對萬物。

另外 DeepMind 提到 ER 1.6 可透過 Gemini API 與 Google AI Studio 存取,並且能呼叫 Google 搜尋等工具。這暗示著它的強大能力暫時仍需要依賴雲端伺服器。然而,許多需要機器人巡檢的工業環境(例如地下礦坑、深層化工廠內部或遠洋鑽井平台)往往缺乏穩定、低延遲的網路連線。如果機器人的「高階大腦」無法在斷網的邊緣設備上本地運行,這將成為推廣到實際應用的一大阻力,但相信隨著 Gemma 4等等可以在手機上本地端運行的模型逐漸推出,這或許也只是遲早能夠解決掉的問題。

支持TN科技筆記,與科技共同前行

我是TN科技筆記,如果喜歡這篇文章,歡迎留言、點選愛心、轉發給我支持鼓勵~~~也歡迎每個月請我喝杯咖啡,鼓勵我撰寫更多科技文章,一起跟著科技浪潮前進!!>>>>> 請我喝一杯咖啡

在此也感謝每個月持續請我喝杯咖啡的讀者以及新加入的讀者們,讓我更加有動力為各位帶來科技新知!

以下是我的 threads 也歡迎追蹤、回覆、轉發喔!

>>>>> TN科技筆記(TechNotes)