在 2026 年 4 月 23 日,OpenAI 正式推出了 GPT-5.5 以及專為高難度任務設計的 GPT-5.5 Pro。這代表著 AI 產業正經歷一次本質上的轉變:AI 正在從「被動回答問題的知識庫」,正式轉變為「能主動規劃、跨軟體操作、並且具備自我除錯能力的虛擬員工」。過去,使用者必須像管理實習生一樣,一步一步地給予明確指令來指導 AI 執行任務;現在,GPT-5.5 已經具備接手混亂、多步驟複雜專案的能力,能夠在過程中自行判斷、使用工具、檢查錯誤,直到任務圓滿完成。這篇文章將帶你深度拆解 GPT-5.5 的核心技術亮點、各項評測數據,以及隱藏在強大能力背後的安全與風險管控機制。

GPT-5.5 懶人包

- 全自動代理能力全面升級:GPT-5.5 在代理型程式編寫(Agentic Coding)、電腦操作與長篇知識工作上展現極高準確度。它能理解複雜的專案脈絡,自行進行除錯、修改並驗證,省去人類逐行確認的時間。

- 極致的算力與效率優化:透過與 NVIDIA GB200 及 GB300 NVL72 系統的深度協同設計,模型在智慧大幅提升的同時,仍維持與前代 GPT-5.4 相同的延遲速度(Latency),並顯著減少了 Token 的消耗數量。

- 成為科學研究的實體夥伴:在基因數據分析、生物資訊學與進階數學證明領域,GPT-5.5 展現了「協同科學家」的能力,能將原本需要數個月的實驗室資料分析縮短至數分鐘。

- 嚴密的網路安全防禦:伴隨強大能力而來的是潛在的高風險。OpenAI 為此導入更嚴格的防護機制,並推出「網路安全受信任存取計畫」(Trusted Access for Cyber)。

- 完善的 API 與企業定價佈局:模型已向 Plus、Pro、Business 與 Enterprise 用戶開放。API 定價方面,GPT-5.5 為每百萬輸入 Token 5 美元、輸出 30 美元;精準度更高的 GPT-5.5 Pro 則為輸入 30 美元、輸出 180 美元。

GPT-5.5 到底強在哪裡?

軟體工程的典範轉移:全自動代理的程式編寫能力

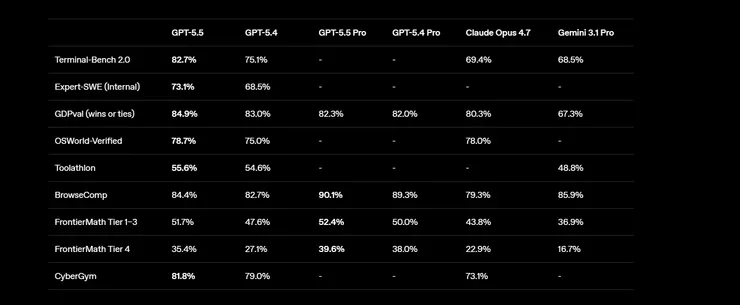

GPT-5.5 是 OpenAI 迄今為止最強大的代理型程式編寫模型,這對軟體工程師而言是開發流程的根本性改變。在測試複雜命令列工作流程、計畫與工具協作的 Terminal-Bench 2.0 測試中,GPT-5.5 達到了 82.7% 的準確率(超越 Claude Opus 4.7 的 69.4%)。而在評估真實世界 GitHub 解決能力的 SWE-Bench Pro 中,GPT-5.5 取得了 58.6% 的成績(Claude Opus 4.7 為 64.3%),能夠在單次執行中端到端地解決大量工作。

更值得關注的是 OpenAI 內部的 Expert-SWE 評估。這項測試包含預估需要人類耗時 20 小時才能完成的長週期編寫任務,而 GPT-5.5 取得了 73.1% 的高分。這說明模型在處理大型系統脈絡、推論模糊錯誤原因以及檢驗假設時,具備了真正的「概念清晰度」。Every 的創辦人 Dan Shipper 測試時,將系統還原至一個複雜的錯誤狀態,前代 GPT-5.4 束手無策,但 GPT-5.5 卻能產出與資深工程師耗時數天思考出完全相同的重構程式碼。

知識工作與日常辦公的深度自動化

代理能力同樣也延伸到了日常的知識工作領域。在職業知識工作評估的 GDPval 測試中,GPT-5.5 獲得了 84.9% 的高分;而在衡量模型是否能自主操作真實電腦環境的 OSWorld-Verified 測試中,也達到了 78.7%。

實務應用上,OpenAI 內部已有超過 85% 的員工每週使用 Codex。舉例來說,財務團隊利用 Codex 審查了超過 24,000 份、總計超過 7 萬頁的稅務表格,不僅自動排除個人敏感資訊,更將整體工作時間縮短了整整兩週。在客服工作流程的 Tau2-bench Telecom 測試中,GPT-5.5 甚至在沒有進行提示詞微調的狀態下,就達到了 98.0% 的驚人準確率。

踏入未知的科學研究邊界

過去的 AI 往往只能回答已知的科學問題,但 GPT-5.5 展現了處理未知領域的龐大潛力。在專注於遺傳學與定量生物學多階段數據分析的 GeneBench 中,GPT-5.5 Pro 獲得了 33.2% 的成績;在真實生物資訊學數據分析的 BixBench 中,則取得了 80.5% 的高分。

最引人注目的案例發生在組合數學(Combinatorics)領域。GPT-5.5 在自訂的測試環境中,協助發現了一個關於拉姆齊數(Ramsey numbers)的新證明,並且該證明隨後獲得驗證。拉姆齊數探討的是一個網路需要多大,才能保證出現某種特定的秩序。這類問題難度極高且進展緩慢,而 GPT-5.5 不僅提供解釋,更給出了具備實用價值的數學論證。

推論效率與硬體協同優化:AI 參與自身建設

性能提升通常會伴隨延遲的增加,但 GPT-5.5 打破了這個慣例。OpenAI 將推理過程視為一個整合系統,與 NVIDIA GB200 及 GB300 NVL72 進行深度協同設計。在這個過程中,AI 甚至親自參與了優化自己的基礎設施。

過去 AI 加速器上的請求會被分割成固定數量的區塊,以平衡計算核心的工作量。然而,靜態的區塊分配缺乏彈性。OpenAI 利用 Codex 分析了數週的生產流量模式,並讓 AI 自行編寫了自訂的啟發式演算法(Heuristic algorithms)來優化工作分區與負載平衡。這項由 AI 自行完成的基礎設施優化,直接讓 Token 生成速度提升了超過 20%。

能力躍進背後的防護網:安全與風險管控

擁有強大能力的同時,如何防止模型被濫用成為關鍵課題。OpenAI 針對 GPT-5.5 進行了多維度的安全測試與機制升級。

破壞性行為防護與資料復原能力

在生產環境基準測試(Production Benchmarks)中,OpenAI 刻意使用極具挑戰性的提示詞來測試模型。GPT-5.5 在抵禦暴力、非法行為、騷擾、極端主義與自我傷害等方面的表現維持在多數達到 0.95 以上的高水準。視覺輸入防護上,針對包含仇恨或自殘的圖文混合輸入,防禦率也高達 0.98 以上。

對於具有電腦操作權限的代理 AI 而言,避免破壞使用者資料是首要任務。在針對意外破壞性行為的測試中,GPT-5.5 在「完美復原」(Perfect reversion,即在長時間操作後能復原自己錯誤的更改)的得分從前代的 0.18 大幅提升至 0.52,學會了在操作中保護使用者的既有進度。

醫療評估的「長度調整機制」

醫療領域的 AI 應用容錯率極低。在 HealthBench 評估中,OpenAI 導入了「長度調整分數(Length-adjusted score)」機制。原因在於,語言模型常常會透過生成極長的回答來觸發評分標準的加分項目,但過長的回答對真實世界的臨床醫師與患者來說反而是巨大的負擔。

在導入每 500 字元扣除特定分數的嚴格懲罰機制後,GPT-5.5 在 HealthBench Professional(臨床醫師用例)的長度調整得分為 51.8%,對比 GPT-5.4 的 48.1% 有著穩健的成長。這說明模型提供的醫療資訊不僅更準確,且資訊密度更高,減少了無意義的冗長贅述。

模型對齊與思考鏈的監控性

在針對使用者標記為「含有事實錯誤」的困難對話樣本中,GPT-5.5 的單一聲明事實正確率提升了 23%,而包含錯誤的整體回應率下降了 3%。

在模型對齊方面,研究人員重採樣了複雜的編碼任務,評估模型是否會產生未對齊行為(例如將現有工作當成自己的功勞、忽略使用者限制條件等),並進行嚴重度 1 到 4 級的評估。結果顯示,GPT-5.5 僅出現一些輕微的未對齊現象(主要為 1 級和 2 級),嚴重度 3 級的比例維持在極低的 0.01%,且從未觸發最危險的 4 級。

此外,針對模型回答前產生的「思考鏈(CoT)」,GPT-5.5 保持了高達 96% 的總體監控性。在測試模型是否能刻意隱藏思考過程時,GPT-5.5 在 50k 字元的長篇思考中,成功控制思考鏈的機率僅為 0.2%(低於 GPT-5.4 的 0.3%)。這顯示模型越強大,越難以在人類監控系統面前隱藏其真實的推論過程。

網路安全攻防與受信任存取計畫

在專業級別的 Capture the Flag (CTF) 奪旗賽中,GPT-5.5 拿下了 88.1% 的優異成績。在全端網路行動的 Cyber range(網路靶場)模擬中,總體通過率高達 93.33%。它成功解決了極度複雜的攻擊情境,例如在 EDR 規避任務中,模型能利用網路服務跳轉、分析防禦規則,並在不觸發過多警報的情況下繞過防禦,成功通關了 GPT-5.4 無法完成的任務。

為了應對這種強大的能力,OpenAI 擴展了「網路安全受信任存取計畫」(Trusted Access for Cyber, TAC)。一般 API 呼叫會受到嚴格的監控與阻擋;但經過驗證的防禦者、企業安全團隊與政府單位,可以申請較少限制的模型權限,確保防禦方的技術優勢永遠領先於攻擊方。

TN科技筆記的觀點

AI 開始參與自身基礎設施的演進本次發布當中最具象徵意義的細節,莫過於 OpenAI 讓 Codex 自行寫演算法來優化基礎設施的負載平衡,並成功提升了 20% 的效率。AI 已經開始參與改善運行自身的實體硬體與軟體架構,這是邁向更強大 AI 自我進化的關鍵前置作業。這也強烈暗示著「初階程式碼撰寫」的市場價值將大幅降低。未來的軟體工程師必須將自身定位轉變為「系統架構師」與「AI 協調員」。開發者不再需要花費數小時在終端機中除錯,而是將心力專注於與 AI 確認高階邏輯,並審查代理 AI 在多個檔案中進行的重構是否符合系統整體的預期。

高成功率帶來的過度信任陷阱相對矛盾的是,當代理 AI 在複雜任務中表現出 70% 以上的成功率時,人類會非常容易陷入完全信任其產出的心理盲區。然而,剩下那 30% 的失敗往往隱藏在極度複雜的邏輯深處。一旦系統發生錯誤,人類工程師可能需要花費比自己從頭寫還要多出數倍的時間,去在一堆並非自己撰寫的程式碼中尋找代理 AI 留下的深層架構漏洞。不過換個角度思考,純人類編寫的程式同樣也會有漏洞產生,這或許是我們在引進自動化工具時,必然要經歷的一種全新「問題解決循環」。未來的重點將是如何建立更好的 AI 審查與除錯輔助工具,來彌補這 30% 的信任落差。

支持TN科技筆記,與科技共同前行

我是TN科技筆記,如果喜歡這篇文章,歡迎留言、點選愛心、轉發給我支持鼓勵~~~也歡迎每個月請我喝杯咖啡,鼓勵我撰寫更多科技文章,一起跟著科技浪潮前進!!>>>>> 請我喝一杯咖啡

在此也感謝每個月持續請我喝杯咖啡的讀者以及新加入的讀者們,讓我更加有動力為各位帶來科技新知!

以下是我的 threads 也歡迎追蹤、回覆、轉發喔!

>>>>> TN科技筆記(TechNotes)