自 2006 年 NVIDIA CUDA 平台誕生以來,GPU 程式設計一直是高效能運算領域的一門高深學問。開發者們在追求極致效能的同時,也必須面對硬體架構快速迭代帶來的複雜性。傳統的 SIMT(單指令多執行緒)模型賦予了開發者精細控制硬體的能力,但這也意味著需要投入大量心力,才能寫出能在不同世代 GPU 上都表現優異的程式碼,尤其是在 AI 時代,如何高效利用硬體,更是成為一道巨大的挑戰。

因此,CUDA 平台使用者一定感受過在演算法創新與底層硬體優化之間的拉扯:究竟是要花時間鑽研硬體細節,還是專注於演算法本身的突破?NVIDIA 顯然也看到了這個困擾。在最新的 CUDA 13.1 更新中,他們推出堪稱是 CUDA 平台誕生以來最重要的變革之一:NVIDIA CUDA Tile,為了將開發者從繁瑣的硬體細節中解放出來,讓他們能更專注於演算法本身。Focus on Your Algorithm—NVIDIA CUDA Tile Handles the Hardware

CUDA Tile 究竟是什麼?

從「管理士兵」到「指揮戰陣」

簡單來說,NVIDIA CUDA Tile 是一種全新的 GPU 平行程式設計模型。過去,我們使用 SIMT 模型,就像是一位指揮官,必須對軍隊中的「每一位士兵」(每一個執行緒 Thread)下達具體指令,明確定義每個士兵該做什麼、處理哪個數據。這種方式雖然靈活,但隨著軍隊規模(GPU 核心數)和兵種(專用硬體如 Tensor Cores)越來越複雜,管理成本也呈指數級增長。

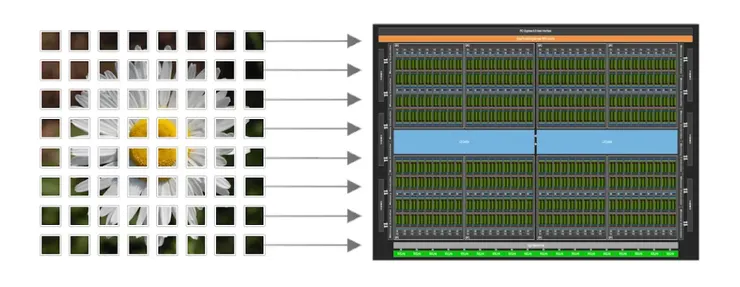

CUDA Tile 提出了一個更高層次的抽象化作法。它讓指揮官的角色從「管理士兵」轉變為「指揮戰陣」。你不再需要對單一士兵下令,而是將資料劃分成一個個「方陣」(Tile),並定義這些方陣之間要進行什麼樣的運算。至於每個方陣內的士兵如何分配任務、如何協同作戰、如何使用最高效的武器,全都交由更底層的編譯器和執行環境去自動處理。

這個模型的最大好處是,它將演算法的「意圖」與硬體的「實現」分離開來。開發者只需要專注於高層次的資料運算邏輯,而不用煩惱這些邏輯要如何對應到特定 GPU 架構的複雜硬體上。這種改變,尤其對於 AI 和機器學習領域中常見的大規模矩陣運算,將帶來極大的開發效率提升。

抽象化就是力量:自動駕馭 Tensor Core 的黑魔法

自 NVIDIA Volta 架構以來,Tensor Cores 已成為 NVIDIA GPU 的運算核心,為 AI 和科學計算提供了驚人的矩陣運算加速能力。然而,要手動編寫能充分利用 Tensor Cores 的 SIMT 程式碼極其複雜。開發者需要深入了解其特殊的矩陣維度要求和資料流動方式。

CUDA Tile 的核心價值之一,就是將這層複雜性完全隱藏起來。當你使用 Tile 模型定義矩陣運算時,CUDA 的編譯器能夠識別出這是一個可以由 Tensor Cores 加速的任務,並自動生成對應的底層指令去調用這些專用硬體。它甚至會自動處理專用於加速資料搬運的硬體,開發者完全無需手動介入。

開發者將可以直接編寫一份更高層次、更具可讀性的程式碼,就能自動享受到最新硬體帶來的效能紅利。更重要的是,這份程式碼具備了前所未有的「未來兼容性」。當 NVIDIA 未來推出更強大、架構更複雜的 Tensor Cores 時,你用 CUDA Tile 編寫的程式碼很可能只需要重新編譯,就能自動利用新硬體的優勢,無需進行痛苦的重構。

Python 開發者的福音:cuTile 讓 GPU 程式設計更親民

如果說 CUDA Tile IR 是這場革命的理論基礎,那麼 cuTile Python 就是將其帶給廣大開發者的殺手級應用。NVIDIA 非常清楚,目前 AI/ML 領域的主導語言是 Python。cuTile Python 讓開發者可以直接在 Python 中編寫高效能的 Tile-based GPU 核心 (Kernel), 不需要再處理底層細節,極大地降低了 GPU 程式設計的入門門檻,讓研究人員能輕鬆編寫客製化的 GPU 加速程式。

CUDA Tile IR:為未來鋪路的虛擬指令集

在所有這些高階應用的底層,是 CUDA Tile IR (Intermediate Representation) 這個堅實的基礎。在 CUDA 的世界裡,PTX (Parallel Thread Execution) 是一種虛擬指令集架構,它確保了 SIMT 程式碼可以在不同世代的 NVIDIA GPU 上運行。CUDA Tile IR 扮演了同樣的角色,但它是為 Tile 模型而生的。它定義了一套標準的、與具體硬體無關的 Tile 操作指令。上層的語言(如 cuTile Python)會被編譯成 Tile IR,然後 NVIDIA 驅動程式再將 Tile IR 編譯成特定 GPU 的原生機器碼。

這個中間層的存在,是 CUDA Tile 能夠實現「跨代兼容」和「未來兼容」的關鍵。它為 NVIDIA 未來的硬體創新提供了一個穩定的軟體介面,也為社群開發自己的領域特定語言 (DSL) 或編譯器提供了可能。

TN科技筆記的觀點

過去,要榨乾 GPU 效能往往是少數頂尖 CUDA 專家的專利。CUDA Tile的出現,將能夠讓大量 Python 開發者、AI 研究員和資料科學家,能夠用他們熟悉的語言,輕鬆地為自己的特殊演算法編寫高效能核心,大大縮短從研究想法到實現的路徑,我們可能會看到更多領域特定、高度優化的 AI 模型和科學計算應用如雨後春筍般湧現。

同時,提供一個更聰明的軟體層,讓硬體的複雜性消失於無形。這極大地增強了開發者留在 NVIDIA 生態系內的誘因。當開發者習慣了這種「專注演算法,效能跟著來」的開發模式後,轉換到其他硬體平台的摩擦成本將會變得非常高。這是 NVIDIA 透過軟體來深化其硬體護城河的典型策略。

當然,任何抽象化都伴隨著控制力的犧牲。雖然 CUDA Tile 能滿足 95% 的使用情境,但對於那些追求極致效能、需要對硬體進行精細微調的頂尖專家來說,Tile 模型可能會限制他們的操作空間。在某些極端情況下,手寫的 SIMT 程式碼可能仍然存在效能優勢。

支持TN科技筆記,與科技共同前行

我是TN科技筆記,如果喜歡這篇文章,歡迎留言、點選愛心、轉發給我支持鼓勵~~~也歡迎每個月請我喝杯咖啡,鼓勵我撰寫更多科技文章,一起跟著科技浪潮前進!!>>>>> 請我喝一杯咖啡

在此也感謝每個月持續請我喝杯咖啡的讀者以及新加入的讀者們,讓我更加有動力為各位帶來科技新知!

以下是我的 threads 也歡迎追蹤、回覆、轉發喔!

>>>>> TN科技筆記(TechNotes)